阿里开源Wan2.2:全球首个MoE视频模型。支持电影级美学控制,720P/24fps,消费级显卡可跑,高效且强大!

原文标题:阿里再开源,全球首个MoE视频生成模型登场,电影级美学效果一触即达

原文作者:机器之心

冷月清谈:

首先,MoE架构首次引入视频扩散模型,通过多个专业专家模型协同去噪,它在不显著增加计算成本的前提下,实现了模型容量的大幅扩展,提升了性能。

其次,模型训练数据量相比前代Wan2.1有了显著增长,图像数据和视频数据分别增加了65.6%和83.2%,这极大增强了模型的泛化能力,使其在运动表达、语义理解及美学表现上达到顶尖水平。

第三,Wan2.2融入了特别筛选的美学数据集,并精细标注了光影、构图、色彩等电影制作中的细粒度属性,使用户能够精准控制生成视频的风格与审美偏好。

最后,高效高清Hybrid TI2V架构的同步开源,使50亿参数的模型能在消费级显卡(如4090)上流畅运行,支持720P、24fps的文本或图像生成视频,是当前市场上最快速、用户友好的高清生成模型之一。Wan2.2的开放为学术界和工业界提供了强大的工具,有望推动视频内容创作进入新纪元。

怜星夜思:

2、Wan2.2能精准控制视频的光影、构图和色彩,达到电影级美学效果。这对于传统影视制作、广告创意乃至普通大众的视频创作会产生多大的冲击?未来我们看到的视频内容是不是会越来越“完美”,但也可能越来越趋同?

3、720P、24fps的视频生成能在4090这样的消费级显卡上流畅运行,这大大降低了使用门槛。你认为这会如何改变视频创作者生态?是会涌现更多独立创作者,还是会加剧内容的“内卷”?有没有可能催生出全新的内容形式或商业模式?

原文内容

机器之心编辑部

继上周开源三连发之后,阿里昨晚又放出了新模型。

这次是全球首个开源的 MoE 架构的视频生成模型 Wan2.2,最大的亮点是具备了电影级美学控制能力。

该模型遵循 Apache 2.0 开源协议。

-

官网地址:https://wan.video/welcome

-

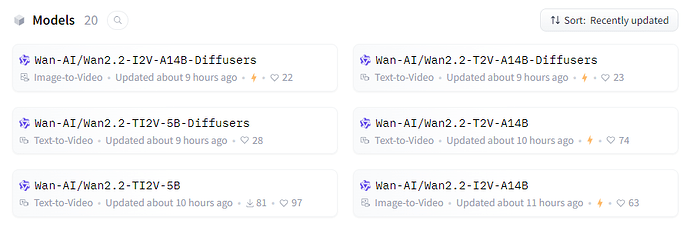

Hugging Face 地址:https://huggingface.co/Wan-AI

-

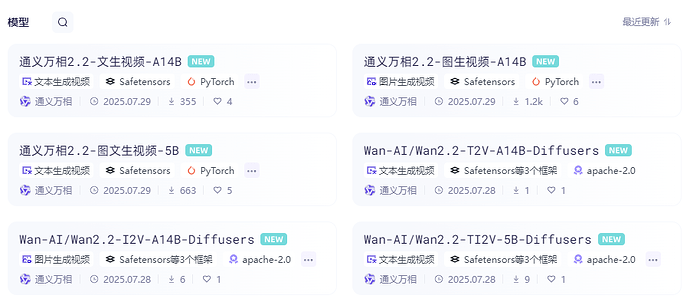

ModelScope 地址:https://modelscope.cn/organization/Wan-AI

我们先来看两个示例:

提示词:A purely visual and atmospheric video piece focusing on the interplay of light and shadow, with a corn train as the central motif. Imagine a stage bathed in dramatic, warm spotlights, where a corn train, rendered as a stark silhouette, moves slowly across the space. The video explores the dynamic interplay of light and shadow cast by the train, creating abstract patterns, shapes, and illusions that dance across the stage. The soundtrack should be ambient and minimalist, enhancing the atmospheric and abstract nature of the piece.

提示词:A man on the run, darting through the rain-soaked back alleys of a neon-lit city night, steam rising from the wet pavement. He's clad in a drenched trench coat, his face etched with panic as he sprints down the alley, constantly looking over his shoulder. A chase sequence shot from behind, immersing the viewer deeply, as if the pursuers are right behind the camera lens.

对于 Wan2.2 的开源,评论区的网友也是称赞有加。

而实现这样的效果,Wan2.2 主要得益于以下几大技术创新:

一是,MoE 架构创新。

Wan2.2 首次在视频扩散模型中引入了 Mixture-of-Experts(MoE)专家混合架构。

通过在时间步之间引入多个专门的强大专家模型来分担去噪过程,Wan2.2 实现了在不增加计算成本的前提下,大幅扩展了模型整体容量。

二是,数据规模跃升。

相比 Wan2.1,Wan2.2 的训练数据量大幅提升:图像数据增加 65.6%,视频数据增加 83.2%。

数据量的扩展显著增强了模型在运动表达、语义理解和美学表现等多维度的泛化能力,在所有开源与闭源视频模型中的表现均属顶尖。

三是,电影级美学控制能力。

Wan2.2 融入了特别筛选的美学数据集,并标注了光影、构图、色彩等细粒度属性,使得模型在生成时能够更精准地控制电影感风格,支持用户按需定制审美偏好。

四是,高效高清 Hybrid TI2V 架构。

Wan2.2 同步开源了一款 50 亿参数模型,采用自研的 Wan2.2-VAE 编码器,压缩率达到 16×16×4。该模型支持文本生成视频和图像生成视频两种模式,生成分辨率高达 720P、24fps,并可在消费级显卡(如 4090)上流畅运行。

该模型是当前市场上最快速的 720P、24fps 生成模型之一,可同时服务工业界与学术界的多种需求。

目前,用户可在 Hugging Face 和阿里魔搭(ModelScope)社区下载使用。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com