陶哲轩警示AI发展:从“能否做到”到“如何低成本实现”,须关注资源消耗与标准化评估。

原文标题:解道奥赛题成本5000美元?陶哲轩警告,AI下一步要规模化的「更便宜」

原文作者:数据派THU

冷月清谈:

他强调,技术的大规模部署,关键在于“降本增效”。例如,若AI工具解决一道奥赛题的成功率仅20%但单次尝试成本1000美元,其实际每成功解决一次的成本高达5000美元。此外,即便是成功案例,如果背后存在高薪专家“待命”的隐性成本,也应计入总开销。陶哲轩通过莱特兄弟的首次飞行与喷气式航空普及的对比,以及阿波罗计划的高昂月球探索成本,阐释了技术从“概念验证”到“大规模应用”所面临的挑战,即必须关注资源消耗和实际效益。

展望未来,他预测AI项目的发展路径可能趋同于其“等式理论项目”:绝大部分任务将由“廉价”AI高效完成,而“昂贵”的高级AI则与人类专家协同攻克少数疑难问题。因此,标准化、要求提前披露资源使用和方法细节的基准测试和竞赛,对于准确衡量AI技术的“量变”进展变得尤为重要,以取代当前依赖自我报告成果的模式,确保AI评估的透明度和可信度。

怜星夜思:

2、陶哲轩教授提出要用更受控的环境来评估AI,还要披露资源使用和失败案例,这听起来有点过于“学术”了。对于我们普通老百姓来说,这种评估方式具体有什么好处呢?是不是意味着以后AI的宣传会更“真实”?

3、文章里提到,未来大部分AI项目会由“廉价”AI来完成,而“昂贵”的高级AI则与人类专家协同。大家觉得这种人机协作的模式会在哪些领域率先普及?这对我们普通人的工作和生活会有什么样的影响呢?

原文内容

来源:机器之心本文约2000字,建议阅读5分钟人工智能技术现已迅速接近从定性到定量成果的转型阶段。

人工智能和数学是密不可分的。

AI 的发展离不开数学的进步,同时 AI 的进步也离不开解决数学问题的能力。

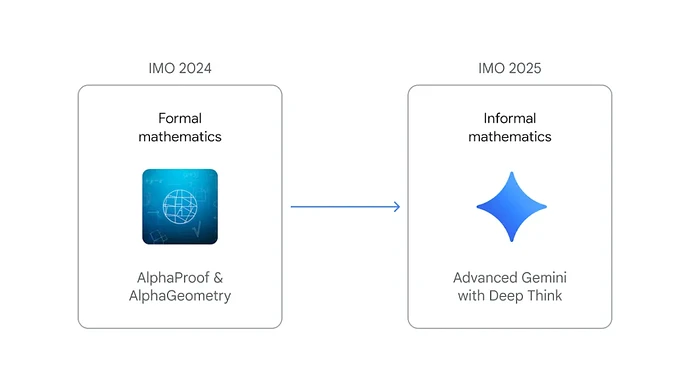

在刚结束不久的 IMO 竞赛中,谷歌的新一代 Gemini 进阶版模型成功解决了六道超高难度试题中的五道,达到了今年 IMO 的金牌水平(35/42),成为首个获得奥赛组委会官方认定为金牌的 AI 系统。

加州大学洛杉矶分校数学系终身教授,菲尔兹奖获得者,被称为「数学莫扎特」的华人数学家 陶哲轩,参加了今年度 IMO 竞赛的颁奖典礼。

他同样也对在 IMO 取得成绩的 AI 模型十分关注。

但他同样表达了一定程度的担忧,希望明年能够在更加受控的环境下对 AI 模型进行科学比较和评估。

陶教授认为:一些在标准考试条件下可能连铜牌都难以稳定获得的学生或队伍,在某些经过修改的赛制下,反而可能稳定地达到金牌水平。

因此,在没有采用统一、非参赛队自选的控制性测试方法的前提下,对于不同 AI 模型在类似 IMO 等竞赛中的表现,应当谨慎看待,避免作出过于简单化的「对等」比较。

陶教授对人工智能的发展和评估的关心是一贯的。近期,他在 mathstodon 上发表了对于人工智能发展现状的观点和对于未来的评估策略的建议。

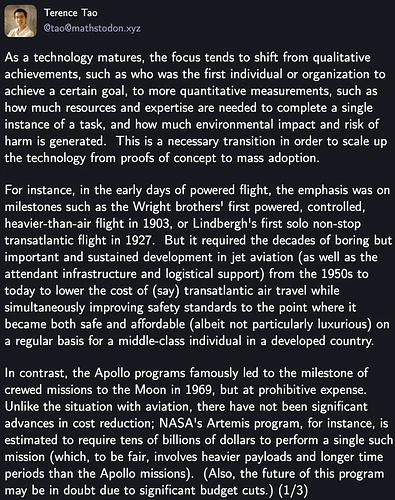

人工智能技术现已迅速接近从定性到定量成果的转型阶段。

随着一项技术成熟,关注点往往会从定性的成就转移,例如谁第一个实现了某个目标,转向更定量的衡量标准,例如完成单个任务需要多少资源和专业知识,以及会产生多少环境影响和伤害风险。

这是一个必要的转变,以便将技术从概念验证扩展到大规模应用。

举两个例子:诸如莱特兄弟在 1903 年首次实现动力、可控、比空气重的飞行;林德伯格在 1927 年首次独自不间断跨大西洋飞行。

但真正让跨大西洋航空旅行变得低成本、安全且对发达国家中产阶级来说可以定期负担得起的,并不是这些初期的壮举,而是从上世纪 50 年代开始,长达数十年的喷气式航空技术的持续发展,以及与之配套的基础设施和后勤系统的稳步完善。这些工作虽枯燥,却至关重要。

相比之下,阿波罗计划虽曾在 1969 年成功实现了载人登月的里程碑,但代价极为高昂。与航空领域的发展不同,太空探索在成本降低方面并未取得显著进展。

如今,几乎任何一个具体的概念验证目标,只要投入足够的资源和专业团队,都有可能在未来几年内通过类似「登月计划」式的 AI 项目实现。

但真正要将这些技术大规模部署到现实世界中,关键问题已经从「能否做到」转向了「如何以更低成本、更高安全性和更强可扩展性实现」。

简而言之,就是人工智能需要「降本增效」。这与评估 AI 模型的方式密不可分。

在宣布某一目标完成时,显然有必要同步报告其所消耗的资源成本。但同样重要的是,也应报告失败案例,以更准确地评估成功率 —— 这是衡量预期成本的关键部分。

举例来说,如果某个先进的 AI 工具每次尝试解决一道奥赛级别的问题需要耗费约 1000 美元的算力资源,但成功率只有 20%,那么平均每成功解决一次问题的实际成本就是 5000 美元。如果只报告那 20% 的成功案例,就会对实际成本形成严重误导。

同理,如果这些成功案例是在有高薪专家全程监督、监控,甚至准备随时介入的前提下完成的 —— 即使最终没有触发人工干预,这部分「待命成本」也应计入整个过程的实际成本。

尽管未来的扩展规律(scaling laws)可能会有所变化,但可以预见的是,最耗费资源的 AI 系统依然会比那些廉价模型更强大。因此,在实际应用中,「轻量型」与「密集型」AI 工具各有其用武之地。

以陶教授最近完成的「等式理论项目(Equational Theories Project)」为例:在总共需要证明的 2200 万条蕴涵关系中,绝大多数是通过非常简单的暴力方法完成的;剩下的很大一部分则由中等强度的自动定理证明器(ATP)解决;再往后,一部分由人类参与者解决,最后少数几个疑难问题,则依赖多个研究人员与 ATP 工具协作攻克。

尽管并未大量使用像大型语言模型这样的现代 AI,但陶教授预计未来类似的大规模项目会呈现类似的发展路径:

项目的绝大部分由「廉价」AI 完成,而「昂贵」的高级 AI 则与人类专家协同作战。

展望未来,标准化的基准测试和竞赛将变得越来越重要,特别是那些要求提前披露资源使用和方法细节的评测机制。这对于准确衡量 AI 技术的「量变」进展至关重要。

这与陶教授在 IMO 竞赛后对 AI 公司自我披露竞赛结果担忧的观点是一脉相承的。

当前依赖自我报告成果的现状,在技术发展的「质变」初期阶段尚且可以接受,但随着 AI 进入广泛落地和实际部署阶段,这种方式就必须被更透明、可对比的标准化评估所取代。

陶哲轩教授的观点站在了历史的角度,但同样也有网友回望历史而对人工智能的普及暗含的风险而表示担忧。

完整内容请参阅原始推文:https://mathstodon.xyz/@tao/114910028356641733

编辑:文婧