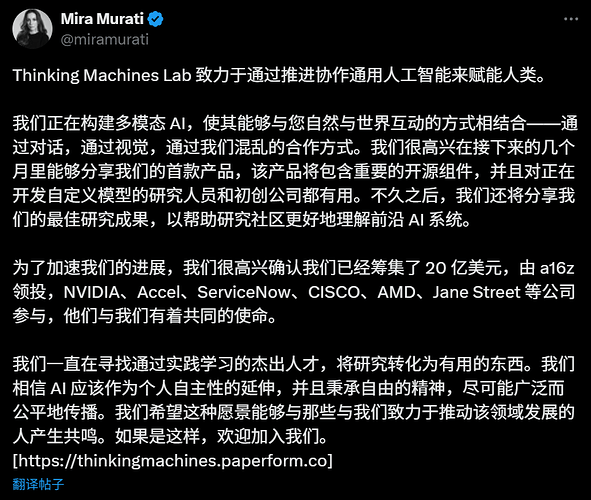

OpenAI前CTO Mira Murati新公司种子轮获20亿美元,估值120亿美元,剑指开源多模态AI,引发关注。

原文标题:种子轮就估值120亿美元,她能打造另一个OpenAI吗?

原文作者:机器之心

冷月清谈:

Murati的离开恰逢OpenAI内部“政变”风波,她明确表示新公司将致力于构建“能以自然交互方式工作的多模态AI”,并承诺包含“开源组件”和分享“最优秀的科学成果”回馈研究社区,这与OpenAI日益封闭的趋势形成了鲜明对比。与同为OpenAI“出走者”的Ilya Sutskever极度追求安全、不问商业的路径不同,Murati似乎在探索一条平衡理想与现实的AI发展道路。

Thinking Machines Lab的名称或在致敬1980年代的超级计算机公司,目前已吸引多位AI领域重量级人物,组建起“AI梦之队”,其中包括曾在OpenAI负责ChatGPT、Dall-E等核心产品的Murati本人。近期Meta曾试图收购该公司也未果,进一步凸显了AI领域激烈的人才和技术竞争。市场对Thinking Machines Lab的新产品抱有极高期待。

怜星夜思:

2、Mira Murati的新公司强调产品将包含“开源组件”,并分享“最优秀的科学成果”,这与OpenAI和Meta近期逐渐走向封闭或转向闭源的趋势形成对比。大家觉得在AI大模型时代,是坚持开源更有利于技术创新和生态繁荣,还是走向闭源更能保护商业利益和核心竞争力?长远来看,哪种模式会成为主流?

3、文章里提到了两位OpenAI的“出走者”:Mira Murati和Ilya Sutskever,他们各自创业,一个似乎在探索“理想与现实的平衡”(Murati),另一个则走向了“极致的、纯粹的安全”(Ilya)。大家觉得在追求通用人工智能(AGI)的道路上,这两种截然不同的理念,哪种更有可能实现AGI,并且同时最大限度地确保人类福祉和AI伦理?

原文内容

编辑:+0

据《金融时报》报道,OpenAI 前 CTO Mira Murati 的创业公司 Thinking Machines Lab 在一轮「种子轮融资」中成功募集了 20 亿美元,投后估值达到 120 亿美元,成为硅谷历史上规模最大的种子轮融资之一。

从「几百万」到「二十亿」

20 亿的种子轮投资是什么概念?让我们先从一个金融知识开始。

「种子轮融资」(Seed Round Funding):创业初期,你有点子却缺资金。这时,你需要第一笔启动资金,这笔钱好比「种子」,用来孕育你的公司。它通常金额不大,但风险最高,因为公司仅有想法和团队,尚未推出产品或积累用户。

绝大多数 AI 初创企业早期融资只有几百万到几千万美元,即便是同为 OpenAI 的「校友」公司、如今 AI 巨头之一的 Anthropic,其第一轮正式融资也仅为 1.24 亿美元(2021 年 5 月)。20 亿甚至可以买下大半个 Windsurf 公司(核心技术加主要团队)。

这似乎颠覆了传统「创业」的定义。过去,一个颠覆性的想法在车库里就能诞生,几百万美元的种子轮足以让它发芽。

Google 的第一个办公地点车库。

可以预测,这笔钱的核心用途是构建一个在当今 AI 竞赛中缺一不可的「共生体」:顶尖的人才团队和支撑他们工作的海量算力。

此轮融资由知名风投公司 a16z 领投,芯片巨头 Nvidia 和 AMD 也位列投资者名单,这也许是 Thinking Machines Lab 不用在「算力荒」中挣扎的有力证据。

但这 20 亿不只是光环,也是悬在 Murati 头上的达摩克利斯之剑,投资者不是慈善家,他们投入天价赌注,要求的是超高回报。她必须在规定时间内拿出颠覆性成果,否则估值泡沫会瞬间破灭。

出走者的「新理想国」?

OpenAI 安全团队负责人 Jan Leike 在离职时公开发文,怒斥 OpenAI 及其领导层忽视「安全」而偏爱「光鲜亮丽的产品」。这几乎是公开宣告了公司内部「加速派」与「安全派」的决裂。详见机器之心报道:《》。

Mira Murati 的离开和创业,也发生在 OpenAI 领导层「政变」风波之后。她的新公司,是否旨在建立一个她认为更理想的 AI 开发环境?

尽管 Thinking Machines Lab 成立不到一年,且对其具体研究内容高度保密,但 Murati 透露了公司未来的方向。她表示,公司正在构建「能以自然交互方式工作的多模态 AI——通过对话、视觉以及我们进行协作时那种略显混乱的真实方式」。

在 OpenAI 名字里还带着「Open」,却日益走向封闭的当下,Murati 明确提出产品将包含一个「开源组件」,对开发定制模型的研究人员和初创公司很有用。她还补充说,公司将分享其「最优秀的科学成果」以回馈研究社区。

不过有意思的是,Meta 作为开源社区的最大贡献者之一,近期却有转向开发闭源模型的传言。详见机器之心报道《》。

另外不得不提的是同为「出走者」的 Ilya Sutskever,他在 2024 年 6 月宣布成立新公司 Safe Superintelligence Inc. (SSI),其唯一目标就是安全地构建超级智能,不为产品和商业利润所动。

同样有 OpenAI 的光环,同样至今 0 产品,却似乎正在探索两条截然不同的道路。Ilya 走向了极致的、纯粹的「安全」,不问商业,而 Murati 似乎试图在理想与现实中找到平衡。

Thinking Machines Lab

其实 Thinking Machines Lab 这个名字也挺有意思的,字面意思就已相当清晰。另外还有猜测它是在致敬一家成立于 1980 年代的计算机公司 Thinking Machines Corporation,以其开发的高性能并行计算机闻名,曾在超级计算和人工智能领域具有开创性意义。

在激烈的人才争夺战中,Thinking Machines Lab 已经吸引了多位重量级人物,堪称「AI 梦之队」。详见机器之心往期报道《》。

这其中最引人注目的成员,莫过于创始人 Mira Murati 本人,她在 AI 领域拥有卓越的履历。她在 OpenAI 曾负责 ChatGPT、Dall-E 等核心产品的开发,并在 2023 年 11 月的董事会风波中短暂担任临时首席执行官。此前,她还曾在特斯拉担任高级产品经理,参与了 Model X 的研发。

Mira Murati 在旧金山接受了《连线》与 Emily Chang 的采访。

另外,据媒体报道,近期在 AI 人才战中大获全胜的 Meta 公司也曾就收购 Thinking Machines Lab 进行过谈判,但最终未能进入正式报价阶段。

从近期的 AI 工程师天价「转会」风波,到 Thinking Machines Lab 20 亿的种子融资,我们可以看到 AI 在这个时代毫无争议的重要地位。

无论如何,大家对 Thinking Machines Lab 新产品的期待值已经拉满了。

https://www.wired.com/story/thinking-machines-lab-mira-murati-funding/

https://www.ft.com/content/136c04f2-787b-4ec3-9e0e-11eda682d52f

https://techcrunch.com/2025/07/15/mira-muratis-thinking-machines-lab-is-worth-12b-in-seed-round/

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com