斯坦福博士朱哲清创办Pokee.ai,以RL为核心打造交互式AI Agent,完成1200万美元种子轮融资。颠覆传统AI Agent构建路径,引领智能体新方向。

原文标题:斯坦福毕业,用RL做Agent,华人创业团队种子轮融资1200万美元

原文作者:机器之心

冷月清谈:

文章还探讨了通用 Agent 的发展阶段与挑战。朱哲清指出,当前 AI Agent 仍处于第一步:解决实际问题。未来更深层次的突破在于用户意图的“对齐”(Alignment)与“个性化”(personalization),这需要 Agent 通过与用户的长期交互建立记忆,理解其真正意图。他强调,LLM 的进步将直接影响 Pokee.ai 理解用户 intent 的能力,二者并非竞争关系而是互补。此外,Pokee.ai 团队坚持轻量级、高效的运作模式,目前仅有 7 名成员,且全员远程办公。

怜星夜思:

2、创始人朱哲清提到,目前Agent行业还停留在“解决问题”的第一步,而“意图对齐”和“个性化”是未来的更深层探索。你认为在技术和伦理层面,实现这种高度“对齐”和“个性化”的AI Agent,我们可能面临哪些显著的机遇和风险?

3、Pokee.ai 团队坚持“轻量级”和全远程办公模式,甚至没有办公室。这种创业模式在AI领域,尤其是需要大量数据、算力和复杂模型研发的Agent赛道上,是否具有普遍的可复制性和可持续性?它的利弊又是什么?

原文内容

作者:Youli

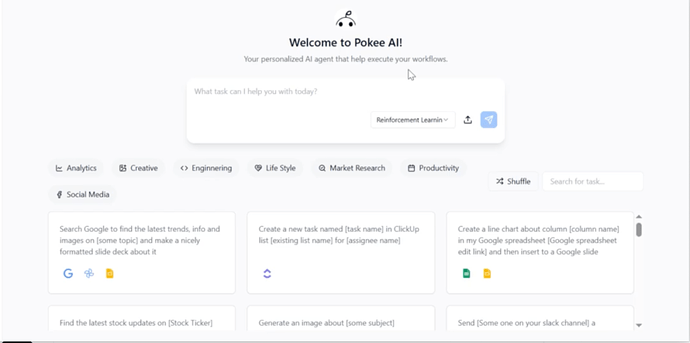

Pokee AI 公开测试版现已正式上线!

「哈喽,可以听到吗?」北京时间上午 10 点,大洋彼岸的 Pokee.ai 创始人朱哲清接通了我们的连线电话,此刻他正位于美国西海岸,当地时间为前一日晚上 7 点。

用他的话说最近的状态就是「忙」,非常忙。忙着发布 Agent 产品 Pokee AI 的公开测试版,忙着处理第一轮融资的各种后续事宜,忙着对核心 4 人组团队「扩张」至 7 人,忙里偷闲在小红书庆祝自己 29 岁生日,并在评论下认真回复网友提问……

「忙」,或许不是从最近开始的,往前数 200 多天,那时候也「忙」。忙着成立 Pokee.ai,忙着与 100 多位投资人聊如何用强化学习模型构建 AI Agent,忙着准备产品内测。

再往前数到 2017 年,依旧是「忙」。一边忙着在斯坦福攻读强化学习方向博士学位。一边忙着在 Meta 工作,带领团队将强化学习落地到广告竞价、自动内容生成等业务,为公司带来高额增收。

朱哲清似乎已经习惯了「忙」。可他说,创业虽然忙,但有了更多的时间去思考,这是一种全新的体验……

创业是从去年 10 月开始的,公司名为 Pokee.ai,取自「小口袋」之意,寓指做一个轻便、决策能力强、随叫随到解决问题的模型。公司整体定位是聚焦于开发一款交互式、个性化、高效的 AI Agent。

但较之主流以 LLM 为核心的 AI Agent 构建方式,Pokee.ai 是以 RL 为核心,用朱哲清的话说,在 Pokee 的架构中,LLM 主要是充当人机交互界面,类似「 UI 层」,用以理解用户意图,而真正决策、执行任务的全都是基于 RL 结构完成。

但那是去年 10 月,OpenAI 还没有发布 o1,将 RL 推向大众,DeepSeek 也还没有引起全球狂欢。

在与大多数的投资人聊的时候,他们都觉得 Pokee.ai 这个方向是天方夜谭…… 如今,它已经慢慢从「非共识」变成了「共识」,而 Pokee.ai 也迈进新阶段。

最新消息,Pokee.ai 完成 1200 万美元种子轮融资,由 Point72 Ventures 领投,Pokee AI 的公开测试版现已上线。

本周,在 Pokee 正式公测前,《机器之心》与朱哲清聊了聊,以下为对话内容:

机器之心:Pokee.ai 去年 10 月成立,如今产品正式公测、完成种子轮融资,这样的节奏在你预期内吗?

朱哲清:整体节奏比较快,去年 10 月 Pokee.AI 成立,从概念验证,到通用 Agent 框架搭建,再到如今产品公测和融资宣布,其实也才 7 个多月。之前定的目标是,今年上半年最重要的是做完产品第一轮公测、拿到种子轮融资,现在全部完成,总体来说符合预期。

与 Meta 相比,节奏大概会快 4—5 倍,对我来说生活和工作节奏没有太大变化,甚至有更多时间去思考。我之前工作时同步在读博士,那时候特别忙,一周可能要工作 100 多个小时,现在还是 100 多个小时,但思考的时间变多了。

机器之心:你做的事情其实很少有人做,你印象中投资人问的最多的问题是什么?

朱哲清:刚开始和投资人聊的时候,总体感受就是他们不理解为什么要用一个跟别人不一样的方式去做 Agent,那时候 RL 又不火、DeepSeek 也没出来。当我第一次跟投资人说我们最终想做的是让一个 RL System 变成一个像通用操作系统一样的东西时,他们都觉得这是天方夜谭。

机器之心:说到做 AI Agent 的初衷,你曾说 Pokee.AI 做的是「目标不是像人一样完成任务,而是超过人类在某些任务中的策略选择和规划能力。」这是不是现在很火的 ASI 概念?

朱哲清:我觉得 ASI 与 AGI 的定义范畴其实很模糊,从某种意义上来说,我们可能已经实现了 ASI,如果给你一个 100 万 Token 的文章,人类要读很久才能把它读完,而模型只需要几秒或几十秒钟就完成了,那从这个角度来说它已经 Super Human Intelligence。

我们距离 Agent「ChatGPT 时刻」还有多远?

机器之心:在你看来,一个通用 Agent 应该具备哪些特点?

朱哲清:一个通用 Agent 的核心能力在于,不管是在什么场景下,要解决什么问题,只要把 prompt 告诉它,它就可以把任务完成,而不需要事先去配置要用哪些工具。

我们的设想是,客户给到一个 prompt,说这是我要做的事情需求,这家公司或者开发者不需要处理,直接将 prompt「扔」给 Pokee, Pokee 就根据 prompt 调用对应工具,把问题解决,将结果直接传回给公司或开发者,之后后者可以把内容用更好的展现形式反馈会给客户。

机器之心:可以理解为这是 AI Agent 的「ChatGPT 时刻」吗?现在处于什么阶段?

朱哲清:是的,这是一个完完全全不需要人为配置的 AI Agent,也是我们的最终设想。现在的 AI Agent 需要的(工具)配置量很大,要匹配 MCP Server、找工具,而在 prompt 下面可以加的工具很有限,也不能拼命加,那总体的训练量就很大。

机器之心:所以当时创业是因为看到这些局限性,Pokee.ai 是如何做的?

朱哲清:我们想做的就是如何能够让第三方开发者在几乎不需要做任何开发的情况下完成 AI Agent 的搭建,不管是 No Code 还是 Low Code。No Code 是指 Pokee 直接跑一个 prompt,得到工作流后,直接复制粘贴给无数个场景下面;Low Code,是指别人通过我们的接口把他们想要解决的问题以 Prompt 形式传过来,从而把问题解决了,也不用告诉我们要用什么工具。

机器之心:以 RL 为核心的 AI Agent 和以 LLM 为核心的 AI Agent 的差异性在哪里?

朱哲清:首先,当下的很多 LLM 也用强化学习,而我们做的强化学习模型的工具调用范围和常规 LLM 模型的工具调用范围不一样,具体来说是动作空间 (Action Space) 的区别,就是 LLM 模型的动作空间只有 Token,而强化学习模型的动作空间可能不是 Token,是那些工具,直接通过工具本身的泛化性来完成对于 AI Agent 的搭建。

机器之心:在你对通用 Agent 的描述中,对 prompt 的要求很高,但似乎并不是每个人都会提问题,如何看待这一现象?

朱哲清:是的,现在用户在使用 Pokee 的时候也会遇到这个问题,已经把 prompt 给你了,可为什么你写出来的东西不是我想要的?关键就在于,用户给的 prompt 可能并不是他们的真正意图,想做的和说的是两回事。

该如何理解意图就叫做对齐(Alignment),这件事情非常难,因为没有一个 Ground Truth,每个人说话方式都不一样。如果真的想要找到 Ground Truth,说用户一定指的是这件事情,那必须要通过和这个人的长期 Memory 联系起来才能够找到。

如果我来评判这条路径上该怎么走,就是先要能够解决问题,之后把用户的非训练数据进行个性化(personalization) ,然后要去理解、对齐。大概就是三步走 —— 决策能力、对于 Memory 的 personalization、Alignment。

机器之心:能否举例说一下?

朱哲清:比如之前投资人在试用我们产品时,写了一个 Prompt—— 能不能帮我 draft 一个 LinkedIn Post?那这个「draft」的意思到底是「单纯帮我写好但不要发出去」还是「帮我写好并直接发出去」?

要想了解他的真正意图就需要去看过往给他的员工或者同事说这句话的时候,他会怎么说,以及后者的回复,通过他们之间的交互来确认他说「draft」的意思。这是很复杂的一件事情,需要非常个性化的 Memory 才能完成。

机器之心:那当前处于哪一步?

朱哲清:整个行业第一步都还没做完,更别说二、三步了(笑)。

机器之心:基于此,该怎么做?

朱哲清:我觉得这是一个很有意义也非常前瞻的问题,但从商业化角度来说,这不是第一优先级,最先聚焦的应该是能不能解决问题?先把问题解决了,然后再往下探索能不能更好地理解(问题)。

机器之心:据了解,Pokee 的架构是,将小型 LLM 作为人机交互界面,类似「 UI 层」,用于理解用户意图,而真正决策、执行任务的全部基于强化学习结构来完成。基于这一理解,其实你们对于 prompt 的要求很高?

朱哲清:对,这就复杂得多了,所以我一直说,LLM 做得越好,我们就能做得越好。虽然我们是将 RL 而非 LLM 作为 AI Agent 核心,但我们与 LLM 并非竞争关系,如果纯语言方向不能变得更好,我们也会有瓶颈,根本无法完全完整地理解用户到底要说什么。

创业,一个孤独的漫长旅程

机器之心:从离开 Meta 开始创业到现在有大半年时间,你觉得工作和创业有什么区别,最大的感受是什么?

朱哲清:区别很大,期间也有过挣扎,但不是因为时间管理、劳累,而是创业本身是一条很模糊的路,或者说本来就没有路,你想走成什么样,它就是什么路。作为公司 CEO,看似有很大的话语权,你说要往哪走就往哪走,但实际上能做的决策数量有限,要对公司、大家负责。

在大公司不一样,可以做无数次决策,甚至可以换组,这个东西做不下去就换个方向。

机器之心:据了解,团队从成立到今年 4、5 月份一直是四人核心配置,现在有多少人?有没有考虑扩张?

朱哲清:目前团队有 7 个人,接下来还会招两三个人,但是大概率在收入规模扩大前不会将团队配置超过 10 个人。

机器之心:所以也可以说 AI 时代的创业更为「轻量级」?

朱哲清:是的,AI 时代,模型、产品打磨各方面其实用不了很多人,人多了,反而做事情会蹑手蹑脚。

机器之心:你们办公室位于哪里?日常工作状态是怎样的?

朱哲清:我们没有办公室。

机器之心:那平时开会也是线上?

朱哲清:全部线上,因为有人在西雅图,有人在湾区,还有人在新加坡,都不在一起。另外我们都是 Meta 出身,习惯了远程办公,即便没有办公室,效率也挺高,而且还能兼顾生活。现在,我们每天线上开一个会,要做什么,大家一起讨论决定。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com