ChatGPT助用户解十年怪病,AI医疗潜力无限,但仍需医生确认。

原文标题:求医十年,病因不明,ChatGPT:你看起来有基因突变

原文作者:机器之心

冷月清谈:

怜星夜思:

2、文章说未来AI可能会成为医生的“外挂”大脑,帮助诊断。如果医生越来越依赖AI,那万一AI出错了,责任怎么界定?会不会影响患者对医生的信任度呢?

3、除了辅助诊断,大家觉得目前AI在医疗领域还有哪些方面能立刻发挥大作用?比如药物研发、个性化治疗推荐,还是医院管理?有没有什么领域是AI暂时还不能碰的“禁区”呢?

原文内容

编辑:张倩

用AI给自己看病正在成为新趋势,但目前我们仍需要人类医生。

身体不适,求医十年,医生没找出原因,ChatGPT 给分析出来了。这是一位 Reddit 网友刚刚分享的个人经历。

这位网友提到:

十多年来,我一直被多种不明症状困扰。做过脊椎核磁共振、CT 扫描、全套血液检查(包括深入检测),甚至连莱姆病都没放过。

后来通过 Function Health 平台发现,我竟然携带纯合型 A1298C MTHFR 基因突变 —— 这种影响 7%-12% 人群的变异。虽然我所在的美国医疗网络是全国顶尖,甚至看过神经科医生排查过多发性硬化症,但始终没查出原因。

ChatGPT 整合了我所有的化验报告和症状史,推断这与基因突变高度吻合。原来即便维生素 B12 水平看似正常,这种突变也会导致身体无法有效利用,必须通过补充剂提升。

我把这些检查结果拿给我的医生看,他非常震惊,坦言一切症状突然都能解释了。我不确定他们之前怎么没想到给我做亚甲基四氢叶酸还原酶(MTHFR)基因突变检测。

如今几个月过去,我的症状已基本消失。整件事的发展至今仍让我觉得不可思议又充满惊喜。

这个帖子在 reddit 上热度非常高,很多人在评论区留言称,自己也有类似经历。

比如一位网友提到,自己呕吐超过 15 年,作为所有胃部检查和过敏测试,最近又被诊断出患有焦虑症。虽然药物确实起了作用,但呕吐一直没好过。于是,ta 就向 ChatGPT 发起了提问,并在 ChatGPT 的建议下去看了耳鼻喉科医生(因存在头晕症状),也确实查出了问题,看到了治愈的希望。

还有一位网友提到,自己家的狗被带去看兽医,结果兽医束手无策,让他们准备「告别」。而 ChatGPT 建议他们去能处理心脏问题的急诊室,狗狗由此获救……

类似的故事在评论区还有很多。虽然这些故事的真实性还有待验证(很多可能是博人眼球),但一个明显的趋势是,在求医问药这件事上,越来越多的人开始求助于 AI 了,尤其是在病因难以明确的情况下。

这种趋势背后有很多原因,一是优质医疗资源紧张、地区分布不均,造成人类医生没有足够的能力或精力为每个病人深度排查;二是现在的 AI 确实比以前进步了很多,它们能够快速检索和整合大量医学文献资料,在信息处理速度和数据容量方面具有技术优势,可以为医生和患者提供更全面的信息参考。

对于一些罕见疾病,即便是资深医师的临床经验也难免存在盲区。更何况,许多疑难症状往往需要多学科协作才能明确诊断,而这在现行的医疗体系下实现成本极高。

这或许就是 ChatGPT 们能够发挥重要作用的地方:帮助患者整理就医思路(根据症状初步确定挂什么科),帮助医生识别疑难杂症,最终使得诊疗更加个性化。

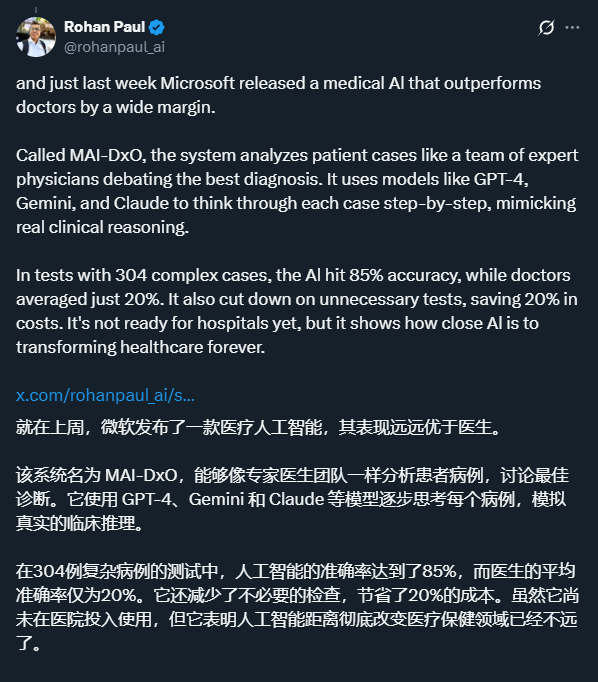

目前,微软等公司也在开发专门的产品来应对这种需求,并且看起来表现不错。

不过,发帖人也特别提醒说,「我在尝试 AI 建议前已与主治医生反复确认。请勿盲目相信 AI 的医疗建议。」

他的提醒不无道理,毕竟,当前的 AI 依然无法克服幻觉等问题,可能生成看似合理实则错误的建议。而且,AI 无法为误诊担责,而医生需遵循伦理和法律框架。所以,如果你也有向 AI 咨询医疗建议的习惯,千万不要盲目相信,最终的诊断和处置还是需要人类医生来做,AI 的建议仅供参考。

在可预见的未来,大多数医生可能也会将 AI 作为自己的「外挂」大脑,帮助更多患者找到正确的治疗方法。

参考链接:

https://x.com/rohanpaul_ai/status/1941321376838951320

https://www.reddit.com/r/ChatGPT/comments/1lrmom4/chatgpt_solved_a_10_year_problem_no_doctors_could/

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com