全球首款AI原生游戏引擎Mirage发布,文字指令实时生成游戏世界,开启UGC 2.0时代!告别预设脚本,人人皆可创作专属游戏。

原文标题:全球首款AI原生UGC游戏引擎诞生!输入文字秒建GTA世界,试玩体验来了

原文作者:机器之心

冷月清谈:

怜星夜思:

2、文章提到Mirage引擎使用了Transformer模型和扩散模型,这些模型各自有什么优势?为什么需要结合使用?

3、文章提到Mirage引擎目前还存在延迟问题,你认为除了网络延迟,还有哪些因素可能导致延迟?未来有哪些技术可以用来解决这些问题?

原文内容

编辑:杜伟、Panda

从此,游戏的未来不单单由专业设计师逐关打造,而是让每一个人都能实时构思、生成并体验游戏世界。

就在今天,全球首个由实时世界模型驱动的 AI 原生游戏引擎问世了!

该游戏引擎名为「Mirage」,由 Dynamics Lab 开发。

该系统专为构建动态、交互式且持续演变的游戏体验而设计,玩家可以通过自然语言、键盘或控制器实时生成并修改整个游戏世界。

从功能定位来看,Mirage 支持多类型的游戏开发。

目前发布了两款可玩游戏演示,包括都市乱斗(GTA 风格)和海岸漂移(极限竞速地平线风格)。

-

都市乱斗:https://demo.dynamicslab.ai/chaos

-

海岸漂移:https://demo.dynamicslab.ai/drift

所有场景都是实时动态生成的,并非预设脚本。我们看到的是一个随着玩家操作实时演变的可交互动态模拟世界。

都市乱斗(GTA 风格)

海岸漂移(极限竞速地平线风格)

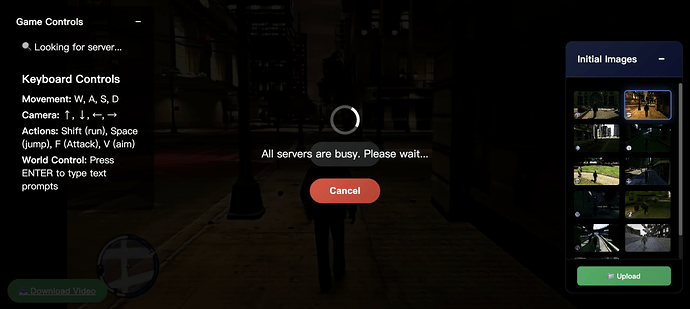

机器之心上手试玩了一下都市乱斗(GTA 风格),打开后界面是下面这样的,左边是控制选项,右边是街景选项。

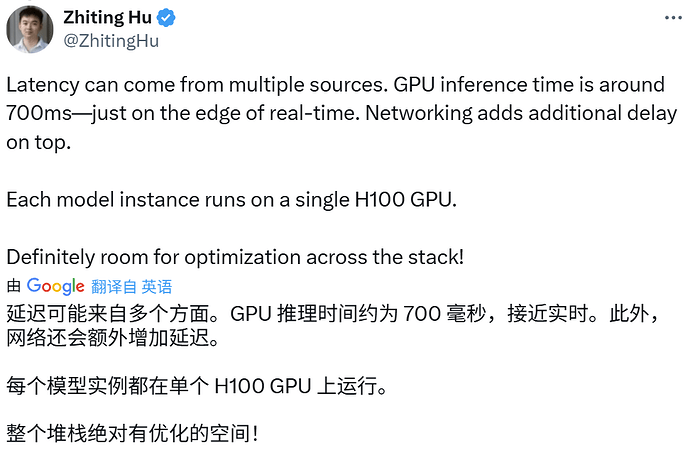

体验了一小会,我们发现:游戏延迟还比较高,人物前后左右移动的灵敏度有进一步提升的空间。

团队成员 Zhiting Hu 在 𝕏 上分享了延迟的可能原因,其中最大的延迟来源应该是网络延迟。

Mirage 还支持用户上传初始图片,然后进行游戏,机器之心用一张公司附近的照片进行了测试,视频如下:

虽然当前体验效果与心中的预期仍有差距,但 Mirage 代表着 AI 技术的前沿突破。

相较于谷歌的 AI Doom/Genie、Decart 的 AI Minecraft 以及微软的《雷神之锤 II》AI 版等近期成果,Mirage 具备以下三大显著优势:

-

实时 UGC 创作:支持游戏过程中实时通过文本输入生成内容,在基于世界模型的游戏生成领域实现重大突破。

-

影视级画质呈现:超越早期系统的像素块风格,实现照片级真实感视觉效果。

-

持久交互体验:连续交互时长突破十分钟,大幅扩展生成式游戏的可持续体验边界。

评论区的网友对 Mirage 给予了很高的评价与期待。

想要体验的小伙伴,赶紧去,目前服务器可能已经处于崩溃边缘了。

开发团队坚信:随着实时生成技术的持续突破,Mirage 必将重塑游戏产业的未来格局。

UGC 2.0:生成式游戏的崛起

传统游戏采用预制设计:城市布局固定、任务脚本预设、体验存在终局。而 Mirage 打破了这一边界,让玩家在游戏过程中实时创造全新体验。

通过自然语言指令、键盘输入或控制器操作,玩家可随时生成逃亡巷道、召唤载具或扩展城市天际线。系统将即时响应,将这些用户生成元素无缝融入持续运行的模拟世界 —— 游戏世界不仅是可交互的,更在与玩家共同进化。

Mirage 支持从竞速、角色扮演到平台跳跃的多元游戏类型:

这就是 UGC 2.0 的革新世界:

-

零门槛创作:仅需文本描述,人人皆可生成专属游戏世界。

-

实时共创演化:玩家在游戏进程中即时创造、演进并重塑游戏内容。

-

无限动态体验:每次体验皆独一无二,永不重复,彻底告别预设脚本。

基于下一代 AI 构建

Mirage 基于前沿的 World Model 研究,采用了基于 Transformer 的大规模自回归扩散模型,能够生成可控的高保真视频游戏序列。据介绍,该技术框架融合了多项关键创新:

基于游戏进行的基础训练

Mirage 建立在强大的训练基础上 —— 目标是理解和生成丰富的游戏体验。这一基础始于从互联网上大规模收集各种游戏数据 —— 这些数据可提供捕捉各种游戏机制和风格所需的广度。

为此,Dynamics Lab 构建了一个专门的数据记录工具,可用于捕捉高质量的人类录制的游戏互动。通过细致的、高保真度的样本,这些精心编排的流程丰富了数据集,从而可以训练模型掌握复杂的玩家行为和游戏情境逻辑。

随后,收集和记录的数据会被输入到一个垂直训练流水线 —— 一种专注于游戏领域的特定训练方法。这使得模型能够深入内化游戏世界规则、系统模式和交互动态。

最终,该模型能够生成连贯、逼真且灵活的游戏内容,进而突破了传统预先编写游戏的限制。

交互式生成与实时控制的结合

通过将帧级提示词处理集成到其核心,Mirage 重新定义了实时交互。这使得玩家能够输入命令或提示 —— 它们会在游戏进行中被即时解释。

支持通过云游戏随时随地畅玩:

-

动态输入系统:Mirage 能以超低延迟处理玩家输入(主要通过键盘和文本),实现近乎即时的响应。

-

实时输出:视觉更新通过一个全双工通信管道传输回浏览器;在这个管道中,输入和输出并行流动,从而消除延迟并确保流畅的交互。

具体技术上,Mirage 基于一个定制版因果 Transformer 模型,并进行了以下增强:

-

专用视觉编码器

-

经过改进的位置编码

-

针对扩展式交互序列优化的结构

Mirage 集中了 LLM 和扩散模型的优势,支持生成连贯、高质量的内容。为了同时保证速度和质量,该团队还在其扩散组件中使用的蒸馏策略。

游戏支持玩家随时使用自然语言重塑环境,从而触发即时世界更新。其具备由 KV cache 驱动的长上下文窗口,因此即使在世界实时演变的情况下,游戏也能保持视觉一致性。

关键功能

-

16 FPS 帧率:以标清 (SD) 分辨率进行实时交互。

-

动态 UGC:玩家可以使用自然语言命令改变世界。

-

扩展型游戏体验:Mirage 可生成分钟级的互动游戏,并保持视觉一致性。

-

云串流:随时随地进行跨平台即时游戏,无需下载。

-

无限重玩性:每次游戏体验都独一无二。

-

多模式控制:接受文本、按键和控制器输入。

团队成员及未来展望

据介绍,Mirage 由一支技术深厚、创意驱动型的 AI 研究员、工程师和设计师团队打造。

团队成员拥有谷歌、英伟达、亚马逊、世嘉、苹果、微软、卡内基梅隆大学及加州大学圣地亚哥分校的深厚背景。

Dynamics Lab 还在博客中分享了他们的「未来之路」:「生成式游戏不仅仅是一项功能,更是一种全新的媒介。Mirage 引领着一个游戏不再需要下载或设计,而是需要被想象、被激发、被体验的未来。」

博客地址:https://blog.dynamicslab.ai/

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com