上海人工智能实验室发布首个开放世界移动抓取多模态智能体OWMM-Agent,通过微调VLM模型,在真实环境零样本动作预测准确率达90%,为家庭服务机器人发展奠定技术基础。

原文标题:突破开放世界移动操作!首个室内移动抓取多模态智能体亮相,微调模型真实环境零样本动作准确率达 90%

原文作者:机器之心

冷月清谈:

怜星夜思:

2、文章中提到,OWMM-Agent 对复杂机械臂(如多指手)的控制能力有限,你认为多指手在家庭服务机器人中重要吗?如果重要,它能带来哪些优势?又会带来哪些技术难题?

3、文章提到,该研究假设有一个相对理想的环境重建,并假设目标任务相关的观测已经在记忆中。如果环境重建不准确,或者目标任务相关的观测不在记忆中,你认为会发生什么?有什么方法可以解决这些问题?

原文内容

在家庭服务机器人领域,如何让机器人理解开放环境中的自然语言指令、动态规划行动路径并精准执行操作,一直是学界和工业界的核心挑战。

近日,上海人工智能实验室联合新加坡国立大学、香港大学等机构的研究团队,提出了 "OWMM-Agent" 具身智能体——首个专为开放世界移动操作(OWMM)设计的多模态智能体 (VLM Agent) 架构,首次实现了全局场景理解、机器人状态跟踪和多模态动作生成的统一建模。

同时该工作通过仿真器合成智能体轨迹数据,微调了针对该任务的多模态大模型 OWMM-VLM,在真实环境测试下,该模型零样本单步动作预测准确率达 90%。

-

论文链接:https://arxiv.org/pdf/2506.04217

-

Github 主页:https://github.com/HHYHRHY/OWMM-Agent

一、问题背景介绍:开放语义下的移动抓取任务

传统移动抓取机器人在家庭场景处理 “清理餐桌并将水果放回碗中” 这类开放指令时,往往需要依赖预先构建的场景 3D 重建或者语义地图,不仅耗时且难以应对动态环境。OWMM 任务的核心难点在于:

-

全局场景推理:需要结合自然语言指令和多视角视觉信息,理解整个场景的布局和物体信息。

-

具身决策闭环:实时跟踪机器人状态(如当前位置、长续任务执行状态),生成符合物理约束的动作(如理解要到一定距离才可以抓取物体);

-

系统整合问题:VLM 基座模型难以直接输出机器人控制所需的底层目标(如导航目标点坐标、抓取物体坐标等)。

二、OWMM-Agent:用 VLM 重构机器人 “大脑”

研究团队提出的 OWMM-Agent 架构,通过两大创新突破上述瓶颈:

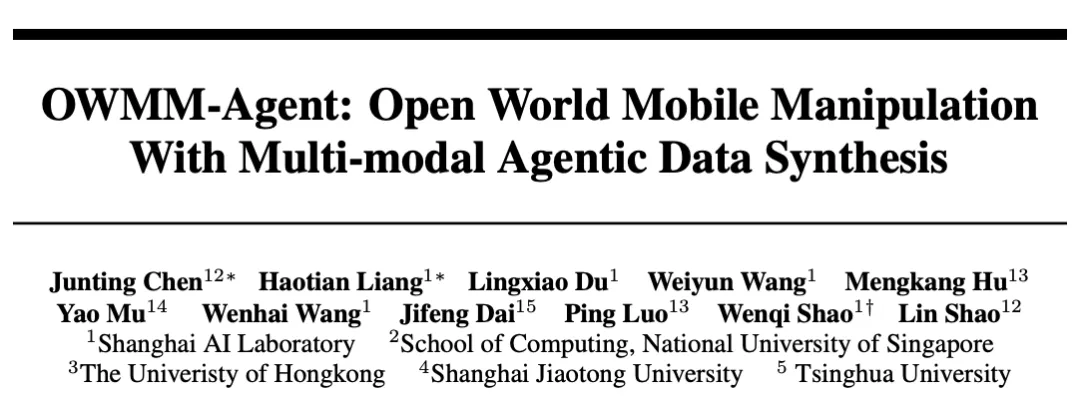

1. 多模态 Agent 架构

通过将开放世界移动操作(OWMM)问题建模成多轮,多图推理和定位 (Grounding) 问题,让多模态大模型进行端到端的感知 - 推理 - 决策 - 状态更新过程。

-

长期环境记忆:利用预映射阶段获取的多视角场景图像(如图 1 中的历史帧),构建全局场景理解能力,支持复杂指令的空间推理(如 “从吧台凳取物并放到沙发”);

-

瞬态状态记忆:以文本形式跟踪机器人实时状态(如 “已抓取物体,正接近目标位置”),辅助 VLM 生成上下文相关的动作序列;

-

动作空间设计:VLM 模型直接输出动作 handle 和 Ego-centric Obsersavation RGB 空间的坐标参数,通过函数调用传统路径规划器(Path Planner)和机械臂运动规划器(Motion Planner),不依赖预定义策略技能库。

图 1:OWMM-Agent 框架和动作接口设计

2. 多模态 Agent 微调数据合成

针对 VLM 基座模型在机器人领域的 “幻觉” 问题,团队设计了基于 Habitat 仿真平台的数据合成方案:

-

任务模板驱动:基于 Habitat 仿真环境,通过 PDDL 语言定义任务流程,自动生成 OWMM episodes。最终数据集基于 143 个仿真场景,157 种可抓取物体和 1471 个容器,采集了 20 万 + 条的多图加文本数据集;

-

符号世界建模:利用仿真环境的真值数据(如物体坐标,机器人状态,PDDL 世界状态),标注多图像 - 文本 - 动作对,避免人工标注成本;

-

多模态增强:通过 GPT-4o 重写思维链和文字总结内容、引入机器人第一视角图像,增强数据多样性和语义接地能力。

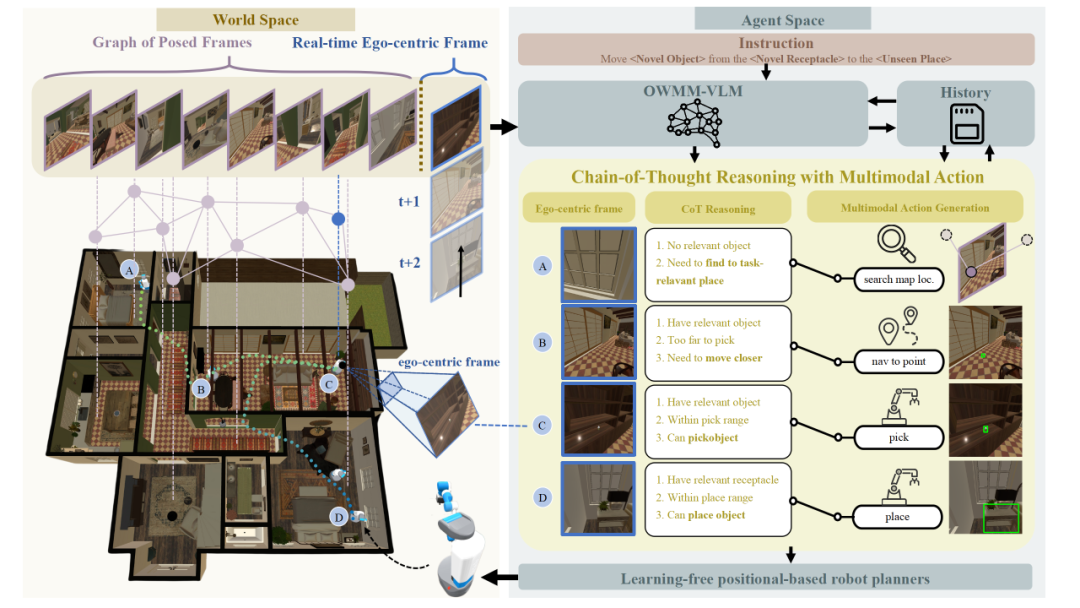

团队利用仿真合成的多模态数据,基于 Intern-VL 2.5 8B/38B 微调得到用于 OWMM 的专用模型 OWMM-VLM。

图 2: OWMM-VLM 模型

三、实验验证:模拟与真实环境双突破

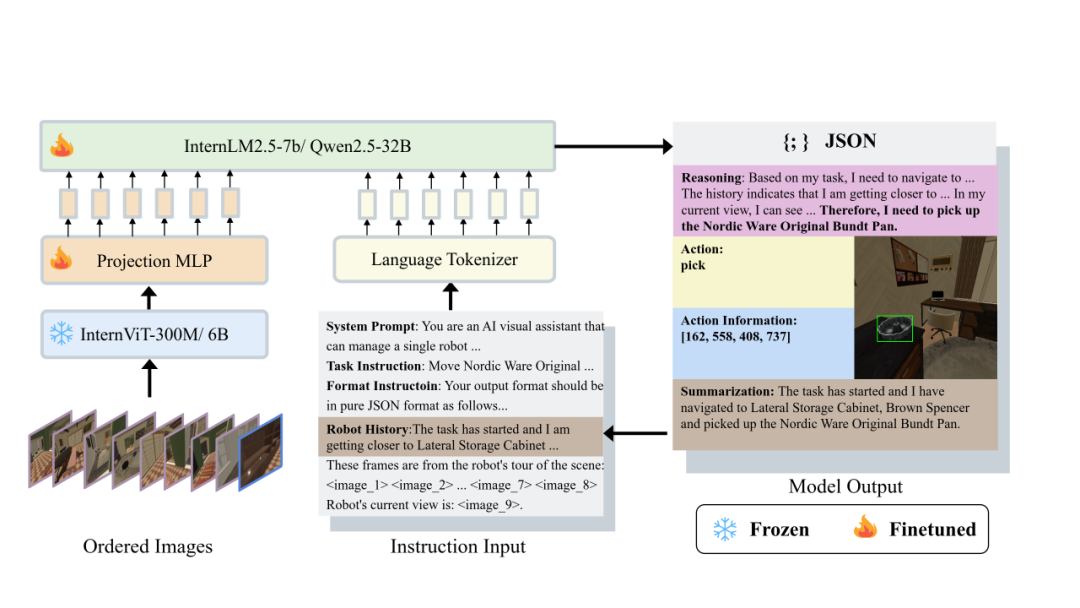

在模拟环境中,OWMM-VLM 模型展现出显著优势:

-

单步能力:在 “Ego-centric 动作决策”“图像检索”“动作定位 (Action Grounding)” 三项核心任务上,380 亿参数的 OWMM-VLM-38B 模型准确率分别达 97.85%、87.54% 和 88%,远超 GPT-4o(48.53%、46.46%、7%)和模块化方案(如 GPT-4o+RoboPoint);

-

完整序列任务:在 308 次模拟测试中,OWMM-VLM-38B 在整个 OWMM 长序移动抓取任务成功率达 21.9%,且零死循环;而基线模型由于大量幻觉和误差累积,成功率低于 1%,且频繁陷入死循环。

图 3:Habitat 仿真环境单步动作和完整 OWMM 序列测试结果

更值得关注的是真实环境测试:在 Fetch 机器人上,模型仅通过模拟数据训练,即实现了 90% 的零样本动作生成成功率(30 次测试中 27 次成功)。例如,在 “将豆奶盒从书桌移至会议桌” 任务中,模型准确检索目标位置、规划导航路径,并生成机械臂抓取坐标,展现出强泛化能力。在真机部署实验中,团队采用了 Robi Butler 工作提供的人类通过 VR 设备控制室内机器人系统的多模态接口,并迁移到 OWMM-Agent 框架中。

四、未来展望:迈向通用家庭机器人

该研究首次证明,通过大规模模拟数据微调的 VLM 模型,可成为开放世界移动操作的通用基础模型。同时这篇工作也存在局限性,当前方法假设有一个相对理想的环境重建,并假设目标任务相关的观测已经在记忆中,且对复杂机械臂(如多指手)的控制能力有限。

随着老龄化社会对服务机器人需求的激增,OWMM-Agent 的突破为 “会听、会看、会做” 的通用家庭助手奠定了关键技术基础。或许在不久的将来,我们真能迎来 “一句话指挥机器人完成家务” 的智能生活。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com