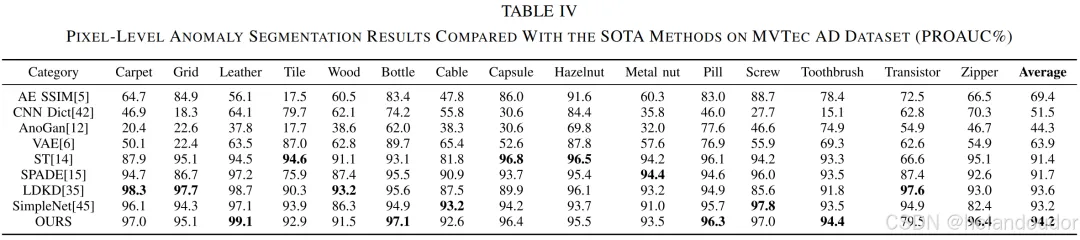

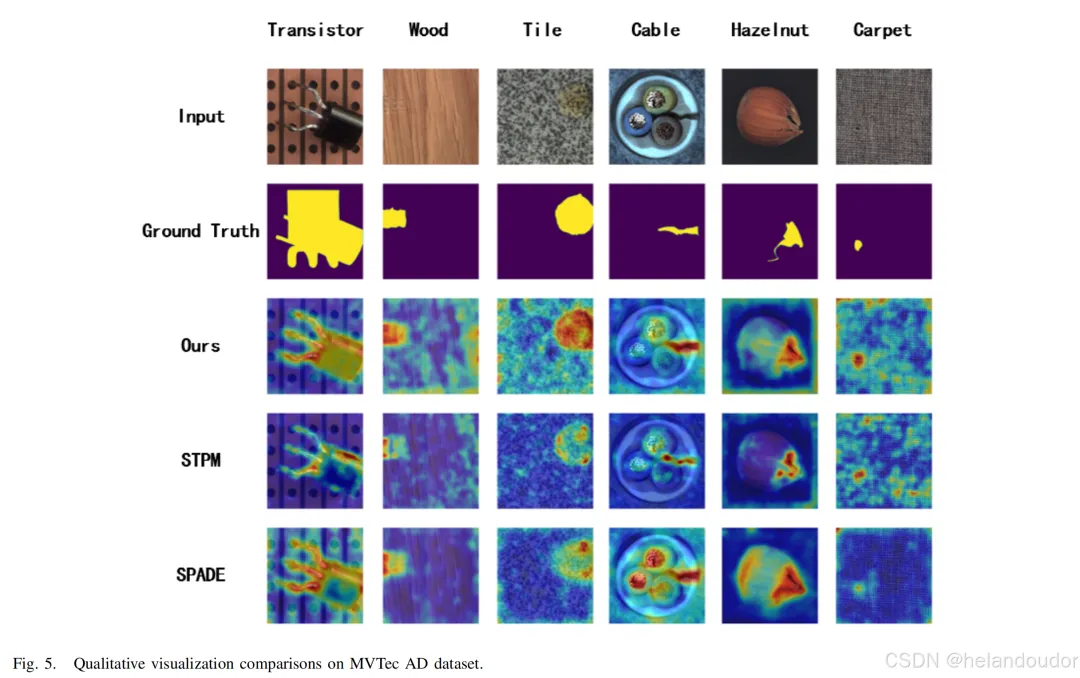

提出双分支知识蒸馏(DBKD)模型用于异常分割,通过多尺度输入重建和特征提取增强模型表示能力,在MVTec AD数据集上达到SOTA。

原文标题:TIM 2025 | 通过残差特征聚合模块的双分支知识蒸馏用于异常分割

原文作者:数据派THU

冷月清谈:

怜星夜思:

2、论文中提到的残差特征聚合模块(RFAM)是如何平衡计算效率和特征表示质量的?

3、知识蒸馏中,教师网络的选择对学生网络的性能影响大吗?如果想进一步提升DBKD的效果,除了优化网络结构和损失函数,还可以从哪些方面入手?

原文内容

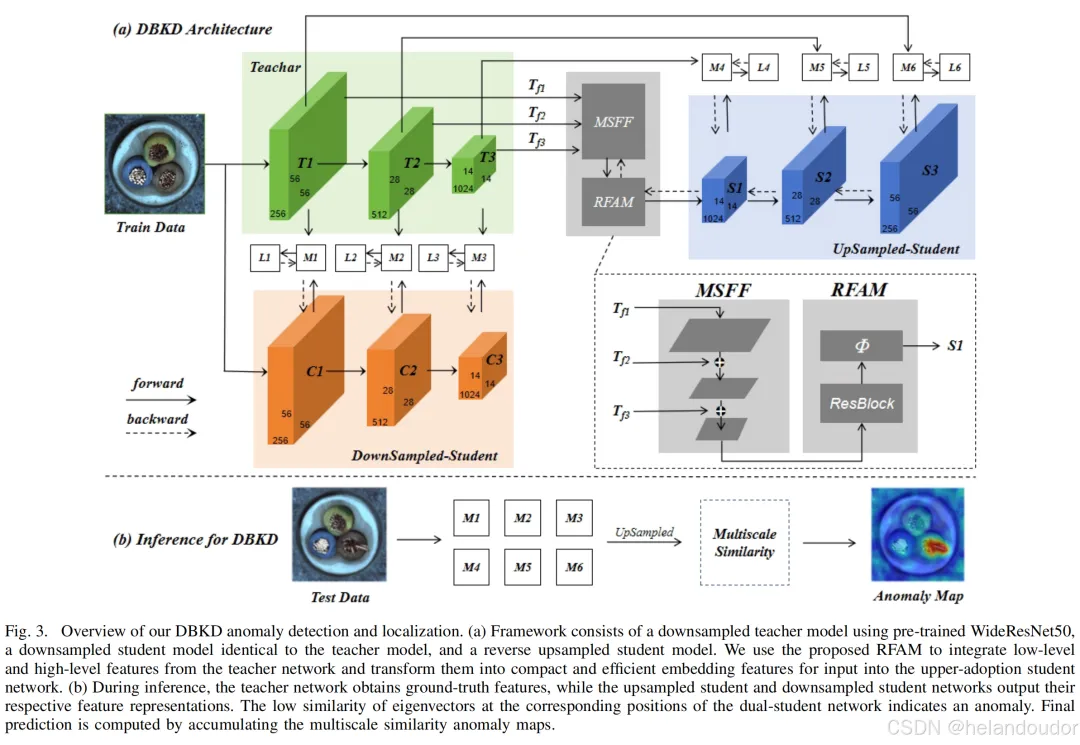

来源:PaperEveryday本文约2800字,建议阅读5分钟本文通过提高模型表示的多样性来解决异常响应消失的问题。本文提出的双分支知识蒸馏(DBKD)模型中的多尺度输入重建分支通过恢复输入的多尺度表示来提高其表示能力。

论文信息

题目:Dual-Branch Knowledge Distillation via Residual Features Aggregation Module for Anomaly Segmentation

通过残差特征聚合模块的双分支知识蒸馏用于异常分割

作者:You Zhou, Zihao Huang, Deyu Zeng, Yanyun Qu, Zongze Wu

源码链接:https://github.com/EWAN9709/DBKD

论文创新点

-

双分支知识蒸馏框架:论文提出了一个双分支知识蒸馏(DBKD)框架,通过引入多尺度输入重建分支和多尺度特征信息提取分支,增强了模型对异常样本的表示能力。

-

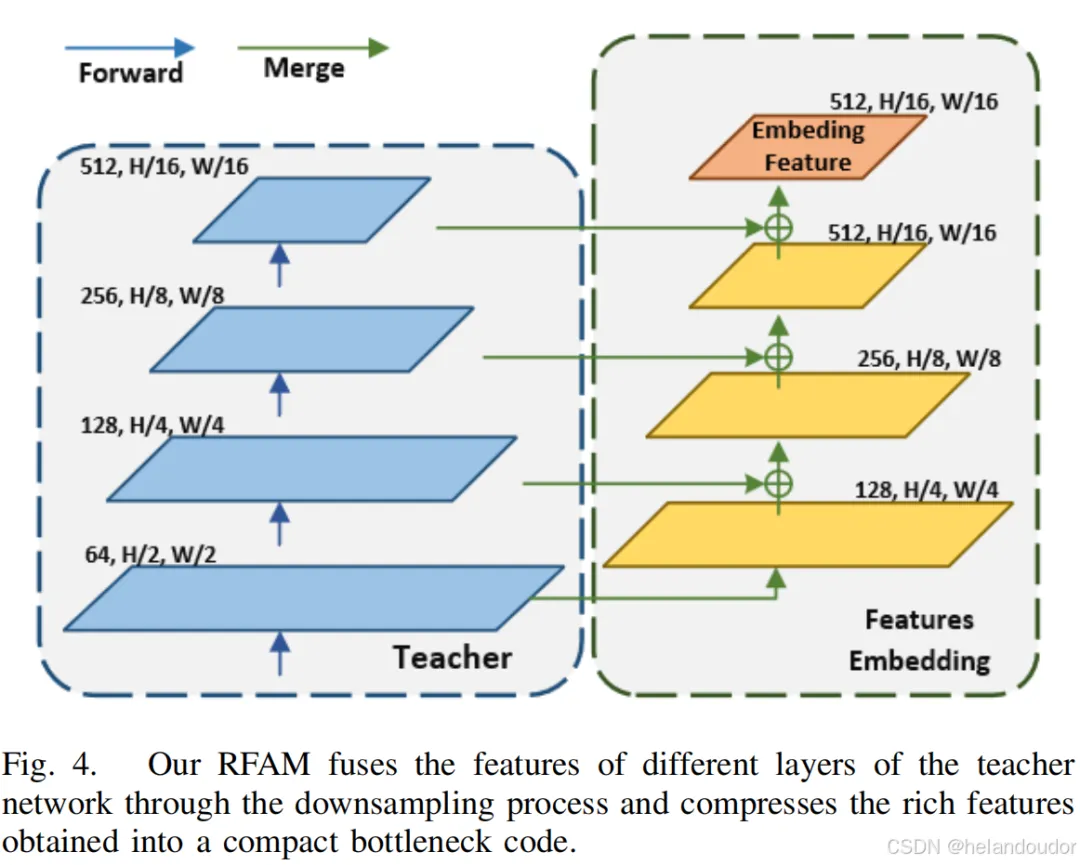

残差特征聚合模块(RFAM):作者设计了一个残差特征聚合模块(RFAM),用于将教师网络的高维特征压缩为紧凑且有效的低维特征嵌入。

-

余弦相似度损失函数:论文提出了一种基于余弦相似度的损失函数,用于衡量教师网络和学生网络之间的特征差异。

-

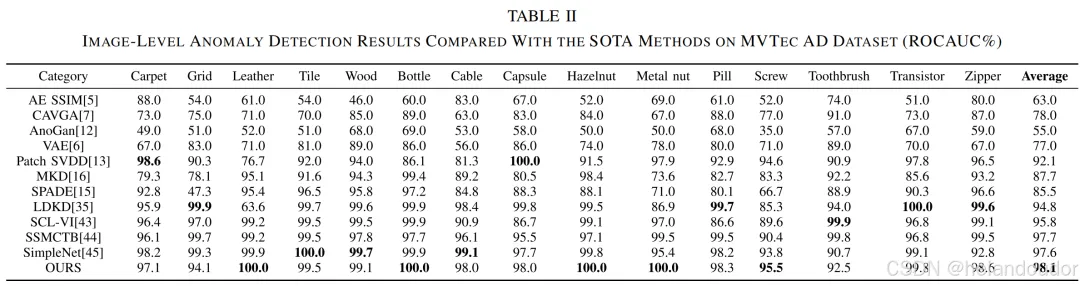

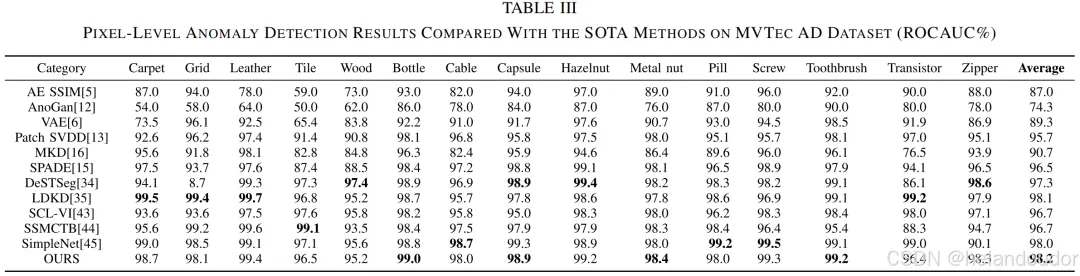

多尺度异常检测与分割:通过多尺度特征提取和多尺度输入重建,DBKD框架能够在多个尺度上捕捉异常信息,从而在图像级异常检测和像素级异常分割任务中取得了显著的性能提升。

摘要

关键词

III. 双分支知识蒸馏框架

架构

残差特征聚合模块

损失函数

IV. 实验

声明

编辑:文婧