《百面大模型》被誉为大模型面试宝典,深入剖析核心技术,精选高频真题,助你系统理解大模型原理,从容应对面试。

原文标题:读者口碑爆棚,这本书凭什么被夸“质量太高”?

原文作者:图灵编辑部

冷月清谈:

怜星夜思:

2、《百面大模型》强调“面试官不是想听标准答案,而是想看你怎么思考!”,你怎么理解这句话?在面试中,除了背诵知识点,还应该注意哪些方面来展现自己的思考能力?

3、这本书针对的是大模型面试,但书中的知识对于非求职者来说,比如想了解大模型的技术爱好者,或者想将大模型技术应用到自己工作中的人,是否有价值?为什么?

原文内容

你有没有这样的时刻:

明明看了无数博客论文,面试时却还是不知道从哪里讲起?

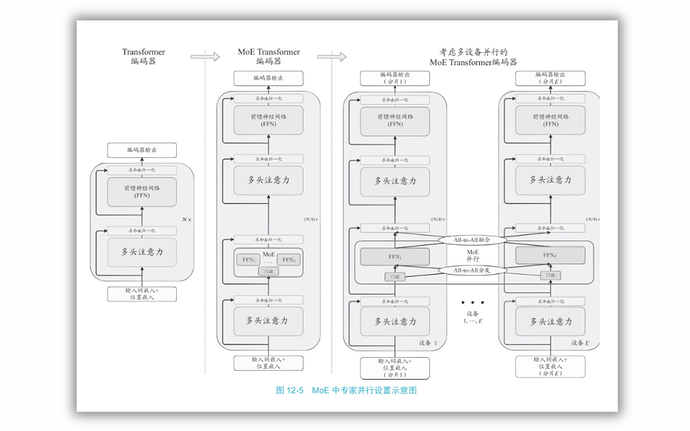

明明做过项目,但一遇到 MoE、RLHF、FlashAttention、PPO 就语塞?

明明刷了不少题,可越刷越觉得自己“只知其然,不知其所以然”?

不是你不够努力,而是大模型知识点太碎,鲜有人能把大模型面试中那些要点一一讲清楚。

如果想要系统地理解大模型,还真不能只是靠背术语、记答案。你需要的是一个结构清晰、逻辑严密、能讲出原理的体系。

而这,正是《百面大模型》带给你的。

最近,这本《百面大模型》在技术圈悄悄火了起来。很多人看完只说了一句话:“质量太高了,终于有人把大模型面试讲清楚了。”

这本书,被很多人夸“质量太高”,不是因为写得深奥、写得大而全,而是因为它终于不是一味地堆概念、列名词,这本书就像一个经验丰富的导师,把你“说不清、理不顺、想不明”的部分,一步步地掰开讲透。

不是纸上谈兵,而是真·技术人写给技术人的书。

其他的面试书教你怎样刷题,《百面大模型》教你怎么思考;别的面试书给你罗列“要背的知识点”,这本书帮你搭建技术框架。

那么,这本书到底牛在哪里?简单列几条:

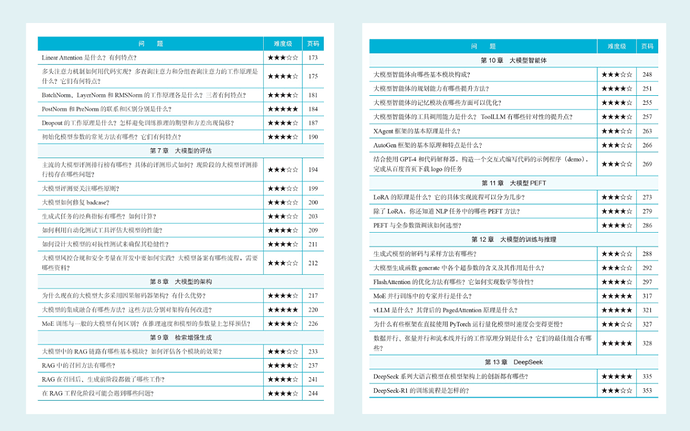

🔥 全书精选 100 道高频面试真题,按难度(2 星到 5 星)和模块分级,比你见过的其他面经都系统详细。

🧠 覆盖当前主流大模型核心机制:MoE、PEFT、RLHF、RAG、智能体、FlashAttention、GRPO、DPO 等等,采用一问一答的形式,帮你真正讲明白技术原理,而不是简单堆积概念。

📚 真讲原理,不搞玄学。作者一句话点醒很多人:“面试官不是想听标准答案,而是想看你怎么思考!”

而且它不是东拼西凑的资料合集,内容设计符合当下大厂面试需求,还曾命中过面试真题。主创团队经验丰富:

-

5w+ 粉丝 AI 大 V“包包大人”领衔撰写;

-

美团大模型技术专家 & 北航技术新锐联合创作;

-

还获得了刘群、周明、王树森、黎彧君、LLaMA Factory作者等 8 位大佬实名推荐!

这不是吹,是实打实的圈内认可!

今晚 20:00,图灵直播间邀请到《百面大模型》主创团队的 3 位大咖作者空降,带你深度拆解面试高频题,分享从投简历到拿 offer 的全过程。

另外还有图灵联合创始人刘江老师加入,分享他对大模型发展趋势的独家观察。从「求职实战」到「技术视野」,一次搞定。

除了作者直播演练高频题目的拆解思路,他们还会分享一些写书过程中的有趣故事。如果你正准备面试、想跳槽、想进大模型团队——这场直播,你真的不该错过。

动动手指预约起来吧~

如果你是:

-

正在准备大模型 /AI 岗位面试

-

想把工程经验梳理出体系

-

有项目没话术、有能力却“讲不明白”,面试就卡壳

-

准备转型大模型,但是知识架构不够系统

那么真心推荐你好好读一下这本《百面大模型》👇

《百面大模型》

包梦蛟,北京航空航天大学硕士,美团北斗计划高级算法专家,负责大众点评大模型应用落地开发,曾获得 Kaggle Grandmaster 称号、KDD CUP 2024 冠军,业余时间撰写知乎专栏和公众号“包包算法笔记”,全网关注数 5 万+。

刘如日,北京航空航天大学硕士,研究兴趣为机器学习与自然语言处理。曾以第一作者身份发表顶会论文并多次在顶会竞赛中取得冠军等优异成绩。现于美团从事大模型相关技术研究与产业应用。

朱俊达,北京航空航天大学硕士,研究兴趣为大模型架构优化方向,有多家大厂实习经历,发表了多篇大模型相关论文。