NTU博士论文探讨深度学习与归纳逻辑程序设计融合,提出GALOIS和FRGR框架提升泛化能力和学习效率,并评估LLM在ILP基准上的推理能力。

原文标题:【NTU博士论文】当深度学习遇上归纳逻辑程序设计

原文作者:数据派THU

冷月清谈:

怜星夜思:

2、FRGR框架如何动态识别并总结反复出现的错误模式?这种动态识别错误模式的方法在其他深度学习任务中是否适用?

3、论文中提到LLM在ILP基准上的推理能力明显弱于神经程序归纳系统,这是否意味着当前的LLM并不擅长逻辑推理?未来的研究方向应该如何发展?

原文内容

来源:专知本文约1000字,建议阅读5分钟在本论文中,我们旨在提升现有方法的泛化能力,以及学习能力与整体性能表现。

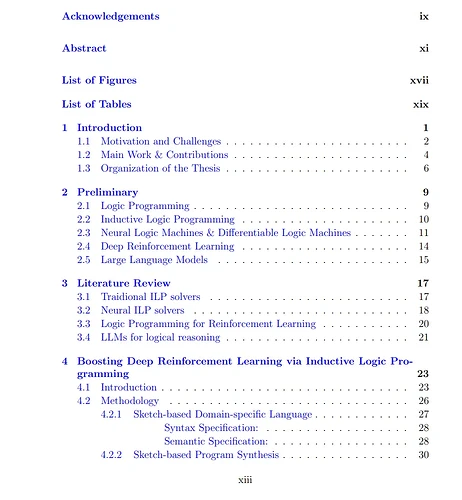

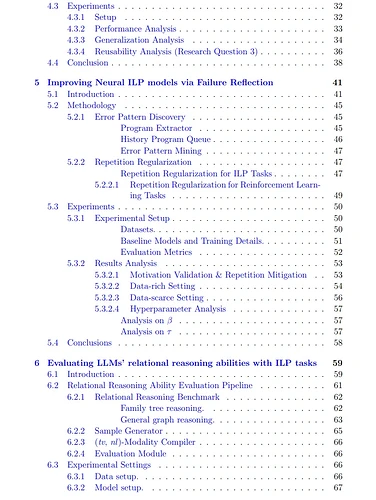

将归纳逻辑程序设计(符号主义)与深度学习(联结主义)相结合,已引起研究者广泛关注,成为提升推理能力的一项新兴研究方向。然而,目前的融合仍不完善,尤其体现在模型泛化能力差、学习效率低等问题上。在本论文中,我们旨在提升现有方法的泛化能力,以及学习能力与整体性能表现。此外,我们还计划就大语言模型在归纳逻辑程序设计任务中的推理能力进行全面评估。

首先,为了提升现有基于逻辑的深度强化学习(DRL)算法的泛化能力,我们提出了一个新颖的框架,称为 GALOIS。该框架能够综合层次结构和明确的因果逻辑,自动合成白盒程序。它采用程序草图(program sketch)机制,并引入了一种新的基于草图的编程语言,用于引导程序合成过程。基于此,GALOIS 实现了一种草图驱动的程序合成方法,可生成具备可解释性和良好泛化能力的白盒因果推理程序。在多个复杂决策任务上的全面评估表明,GALOIS 在学习能力、泛化能力、可解释性以及跨任务知识迁移方面均优于主流强化学习方法及此前的最先进程序引导方法。

接下来,我们观察到当前最先进的神经归纳逻辑程序设计(ILP)模型在训练时需要大量的训练迭代和样本。此外,在处理需要复杂逻辑推理的任务时,这些模型在性能与泛化能力方面仍存在明显不足。为此,我们提出了一个新的框架:失败反思引导正则器(Failure Reflection Guided Regularizer, FRGR)。FRGR 能够在模型训练过程中动态识别并总结反复出现的错误模式;随后,对未来训练过程中再次犯下类似错误的行为给予惩罚。此机制促使模型避免重复性错误,从而加速模型收敛,并获得更优且性能更强的解决方案。在多个关系推理与决策任务上的实验结果表明,FRGR 在提升神经 ILP 模型的性能、泛化能力与学习效率方面具有显著成效。

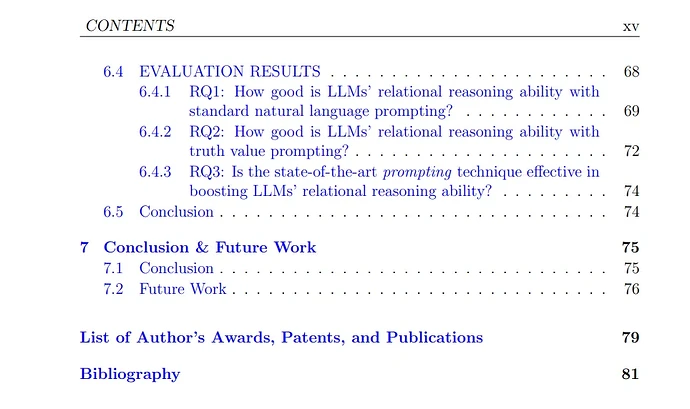

最后,尽管神经 ILP 求解器的性能已有提升,但近年来,研究者对大语言模型(LLMs)推理能力的兴趣迅速上升。然而,已有工作中使用的文本与数值推理基准多数较为浅显和简单,仅凭在这些基准上的正向结果,尚不足以断言 LLM 拥有强大的推理能力。近期研究表明,在基于强化学习的基准中,LLM 在需要常识性规划的序列决策问题上表现较差。为此,我们在本研究中,基于 ILP 基准对多种最先进的大语言模型进行了深入推理能力评估。ILP 被广泛认为是评估逻辑程序归纳/合成系统的代表性且具有挑战性的基准,因为它要求模型能够学习严谨的因果逻辑以实现在 IID(独立同分布)与 OOD(分布外)测试样本上的稳健推理。评估结果表明,与规模远小于 LLM 的神经程序归纳系统相比,当前最先进的 LLM 在推理能力上表现明显较弱——无论是采用自然语言提示还是真值矩阵提示,其性能与泛化能力均远逊色于神经 ILP 系统。