阿里云百炼平台助力用户10分钟上手开源模型冠军 Qwen3,体验其强大的推理能力、多语言支持和工具调用。

原文标题:10分钟上手全球开源模型冠军 Qwen3

原文作者:阿里云开发者

冷月清谈:

怜星夜思:

2、文章提到了 Qwen3 的思考模式和非思考模式,这两种模式在实际应用中应该如何选择?

3、文章中介绍了使用 Cherry Studio 客户端可以方便地调用 Qwen3 的工具,你认为大模型工具调用能力在未来的发展趋势是什么?

原文内容

5月9日,全球权威 AI 基准测试平台Artificial Analysis公布最新一期大模型榜单,阿里通义千问 Qwen3 智能水平位列全球前五,开源第一;同时 Qwen3 为所有顶尖模型中价格最低,推理成本不到 DeepSeek-R1 的1/3,是 Claude 3.7 的1/20。截至目前,Qwen3已斩获LiveBench、LiveCodeBench、SuperClue等多个榜单的全球开源冠军、国产模型冠军。

本文将介绍通过阿里云百炼平台调用 Qwen3 开源模型,10分钟即可快速完成搭建!

模型亮点

推理能力显著增强

-

旗舰模型 Qwen3-235B-A22B 在代码/数学及通用能力测试中比肩DeepSeek-R1、o1 等顶级模型;

-

中型 MoE 模型 Qwen3-30B-A3B 性能超越 QwQ-32B;

-

小模型 Qwen3-4B 性能匹敌 Qwen2.5-72B-Instruct。

两种模式无缝切换

-

思考模式逐步分析,适合复杂问题;非思考模式即时响应,适合简单问题。

-

一个模型支持两种模式,无需部署多个模型来分别适配复杂和简单任务。

多语言支持扩展

-

支持 119 种语言和方言,覆盖全球主要语种。

Agent 能力增强

-

优化了 Agent 和代码能力,原生支持 MCP,能更精准地调用工具。

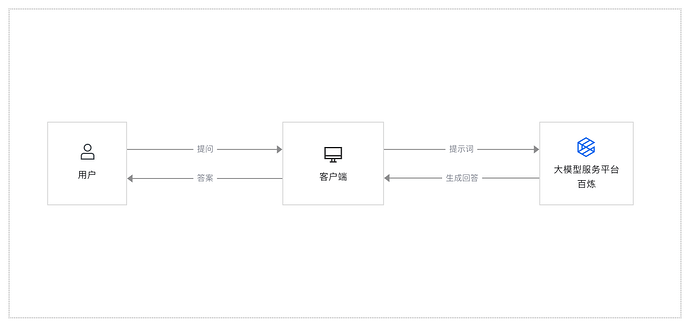

方案架构

阿里云百炼平台提供标准化接口,免去了自行构建模型服务基础设施的麻烦,并支持负载均衡及自动扩缩容,确保了 API 调用的稳定性。此外,结合使用 Cherry Studio 可视化界面客户端,用户无需进行命令行操作,即可通过直观的图形界面体验 Qwen3 模型思考模式的丝滑切换与工具调用能力。

配置完成后,会在本地搭建一个如下图所示的运行环境。

实践部署

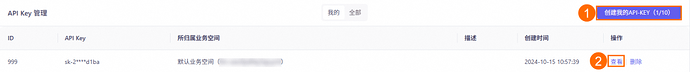

1)获取百炼 API-KEY

访问阿里云百炼控制台[1],在已创建的 API Key 操作列,单击查看,获取 API KEY。

2)下载 Cherry Studio 客户端

访问 Cherry Studio [2]下载并安装客户端。(Cherry Studio 是业界主流的大模型对话客户端且集成了 MCP 功能,可以方便地与大模型进行对话。)

3)配置 API 并进行对话

单击左下角的设置按钮,在模型服务栏中找到阿里云百炼,在API 密钥输入您前面获取的 API Key;

在API 地址输入:

https://dashscope.aliyuncs.com/compatible-mode/v1/;单击添加。

在模型 ID填入您需要使用的 Qwen3 模型,此处以 qwen3-235b-a22b 为例; 您也可以填入其他 Qwen3 模型 [3]。

模型体验

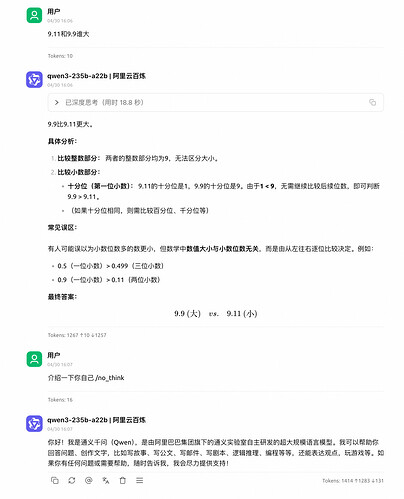

1)快速体验 Qwen3 模型

回到对话框界面,在顶部选择模型后开始对话。Qwen3 模型提供了通过 prompt 来控制开启或关闭思考模式的功能。可以在 prompt 加上/no_think的后缀,使 Qwen3 模型在之后的回复关闭思考模式。若需要重新开启思考模式,只需在最新输入的 prompt 加上 /think 后缀。

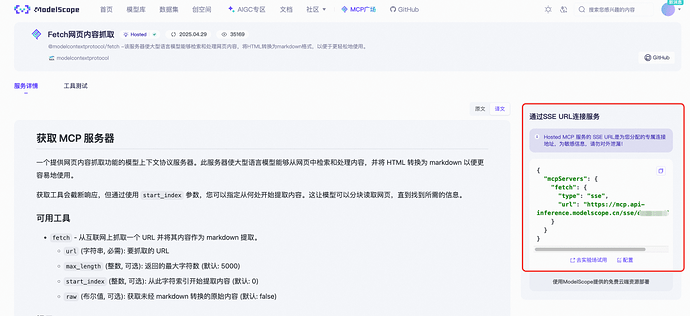

2)体验 Qwen3 的工具调用能力

Qwen3 的工具调用能力得到了较大提升,且加强了 MCP 方面的能力。此处以接入 ModelScope 提供的Fetch 网页抓取[4] MCP 服务器为例,可以通过 SSE URL 连接服务,获取专属URL。

单击 Cherry Studio 左下角的设置按钮,单击 MCP 服务器,在新页面中单击添加服务器后进行以下配置:

|

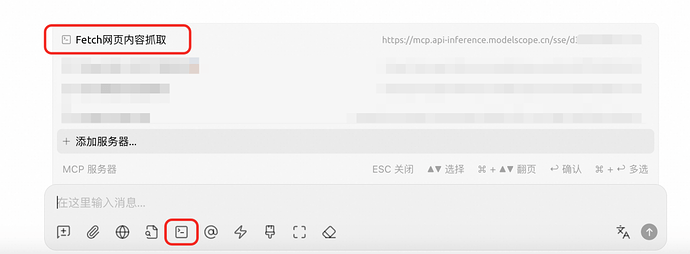

保存后回到对话框,单击 MCP 服务器的图标,并选中添加的 Fetch 网页内容抓取。

此时 MCP 服务器的图标变绿,向输入框输入问题 “https://qwenlm.github.io/blog/qwen3/ 请一次性提取这个网页,然后回答我的问题:qwen3 有哪些模型?”

Qwen3 模型会通过Fetch网页内容抓取工具获取指定网页的内容,并准确回答问题:

清理资源

进入 API Key 管理页面[1],找到目标 API Key 进行删除,删除后将无法通过该 API Key 调用百炼提供的模型。

快点击阅读原文体验搭建吧~

参考链接:

[1] https://bailian.console.aliyun.com/?spm=a2c6h.28997786.0.0.79487d1avrcQ01&tab=model#/api-key?utm_content=g_1000403723

[2] https://docs.cherry-ai.com/cherry-studio/download

[3] https://help.aliyun.com/zh/model-studio/models?utm_content=g_1000403724

[4] https://www.modelscope.cn/mcp/servers/@modelcontextprotocol/fetch?utm_content=g_1000403725