英伟达收购Lepton AI后将停止其运营,引发行业关注。Lepton AI由贾扬清创立,提供AI云平台服务。此次收购或为英伟达掌控AI算力产业链。

原文标题:英伟达停止运营Lepton AI,贾扬清回应:不是人才收购

原文作者:AI前线

冷月清谈:

怜星夜思:

2、英伟达收购Lepton AI后却选择关闭其服务,你怎么看待这种“反常”操作?你认为英伟达真正的目的是什么?

3、文章中提到英伟达想要打造一个 AI 工厂,直接成为客户的收入来源。你认为这种模式会对现有的 AI 产业格局产生什么影响?

原文内容

近日,网上曝出 Lepton AI 已通知用户,Lepton 将于 2025 年 5 月 20 日正式停止运营,此后用户将无法再访问 Lepton AI 平台上的服务或提交的数据,建议用户在该日期之前尽快下载或备份所需数据。服务终止时,若用户账户中仍有未使用的积分,官方将会在关停后予以退款处理。

不仅如此,官方网站已经禁止新账户注册,显示正在维护。

Lepton AI 的官方推特显示也已经被注销。

就在大约两周前,The Information 报道,英伟达已完成对 Lepton AI 的收购,交易价值数亿美元,知情人士透露称创始人贾扬清及联合创始人白俊杰都已加入英伟达,目前还不清楚具体担任职位。

值得注意的是,黄仁勋还一直称英伟达是一家软件公司, Lepton Al 创始团队都是软件方面的顶尖人才,或许这也是双方契合的一点。

收购消息刚被曝出来时,许多人猜测英伟达收购后是会仅保留机器学习人才、大砍业务,还是会继续运营 Lepton AI 的云平台。目前看来,英伟达似乎更在意的人才,而非其相关具体业务,毕竟如今已经选择了关闭服务。

对此,InfoQ 向 Lepton Al 方面进行了求证,贾扬清对此回应称: 无法评论,不过不是人才收购。

交易完成时 Lepton AI 约有 20 名员工,目前还未有消息指出这些员工的去留。英伟达此番价值可能达数亿美元的收购,实现了让 LeptonAI 投资方红杉中国、CRV 和 Fusion Fund 较为可观的退出,大约在两年前他们参与了该公司 1100 万美元的种子轮融资。

Lepton AI 成立还不到两年的时间。两位创始人在业内都颇有名气:贾扬清在博士期间创立并开源了深度学习框架 Caffe,白俊杰是开放式神经网络交换标准 ONNX 的共同创始人以及 Caffe2 的核心开发者。贾扬清先后在谷歌、Meta 任职多年,2019 年 3 月起在阿里担任技术副总裁。白俊杰也曾分别在 Meta、阿里云任职。两人担任 AI 研究员时,共同开发了 PyTorch 框架。

2023 年 3 月,贾扬清离开阿里云,四个月后宣布联合创立了 Lepton AI。他们创业时,正值国内“百模大战”,贾扬清等人没有直接入局大模型,而是选择成为大模型的基础设施提供商。不过,他们自己没有购买 GPU,而是用租用的方式,然后对外提供算力租赁等服务。这种模式被称为是典型的“人工智能即服务 (AIaaS) ”,即通过云计算平台预配人工智能 (AI) 服务和工具。

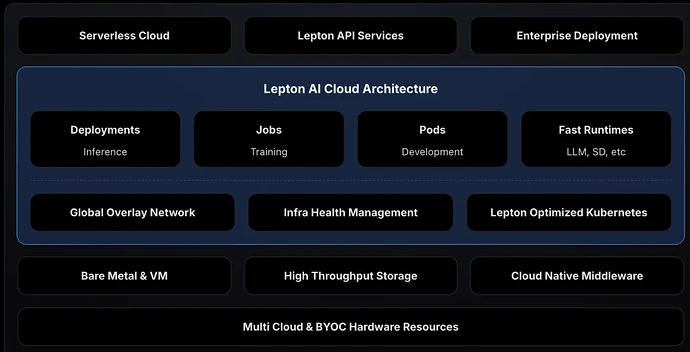

Lepton AI 整个团队主要在海外,所以目标客户主要为海外企业和国内想要拓展海外市场的企业。官网显示,Lepton 的服务主要包括:

-

全托管的 AI 云平台 Lepton:支持模型的开发、训练和部署,包括开箱即用的 Serverless 接口,兼容 OpenAI API;完全自定义的专属推理接口;支持运行分布式训练或批处理作业等。

-

企业版 Lepton:管理节点组,同时允许用户使用自有服务器创建自托管的节点组。

-

Python SDK,帮助用户构建 AI 应用。

与 Lepton AI 同名的云平台专为 AI 工作负载优化,用户可以在平台上进行模型训练和推理。该公司提供了一个可视化界面,帮助用户在其云平台上配置训练集群,并支持多款 Nvidia 显卡选择。对于需要并行训练多个模型的团队,平台还提供了一种集中管理每个项目分配硬件资源的工具。

在模型训练过程中,有时会出现降低输出质量的错误,Lepton AI 的平台具备检测此类错误的功能,同时还能发现更为隐蔽的技术问题,比如神经网络在训练过程中使用了超出预期的内存等。

模型开发完成后,Lepton AI 用户可以将模型部署在平台提供的推理优化实例上。该平台承诺,在推理过程中能够实现超过每秒 600 个 token 的处理速度,同时将延迟控制在 10 毫秒以内。平台还具备自动扩展功能,当推理需求增加时,可自动为客户增加计算资源。

Lepton AI 还采用开源工具 vLLM 来加速推理。该技术能够将相似的大模型提示合并成一次请求,从而减少模型所需处理的计算量。开发者还可借助 vLLM 降低模型的内存占用。

此前,贾扬清在接受 时表示,团队在技术实现上没用什么“黑科技”,而是将很多耳熟能详的单点技术结合起来,以实现成本的显著降低,如大模型处理服务收到大量请求时的动态批处理(Dynamic Batch)、用小模型预测数个 token 的预测解码等。具体如何实现单点技术的有机结合,就是他们工作的重点和难点。

期间,团队还基于 Lepton 做了一些产品 demo。比如,贾扬清曾在其社交平台分享了他基于 Lepton Al 实现的 AI 搜索引擎 (类似 Perplexity),而且只用了不到 500 行代码。这个项目当时引起了大家热议,目前也已经开源,斩获 8.1k 颗星。

Lepton Al 开源了旨在通过主动监控 GPU 和有效管理 AI/ML 工作负载来确保 GPU 效率和可靠性的 GPUd。据悉,GPUd 基于团队多年来在 Meta、阿里云、Uber 和 Lepton AI 运营大规模 GPU 集群的经验而构建,能与 Docker、containerd、Kubernetes 和 Nvidia 生态系统等无缝集成。

“通过这些产品,我们可以展示自己在开源模型上能做的事情,以及 Lepton 平台帮助用户构建应用的能力。”贾扬清曾表示。团队希望通过这些产品或 demo 可以在用户中形成好的口碑,当有人需要部署大模型时就会想到 Lepton AI。

贾扬清还积极对外分享最新的大模型进展思考。比如 DeepSeek 爆火后,贾扬清分析称,它的成功更多体现了纯粹的智慧与务实:在计算资源和人力有限的前提下,通过聪明的研究方法,产出最好的成果。这与当年 Alex Krizhevsky 在只有两块 GPU 的情况下造出 AlexNet 模型一样,靠的不是超大规模集群,而是扎实的能力。

目前,贾扬清的 x 分享停留在了 3 月中旬。

AI 爆发后面临的主要问题就是缺算力。为了减少投入,不少企业“由买转租”,这催生了算力租赁的诞生,算力租赁价格一年就可实现翻倍。

北美和欧洲地区仍是算力租赁市场的主导者。像 CoreWeave 是挖矿起家,英伟达通过投资支持、供货保障等方式扶持 CoreWeave。CoreWeave 采用“GPU 即服务”(GAAS)模式,拥有 32 个数据中心,运行超 25 万 + GPU,主要服务微软、英伟达、OpenAI、Meta、Google 等北美大客户。而欧洲本地云服务商 Nebius,在芬兰拥有一个部署了约 2 万个 GPU 的数据中心。受益于欧洲扶持政策,Nebius 以短期租赁性价比取胜。值得注意的是,Nebius 也获得了英伟达的投资。

值得注意的是, Lepton AI 与英伟达若干主要客户的服务存在竞争关系,其中包括 AI 云服务商 CoreWeave。贾扬清去年 6 月时曾透露,Lepton AI 的客户数量和整体营收都处于非常健康的增长状态,他对此也比较满意,验证了团队之前的想法和产品在用户中的接受度。

对于英伟达此次收购 Lepton Al 的目的,业内猜测是其欲试图完全掌控供应链,而不仅仅是负责制造部分。与其只出售显卡或 AI 芯片,英伟达选择提供完整的解决方案:自己开发芯片、组装服务器、再提供租赁服务。这正是人们常说的“垂直整合”——一家公司掌控从上游到下游的整个流程。

这种垂直整合策略让英伟达能够从芯片设计到算力租赁的全产业链中获利,同时还能更好地控制其 GPU 芯片的使用方式和价格策略,进一步增强其在 AI 计算领域的主导地位。

通过这一策略,英伟达还成功规避了一个行业中常见的问题:库存积压。当市场降温、销量下滑时,许多公司往往会被大量滞销的设备所拖累。但如果英伟达可以自己出租服务器,就能让设备始终保持运转状态,同时还能继续从中盈利。

SemiAnalysis 指出,通过收购 Lepton,英伟达不仅获得了额外的收入来源,还可能挤压其他云服务提供商的生存空间。通过打造这套自有体系,英伟达也更有能力与亚马逊、谷歌和微软等巨头竞争,它们同样在 AI 领域布局,并采用定制芯片(也就是常说的 ASIC)提供服务。

这也对应了黄仁勋的想法。他在今年 3 月的 GTC 大会上表示,英伟达不再是一家芯片公司,也不再是一家 AI 公司,而是一家算法和基础设施公司。

目前,英伟达正在投入构建 AI 基础设施,规划周期必须在上游和下游都延伸多年。黄仁勋想要把英伟达打造成一个 AI 工厂,直接成为客户的收入来源。“每个行业、每个国家、每家公司都来到这里,因为我们已经成为一个基础平台,其他公司可以在此基础上构建自己的业务。”

参考链接:

https://www.theinformation.com/briefings/nvidia-closes-acquisition-gpu-cloud-startup-lepton

https://www.infoq.cn/article/w155KHeD4mR860s7cPEz?utm_source=chatgpt.com

https://siliconangle.com/2025/03/27/report-nvidia-close-acquiring-ai-cloud-provider-lepton-ai-nine-figure-deal/

https://tecfoco.com.br/nvidia-compra-lepton-ai-e-entra-de-vez-no-aluguel-de-servidores-com-ia

声明:本文为 InfoQ 整理,不代表平台观点,未经许可禁止对全文或部分内容进行转载。

后续我将通过微信视频号,以视频的形式持续更新技术话题、未来发展趋势、创业经验、商业踩坑教训等精彩内容,和大家一同成长,开启知识交流之旅欢迎扫码关注我的微信视频号~