研究提出ManipTrans方法,高效迁移人类双手操作技能至灵巧手,并发布大规模灵巧手操作数据集DexManipNet。

原文标题:机器人也会挤牙膏?ManipTrans:高效迁移人类双手操作技能至灵巧手

原文作者:机器之心

冷月清谈:

怜星夜思:

2、DexManipNet数据集的发布,对于机器人灵巧手操作研究有哪些重要的意义?你觉得未来这个数据集可以如何扩展或改进?

3、文章中提到ManipTrans方法可以应用于不同型号的灵巧手,这种跨本体迁移能力在实际应用中有什么价值?你认为实现通用的机器人操作技能还需要克服哪些挑战?

原文内容

研究团队由来自北京通用人工智能研究院(BIGAI)、清华大学和北京大学的跨专业研究者组成,致力于具身智能领域的前沿研究。团队成员在开发高效、智能的通用机器人技术,特别是机械灵巧手操作方面,拥有丰富的研究经验。一作为北京通用人工智能研究院研究员李恺林,其它作者为清华大学博士生李浦豪、北京通用人工智能研究院研究员刘腾宇、北京大学博士生李宇飏;通讯作者为北京通用人工智能研究院研究员黄思远。

近年来,具身智能领域发展迅猛,使机器人在复杂任务中拥有接近人类水平的双手操作能力,不仅具有重要的研究与应用价值,也是迈向通用人工智能的关键一步。

目前,数据驱动的具身智能算法仍需要精确、大规模且高度灵活的灵巧手动作序列。然而,传统的强化学习或真机遥操作方法通常难以高效获取此类数据。

为了解决这一问题,北京通用人工智能研究院联合清华大学、北京大学的研究人员提出了一种两阶段方法——ManipTrans,可在仿真环境中高效地将人类双手操作技能迁移至机器人灵巧手。

-

论文地址:MANIPTRANS: Efficient Dexterous Bimanual Manipulation Transfer via Residual Learning

-

论文链接:https://arxiv.org/pdf/2503.21860

-

项目主页:https://maniptrans.github.io

-

代码与数据集:https://github.com/ManipTrans/ManipTrans

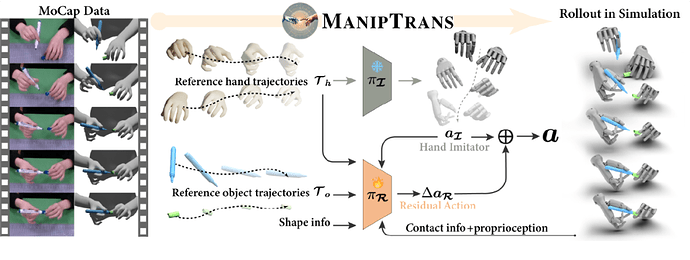

ManipTrans 首先利用通用轨迹模仿器的预训练模型模仿人类手部动作;然后针对不同的操作技能,引入残差学习模块,结合基于物理的交互约束进行精细调整(如图 1 所示)。该方法将动作模仿与物理约束分离,使复杂的双手任务学习更加高效,执行更加精准。

基于 ManipTrans,研究团队同时发布了大规模灵巧手操作数据集 DexManipNet,涵盖了如盖笔帽、拧瓶盖等此前未曾深入探索的任务。

图1. 基于ManipTrans实现相同操作技能的跨型号灵巧手技能迁移

研究背景

人类双手在与环境交互中发挥着关键作用,这激发了对机器人灵巧手操作的广泛研究。如何快速获取大规模、精确且接近人类水平的灵巧手操作数据,已成为亟待解决的问题。

现有的基于强化学习的方法需要精心设计针对特定任务的奖励函数,这通常限制了任务的复杂性,并可能导致机器人动作的不自然;另一类基于遥操作的方法成本高昂、效率低下,且所采集的数据通常针对特定的本体,缺乏通用性。

目前,一种有潜力的解决方案是通过模仿学习,将人类的操作动作迁移到仿真环境中的灵巧手上,以生成自然的「手-物交互」。然而,实现精确且高效的迁移并非易事。由于人手和机器人手在形态上的差异,直接进行姿态重定向的效果并不理想。并且,尽管动作捕捉得到的数据相对准确,但在高精度任务中,误差的累积仍可能导致任务失败。此外,双手操作引入了高维度的动作空间,显著增加了高效策略学习的难度,因此,先前的大多数工作通常止步于单手的抓取任务。

研究方法

图2. 本文提出的ManipTrans方法框架图

针对上述挑战,本文提出了一种简洁而有效的方法——ManipTrans(如图 2 所示),旨在实现操作技能,特别是双手协同技能,在仿真环境下从人手向机械灵巧手的迁移。核心思想是将迁移过程划分为两个阶段:第一阶段,实现手部运动的轨迹模仿;第二阶段,在满足物理交互约束的前提下,对动作进行微调。

具体而言,首先预训练一个通用模型,以准确模仿人类手指的运动;在此基础上,引入残差学习模块,对灵巧手的动作进行微调,着重针对以下两点:1)确保手指与物体表面的稳定接触;2)协调双手,保证复杂情况下双手操作的高精度和高保真执行。

本文将该问题建模为隐式马尔可夫决策过程(MDP),在两个阶段均采用 PPO 算法以最大化折扣回报。在第一阶段,设计奖励函数,约束灵巧手跟随参考的人手轨迹,同时确保动作的稳定性和平滑性。其中,手指模仿奖励函数「鼓励」灵巧手的关键点位置与人手保持一致,特别是与物体接触最频繁的拇指、食指和中指的指尖位置是否对齐,此设计有效解决了形态不一致的问题。

在第二阶段,残差模块输出动作的补偿项,通过与第一阶段的动作相加,实现微调。该模块额外考虑了以下信息:1)物体的质心位置和所受重力,以增强对力矩的感知;2)基于空间基点集(BPS)表示的物体形状;3)灵巧手关键点与物体的空间位置关系;4)仿真环境提供的指尖接触力。第二阶段特别加入了接触力奖励函数,鼓励更加稳定的手物接触。在训练过程中,引入了随机参考状态初始化和课程学习策略,提高了收敛速度和训练稳定性。

综上,ManipTrans 的设计在第一阶段缓解人手与灵巧手之间的形态差异,在第二阶段捕捉细微的交互动作。通过将手指模仿与物理交互约束解耦,显著降低了动作空间的复杂度,同时提升了训练效率。本文在一系列复杂的单手和双手操作任务中,验证了该方法的有效性和高效性,任务甚至涵盖了铰链物体的操作。为评估该方法的泛化能力,本文进行了跨本体的实验,验证了 ManipTrans 可应用于具有不同自由度和形态的灵巧手,无需额外参数调节。此外,基于 ManipTrans 方法得到的双手操作数据,也在真机部署中得到了验证。

DexManipNet 数据集

图3. 灵巧手白板写字

图4. 双手舀取物体

基于 ManipTrans 方法,本研究将两个大型「手-物交互」数据集(OakInk V2 和 FAVOR)迁移至灵巧手,构建了 DexManipNet 数据集。该数据集涵盖了 61 种具有挑战性的任务,包含对 1200 多件物体的 3300 条灵巧手操作序列,总计约 134 万帧的数据量。其中,约有 600 个序列涉及复杂的双手操作任务(如图 3、图 4 所示),充分展示了机器人在高难度操作场景下的能力。

图5. 灵巧手拨开牙膏盖

图6. 双手协同完成倾倒入试管操作

此外,研究人员在真机平台上重放(replay)了 DexManipNet 的数据轨迹,使用了两台有 7 个自由度的机械臂和一对灵巧手,部署结果展示了此前未曾实现的精细灵巧操作能力。例如,在「拨开牙膏盖」的任务中,左手稳固握持牙膏管,右手的拇指和食指灵巧地拨开小巧的牙膏盖,这些细微而复杂的动作往往难以通过遥操作精确捕捉(如图 5、图 6 所示)。

实验结果

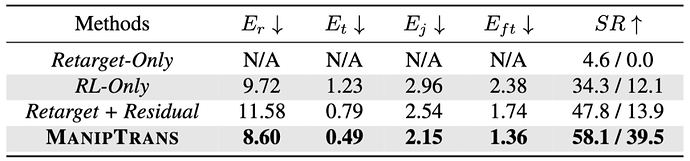

表1. ManipTrans与基线方法定量对比

本文将 ManipTrans 与两大类现有方法——基于强化学习的方法和基于优化的方法,进行了对比评估。结果显示,ManipTrans 在各项指标上均优于基线方法,展现了在单手和双手操作任务中的高精度(如表 1 所示)。定性和定量分析证实了,ManipTrans 的两阶段迁移框架能够有效捕捉手指的细微运动并与物体的交互,提高了任务成功率和运动的真实感。

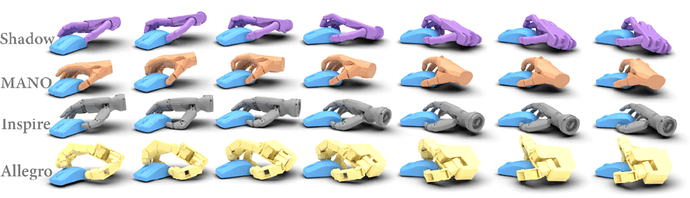

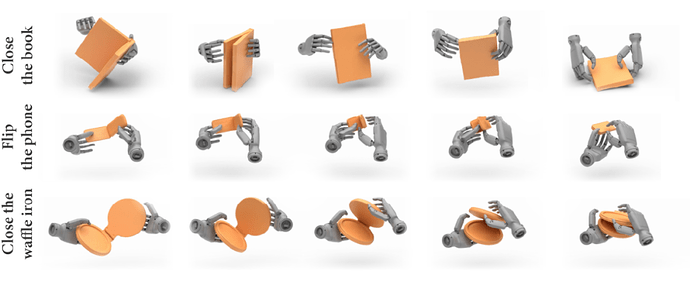

图7. 跨本体迁移实验

此外,研究展示了 ManipTrans 在不同型号灵巧手上的可扩展性。该框架仅依赖人类手指与灵巧手关键点之间的对应关系,无需过多参数调整即可适配不同形态和自由度的灵巧手(如图 7 所示)。文章还在铰链物体操作数据集 ARCTIC 上进行了验证。通过对奖励函数的微调,添加铰链物体运动角度奖励,成功实现了灵巧手对铰链物体的指定角度旋转操作(如图 8 所示),展现了 ManipTrans 方法在复杂操作任务中的潜力。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com