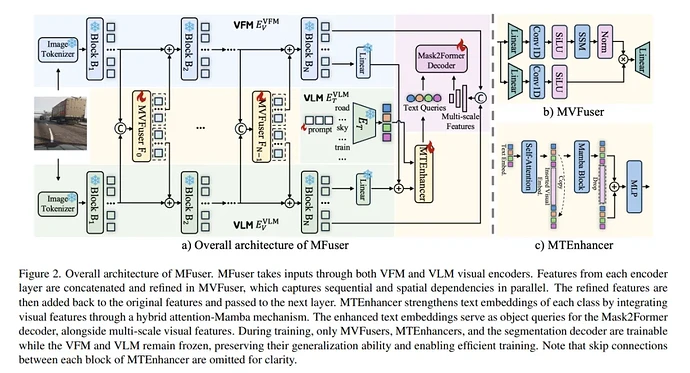

MVFuser主要负责视觉基础模型(VFMs)和视觉语言模型(VLMs)的联合微调,通过协同适配机制,捕捉时序和空间动态信息,让两个模型更好地协同工作。而MTEnhancer则专注于优化文本嵌入表示,它融合了注意力机制和Mamba,利用图像先验知识来提升文本表示的质量。如果缺少任何一个模块,都会影响模型整体的性能。缺少MVFuser,VFMs和VLMs可能无法有效地协同工作,导致特征提取和对齐出现问题;缺少MTEnhancer,文本嵌入表示可能不够准确,影响最终的分割效果。这两个模块相辅相成,共同提升了MFuser的性能。

我理解Mamba的主要优势在于它在处理超长序列时的效率和有效性。传统的Attention机制在处理长序列时计算复杂度会显著增加,而Mamba通过其选择性状态空间模型,能够在序列长度上实现线性扩展,这意味着它处理更长的上下文信息时,计算成本不会急剧上升。这对于融合视觉和语言模型,尤其是处理高分辨率图像或长文本描述时,至关重要。而且Mamba还能更好关注重要信息,性能更强。

我觉得MFuser在自动驾驶领域非常有潜力。自动驾驶需要模型能够准确识别各种交通场景,包括车辆、行人、交通标志等等。真实世界的场景非常复杂多变,而MFuser的跨领域泛化能力,可以帮助模型更好地适应各种未知的场景,提高自动驾驶的安全性。而且自动驾驶对实时性要求很高,Mamba的线性扩展性也能够满足这一需求。

我理解MVFuser是负责“磨合”VFM和VLM,让它们更好地相互理解,协同工作。MTEnhancer则是负责“精修”文本信息,让模型更好地理解图像内容。如果少了MVFuser,VFM和VLM可能会出现“各说各话”的情况,信息无法有效融合。如果少了MTEnhancer,模型可能无法准确理解图像内容,导致分割效果不佳。所以这两个模块都很重要。

医疗影像分析也是一个很有前景的应用方向。医生需要分析各种医学影像,如CT、MRI等等,来诊断疾病。MFuser可以帮助医生更准确地识别病灶,提高诊断效率。而且医学影像的标注成本很高,MFuser的跨领域泛化能力可以减少对大量标注数据的依赖。

我比较看好MFuser在遥感图像分析领域的应用。遥感图像包含大量地表信息,如植被、水体、建筑物等等。MFuser可以帮助分析人员更准确地识别这些地物,从而进行环境监测、城市规划等工作。遥感图像的成像条件复杂多变,MFuser的跨领域泛化能力可以提高分析的准确性。

从工程角度来说,MVFuser起到了一个桥梁的作用,它连接了视觉和语言两个模态,让它们能够更好地进行信息交互。MTEnhancer则像是对文本信息进行了一次“提纯”,滤除掉噪声,突出关键信息。如果缺少其中一个模块,都会导致模型性能下降。个人认为,MVFuser可能更重要一些,因为它涉及到模态之间的融合,是整个框架的核心。

Mamba在MFuser中的应用,其实是借鉴了它在自然语言处理领域的成功经验。图像和文本的融合,本身就涉及到长序列的处理。Mamba的优势在于它能够有选择地记住和遗忘信息,这使得它更擅长处理这种复杂的模态融合任务。和Attention相比,Mamba更像是一个“记忆增强”的方案,让模型能够更好地理解和利用上下文信息。

谢邀,Mamba最吸引我的点就是它避免了Attention机制的二次方复杂度问题。简单来说,Attention需要两两计算序列中所有token之间的关系,序列一长,计算量爆炸。Mamba则另辟蹊径,用状态空间模型来模拟序列的动态变化,降低了计算复杂度,同时能更好地捕捉序列中的长期依赖关系。理论上来说,这使得MFuser在处理更复杂的跨领域语义分割任务时,能够保持高效和准确。