清华大学提出SpargeAttn,一种无需训练的稀疏Attention方法,加速语言、视频、图像等大模型推理,精度无损,提速显著。

原文标题:清华稀疏Attention,无需训练加速一切模型!

原文作者:数据派THU

冷月清谈:

怜星夜思:

2、文章提到SpargeAttn通过预测P矩阵的稀疏部分来加速计算,那么这种预测的准确性对最终的加速效果和模型精度有多大影响?如果预测不准,会造成什么后果?

3、文章中提到SpargeAttn与SageAttention融合可以进一步加速,那么这种融合是怎样实现的?除了SageAttention,是否可以和其他Attention加速方法结合?如果可以,大家觉得和哪种方法结合效果会更好?

原文内容

来源:人工智能前沿讲习本文约1700字,建议阅读6分钟本文从前言,挑战,方法,以及实验效果四个方面介绍 SpargeAttn。

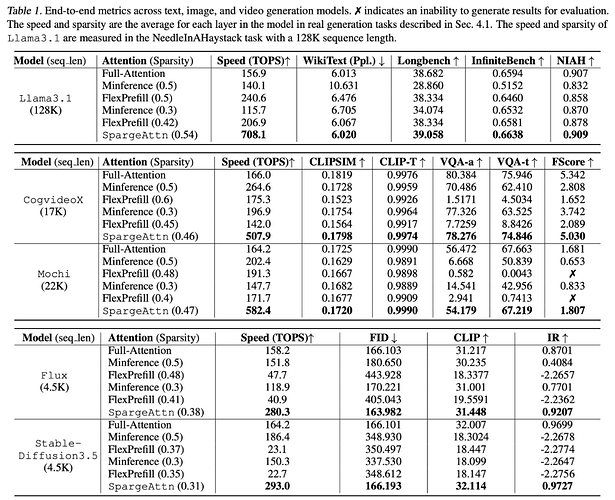

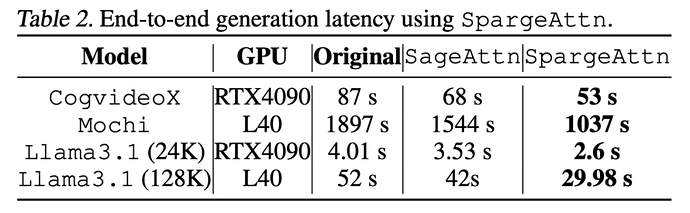

为了进一步加速 Attention,清华大学陈键飞团队进一步提出了无需训练可直接使用的稀疏 Attention(SpargeAttn)可用来加速任意模型。实现了4-7 倍相比于 FlashAttention 的推理加速,且在语言,视频、图像生成等大模型上均保持了端到端的精度表现。

-

论文标题:SpargeAttn: Accurate Sparse Attention Accelerating Any Model Inference

-

论文链接:https://arxiv.org/abs/2502.18137

-

开源代码:https://github.com/thu-ml/SpargeAttn

-

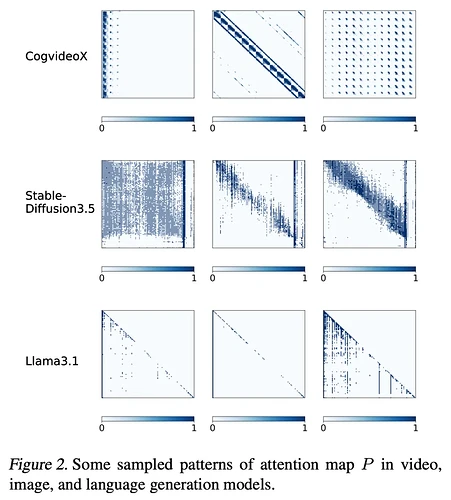

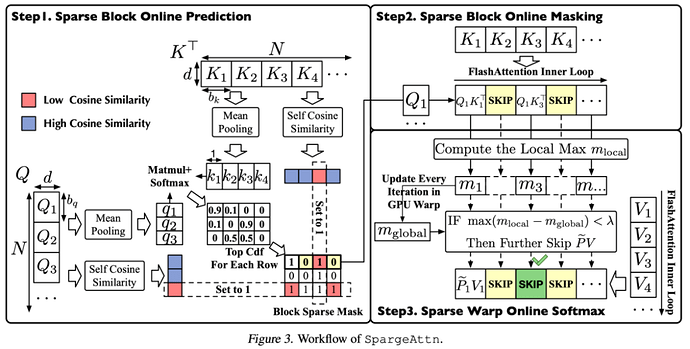

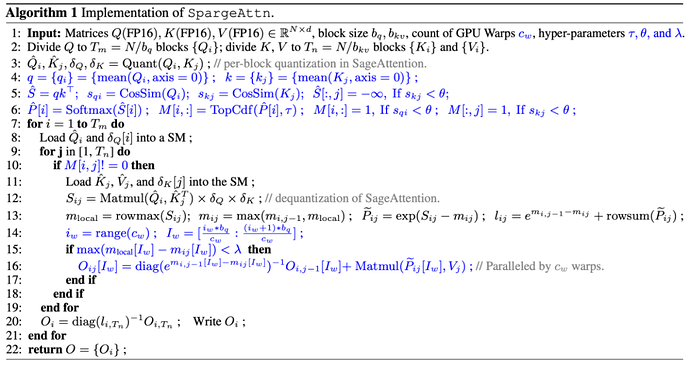

研究团队提出了一种各模型通用的快速的对 P 矩阵稀疏部分进行预测的算法。该方法选择性地对 Q, K 矩阵进行压缩并预测 P 矩阵,接着使用 TopCdf 操作省略 P 中稀疏部分对应的 QK^T 与 PV 的矩阵乘法。

-

研究团队提出了在 GPU Warp 级别上的稀疏 Online Softmax算法,该算法通过利用 Online Softmax 中全局最大值与局部最大值之间的差异,进一步省略了一些 PV 的矩阵乘法计算。

-

可选的,针对视频和图像模型,研究团队充分利用图像以及视频中的 Token 局部相似性质,使用希尔伯特重排的方法对 Attention 前的 Token 进行重新排列,进一步提高稀疏度。

-

最后,研究团队将这种稀疏方法与基于量化的 SageAttention 融合到一起,进一步加速 Attention。

编辑:黄继彦