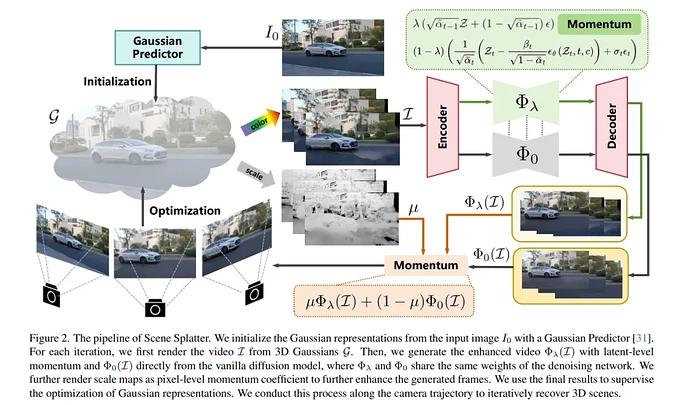

这个全局高斯表示听起来很高大上!感觉就像是给AI建立了一个全局地图,然后不断地用新的视频帧去更新这个地图。这样即使视频很长,AI也知道自己在哪里,应该生成什么样的画面。厉害厉害!

这个问题问得好!我理解的“动量”在这里指的是从原始特征中构造的噪声样本,可以理解为一种对视频生成过程的“推动力”。它通过影响扩散模型,促使其在生成新视角时,更多地保留原始图像的特征信息,从而增强视频细节并保持场景的一致性。这就像给模型一个“记忆”,让它在生成过程中不至于偏离太远。

个人理解,全局高斯表示提供了一个对三维场景的全局描述,通过微调可以不断优化这个描述,使其更准确。结合增强后的帧进行渲染,相当于不断地从新视角观察并修正三维场景的表示,最后再用于动量更新,感觉是一个自反馈的迭代过程。这样,每一帧都建立在对场景更精确的理解上,使其可以逐步恢复三维场景,不再依赖于有限的视频长度。

Scene Splatter感觉在游戏开发和虚拟现实领域很有潜力啊!可以用单张图片快速生成一个可交互的三维场景,大大降低了开发成本。未来的发展方向我觉得可以是在真实感和细节上更进一步,比如加入光照、材质等更真实的物理属性。

我觉得这个技术简直是短视频创作神器啊!以后只需要一张照片,就能自动生成各种炫酷的3D动画效果,想想都觉得有趣。未来可以结合AI绘画等技术,实现更个性化和创意化的视频生成。期待!

这个“动量”的概念确实挺有意思的!感觉就像是给AI加了个“惯性”,避免它天马行空地乱生成东西,保证生成的视频前后连贯。不过,这个“动量”具体是怎么计算和应用的,还是有点晕乎乎的,得好好研究下。

我认为Scene Splatter在机器人视觉领域也有应用前景。如果机器人能够根据单张图像快速生成周围环境的三维模型,就可以更好地进行导航和物体识别。未来可以结合SLAM等技术,实现更鲁棒和精确的三维场景重建。

从技术角度来看,全局高斯表示提供了一种紧凑且可微的三维场景表达方式。通过微调可以有效地将新视角的信息融入到全局表示中,从而避免了传统方法中因视频长度限制而导致的信息丢失。这种方法本质上是将视频生成问题转化为一个持续优化的过程,从而实现了对任意长度视频的生成。有点类似SLAM里后端优化的味道。

从技术角度来说,这里的“动量”类似于物理学中的动量概念,它携带了之前帧的信息,并将其传递到后续帧的生成过程中。通过将噪声样本作为动量注入扩散模型,可以有效地缓解视频生成过程中常见的“信息丢失”问题,从而提高生成视频的质量和一致性。当然,具体实现细节肯定更复杂,需要深入研究论文才能完全理解。