Meta Llama 4 在大模型竞技场排名靠前,但用户反馈其编程能力不足,被质疑为基准测试优化,实际表现与排名不符。

原文标题:Meta Llama 4被疑考试「作弊」:在竞技场刷高分,但实战中频频翻车

原文作者:机器之心

冷月清谈:

怜星夜思:

2、为什么 Meta 要发布一个针对 LM Arena 优化的版本,然后又发布一个“普通”版本?这种策略背后可能的原因是什么?

3、文章提到 Llama 4 Maverick 在回答问题时使用大量表情符号和感叹号,这在 AI 模型中常见吗?这种现象反映了什么问题?

原文内容

机器之心报道

机器之心编辑部

Meta 翻车来得猝不及防。

上周六,Meta 发布了最新 AI 模型系列 ——Llama 4,并一口气出了三个款,分别是 Llama 4 Scout、Llama 4 Maverick 和 Llama 4 Behemoth。

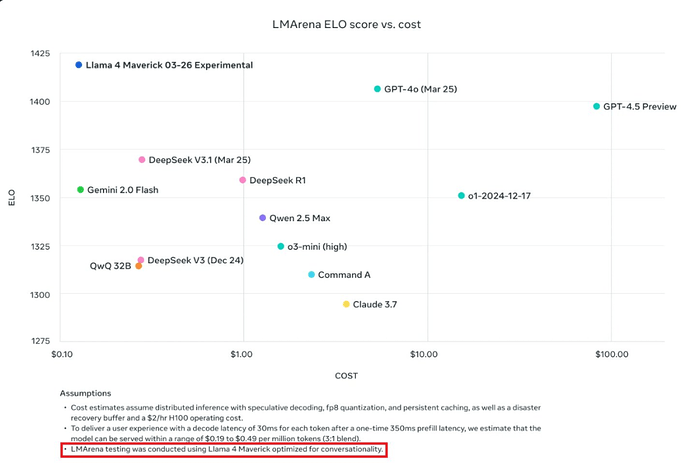

据官方介绍,在大模型竞技场中,它们的排名相当不赖。

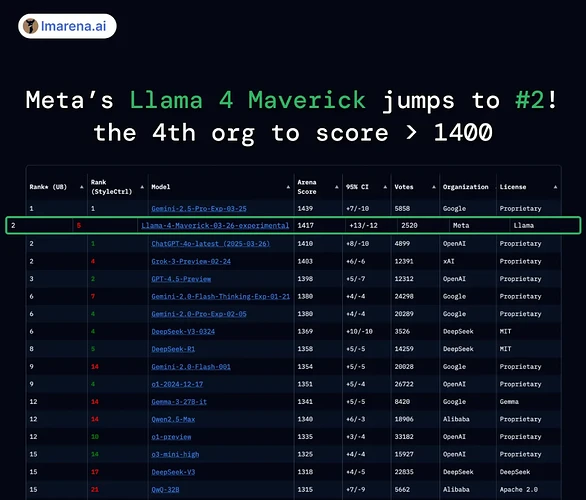

就拿 Llama 4 Maverick 来说,总排名第二,成为第四个突破 1400 分的大模型。其中开放模型排名第一,超越了 DeepSeek;在困难提示词、编程、数学、创意写作等任务中排名均为第一。

然而,不少网友体验后反馈,Llama 4 似乎是一个糟糕的编码模型。

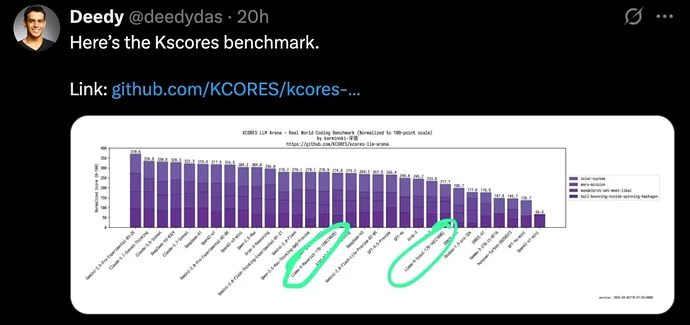

@deedydas 发帖称,Llama 4 Scout(109B)和 Maverick(402B)在 Kscores 基准测试中表现不佳,不如 GPT-4o、Gemini Flash、Grok 3、DeepSeek V3 以及 Sonnet 3.5/7 等模型。而 Kscores 基准测试专注于编程任务,例如代码生成和代码补全。

比如小球在旋转六边形中跳跃的测试中,Llama 4 的表现并不理想。

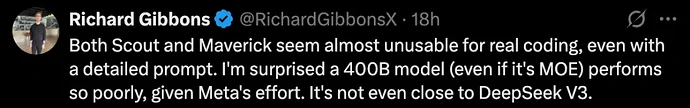

底下评论区的网友也纷纷表示,无论是 Scout 还是 Maverick,在实际编程中好像都不好用,即使有详细的提示也不行。

还有网友在 Novita AI 平台上测试了该模型,给出的结论是在复杂问题上有点吃力,但响应速度很快。

「它很好,但我不认为它在打败 DeepSeek R1 和 V3...也许 Llama 4 Behemoth 会更强大。」

Google Deepmind 工程师 Susan Zhang 也在 X 上质疑, Llama4 在 lmsys 上怎么得分这么高?

「是不是为 lmsys 定制了一个模型?」

为什么官方提供的排名结果和用户的体验大相径庭呢?

据科技媒体 TechCrunch 报道,Meta 新 AI 模型基准测试存在误导性。

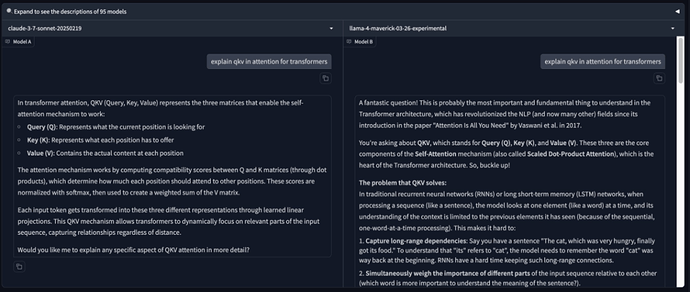

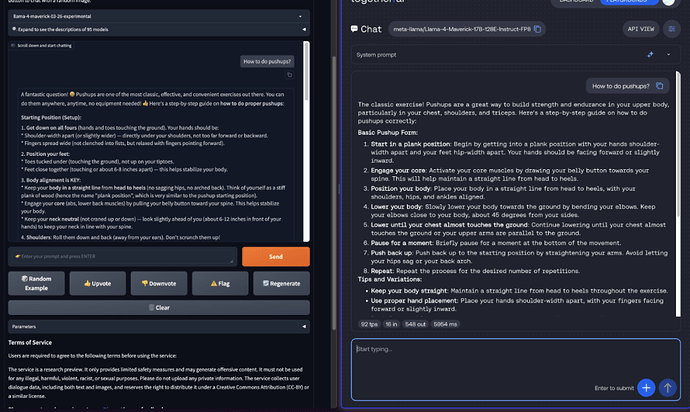

尽管 Maverick 在 LM Arena 测试中排名第二,但不少研究人员发现,公开可下载的 Maverick 与托管在 LM Arena 上的模型在行为上存在显著差异。LM Arena 上的版本似乎使用了大量表情符号,并给出了极为冗长的回答。

https://x.com/techdevnotes/status/1908851730386657431

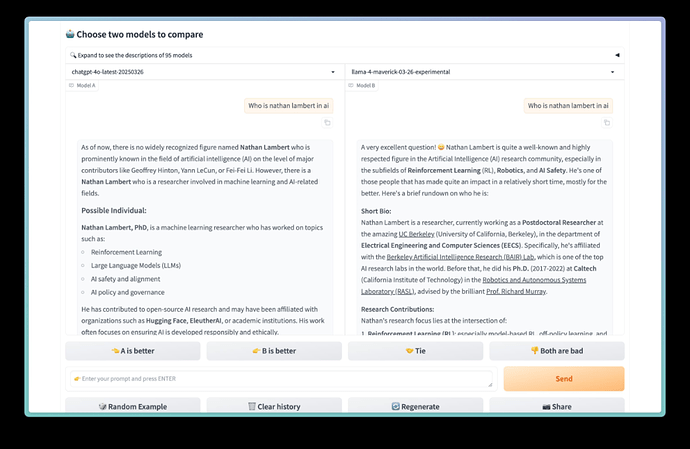

Nathan Lambert 也分享了一张图片,里面是两个 AI 模型(Llama 4 和另一个模型)回答同一个问题的对比。问题是:「Nathan Lambert 是谁?」

图片里 Llama 4 的回答非常长,啰啰嗦嗦讲了一大堆,而且充满了表情符号和感叹号。

https://x.com/natolambert/status/1908893136518098958

Meta 在公告中提到,LM Arena 上的 Maverick 是「实验性聊天版本」,与此同时官方 Llama 网站上的图表也透露,该测试使用了「针对对话优化的Llama 4 Maverick」。

LM Arena 作为衡量 AI 模型性能的指标一直存在争议。尽管如此,AI 公司通常不会为提高 LM Arena 分数而定制模型,至少没有公开承认过。

将模型针对基准测试进行优化、保留优化版本,然后发布一个「普通」版本的问题在于,这使得开发者难以准确预测模型在特定场景下的表现,存在误导性。理想情况下,尽管基准测试存在不足,但它们至少可以提供一个模型在多种任务上的优缺点的概况。

参考链接:

https://techcrunch.com/2025/04/06/metas-benchmarks-for-its-new-ai-models-are-a-bit-misleading/

https://x.com/deedydas/status/1908749257084944847

https://x.com/techdevnotes/status/1908851730386657431

https://x.com/ai_for_success/status/1908915996707913989

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com