斯坦福博士论文揭示神经网络训练的凸优化公式,为理解和优化神经网络提供了新视角,并在大语言模型微调等领域展现应用潜力。

原文标题:【斯坦福大学博士论文】神经网络的凸优化公式化:理论、应用与未来展望

原文作者:数据派THU

冷月清谈:

怜星夜思:

2、论文中提到了“NP难证明”,这意味着训练神经网络到全局最优在一般情况下是不可行的吗?那么,我们现在训练神经网络的方法,比如梯度下降法,是在做什么样的妥协?

3、论文中提到“通过随机几何代数对大语言模型(LLMs)进行微调”,这种方法与传统的微调方法相比,有哪些优势和劣势?它是否能够有效地降低LLM微调的计算成本?

原文内容

来源:专知本文约1000字,建议阅读5分钟

本论文从凸优化的视角出发,推进了对神经网络的理论理解和实际优化。

深度神经网络,尤其是大语言模型(LLMs),在广泛的任务中展现了显著的成功;然而,其训练过程计算密集,需要大量的数据和计算资源。即使是对预训练的LLMs进行特定任务的微调,也常常带来显著的计算成本。本论文从凸优化的视角出发,推进了对神经网络的理论理解和实际优化。

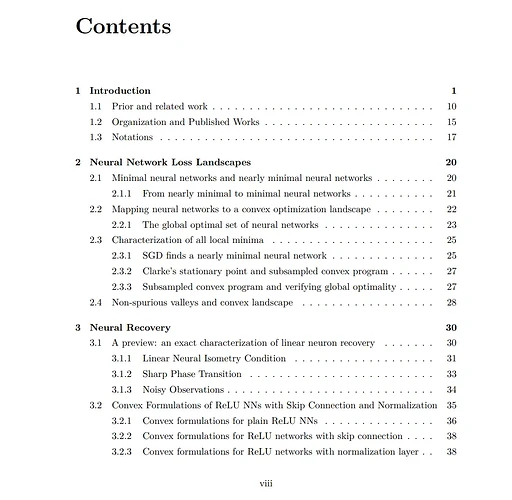

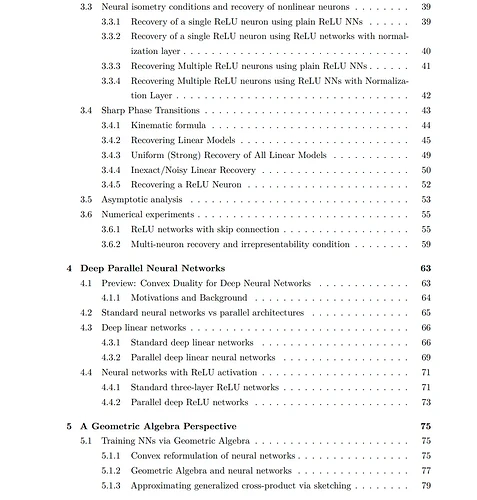

我们首先提出了一个基础性结果:两层ReLU网络的正则化训练问题可以重新表述为凸优化问题。这种凸优化公式化阐明了优化景观,刻画了所有全局最优解和Clarke稳定点,并将模型性能与超参数选择解耦。借鉴压缩感知中最稀疏线性模型的恢复,我们证明了过参数化神经网络本质上学习能够有效解释数据的简单模型,并通过在随机生成数据集中观察到的相变现象支持了这一结论,从而确立了其卓越的泛化能力。将强对偶性概念扩展到深层网络,我们提出了一种并行架构,能够在修改正则化的情况下实现全局最优训练,同时也为标准架构中非零对偶间隙的存在提供了见解。

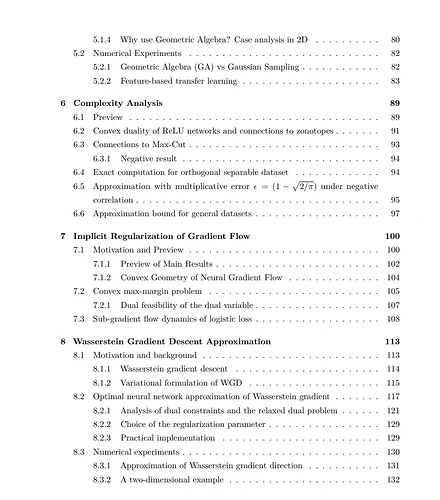

通过将正则化ReLU网络的训练与NP难问题Max-Cut联系起来,我们严格分析了训练到全局最优的计算复杂度,得出了NP难证明,并为特定类型的数据集开发了高效的多项式时间近似算法。即使在缺乏显式正则化的情况下,梯度流的隐式正则化也会驱动收敛到非凸最大间隔问题的全局最优解。

我们通过利用随机几何代数对大语言模型(LLMs)进行微调,展示了凸优化的实际应用。我们进一步通过凸几何和对偶视角分析了用于训练两层ReLU网络的非凸次梯度流,表明其隐式偏差与凸正则化一致,并在对偶变量满足特定条件时证明了其收敛到全局最优解。最后,我们提出了一种半定规划(SDP)松弛方法,用于近似具有平方ReLU激活的两层网络中的Wasserstein梯度,确保在特定条件下的紧密松弛,并展示了其在贝叶斯推断和COVID-19参数估计中的有效性。

这些发现填补了关键的理论空白,并引入了具有深远意义的创新方法,推动了我们对神经网络训练过程的理解。