CVPR2025提出PreSel预指令数据选择,通过预先选择图像再生成指令,显著降低视觉指令调优的成本,仅需15%的数据量即可达到全量训练效果。

原文标题:【CVPR2025】先过滤图像,后生成指令:视觉指令调优的预指令数据选择

原文作者:数据派THU

冷月清谈:

怜星夜思:

2、文章提到PreSel在LLaVA-1.5和Vision-Flan数据集上实现了与全量VIT相当的性能,那么这个方法在其他数据集上是否也能表现良好?有没有可能存在PreSel不适用的场景?

3、PreSel的核心似乎在于挑选“最具代表性”的图像,那么“代表性”是如何定义的?仅仅依靠图像特征聚类就足够了吗?是否需要考虑其他因素,例如文本描述的多样性?

原文内容

来源:专知本文约1000字,建议阅读5分钟

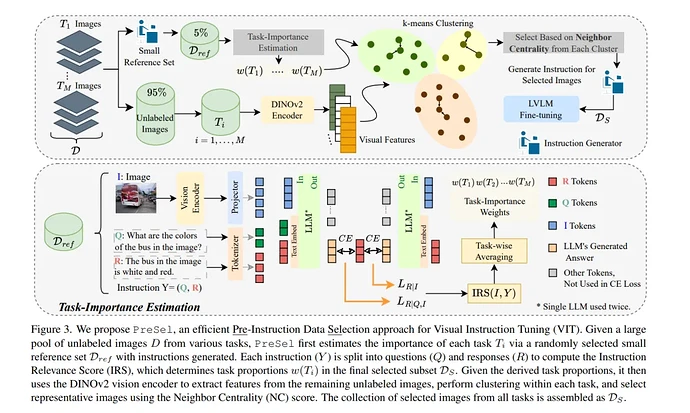

我们提出了预指令数据选择(Pre-Instruction Data Selection, PreSel),这是一种更实用的数据选择范式,直接选择最有益的无标注图像,并仅为选定的图像生成指令。

视觉指令调优(Visual Instruction Tuning, VIT) 对于大规模视觉-语言模型(Large Vision-Language Models, LVLMs)的训练需要依赖大量的图像-指令对数据集,这可能会带来高昂的成本。最近的研究尝试通过选择高质量图像-指令对的子集来减少VIT的运行时间,同时保持与全量训练相当的性能。然而,一个常被忽视的主要挑战是,从未标注图像生成指令用于VIT的成本非常高。大多数现有的VIT数据集严重依赖人工标注或付费服务(如GPT API),这限制了资源有限的用户为定制应用创建VIT数据集的能力。

为了解决这一问题,我们提出了预指令数据选择(Pre-Instruction Data Selection, PreSel),这是一种更实用的数据选择范式,直接选择最有益的无标注图像,并仅为选定的图像生成指令。PreSel首先估计VIT数据集中每个视觉任务的相对重要性,以确定任务级别的采样预算。然后,它在每个任务中对图像特征进行聚类,并根据预算选择最具代表性的图像。这种方法减少了VIT数据形成过程中指令生成和LVLM微调的计算开销。通过仅为15%的图像生成指令,PreSel在LLaVA-1.5和Vision-Flan数据集上实现了与全量VIT相当的性能。