同意楼上!参数量和性能之间并非简单的线性关系。想象一下,一个臃肿的胖子和一个精壮的运动员,虽然胖子体重更大(参数量更大),但论灵活性和爆发力肯定不如运动员。模型也是如此,参数量过大可能导致过拟合、训练困难等问题。有效的模型架构和训练策略才能充分利用参数量,实现更好的性能。所以,以后面试再有人问你是不是模型越大越好,直接把这个例子甩给他!

除了技术上的挑战,我认为数据也是一个很大的问题。训练一个能够进行复杂视觉推理的模型,需要大量的、高质量的、标注详尽的数据。而这种数据的获取成本非常高昂。可能的解决方案包括:利用自监督学习和无监督学习技术来降低对标注数据的依赖、采用数据增强技术来扩充训练数据集、以及利用合成数据来模拟各种场景。让AI能够从更少的数据中学到更多的知识!

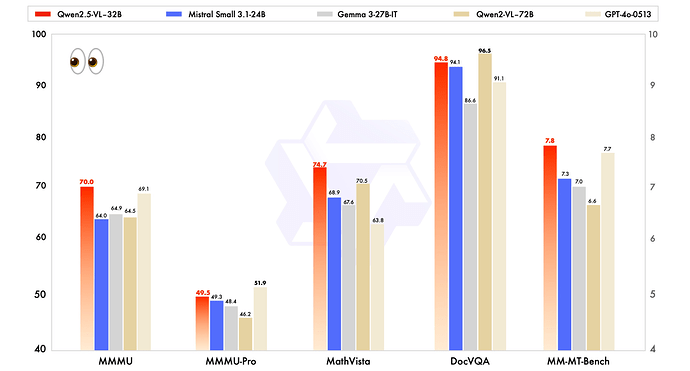

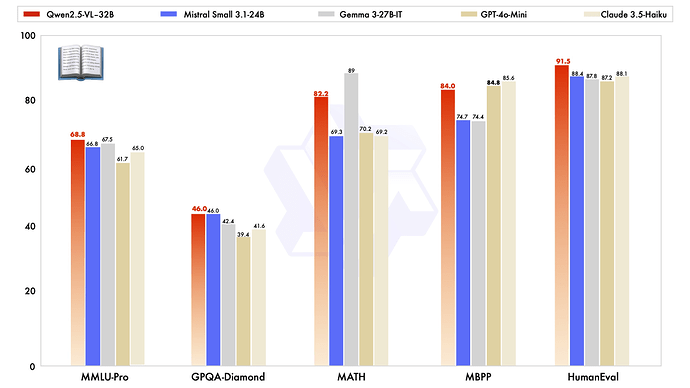

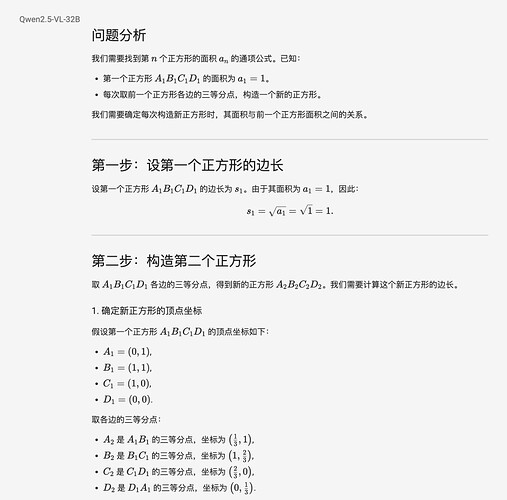

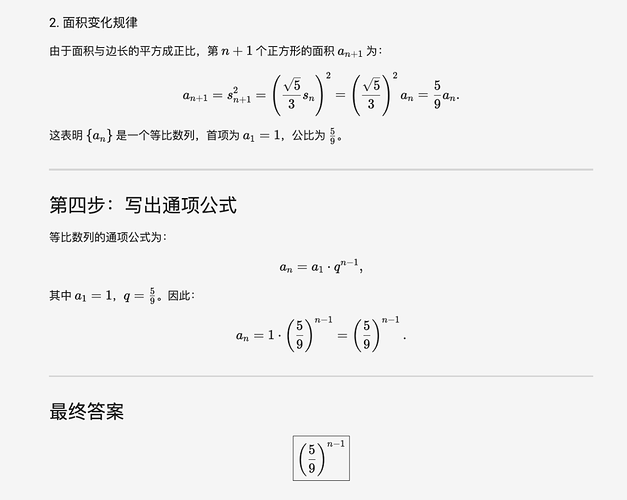

从理论上讲,更大的参数量可以提供更大的模型容量,从而有潜力学习更复杂的模式。但实际效果还取决于优化算法、数据质量和正则化等因素。Qwen2.5-VL-32B的成功可能归功于其更高效的模型结构或者更优化的训练方式,使得它在较小的参数量下也能达到更好的性能。这提醒我们,不能唯参数量论,而要综合考虑各种因素。就好比同样多的零件,有些人能组装成航母,有些人只能拼成自行车。

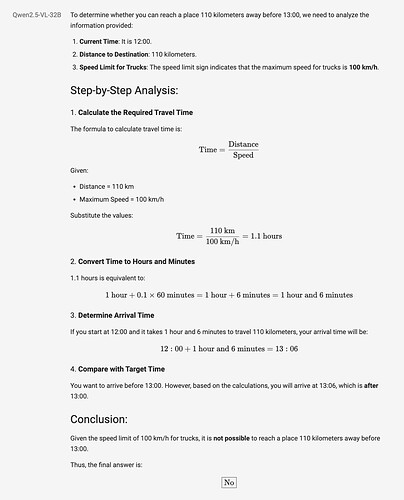

我觉得除了记忆问题,另一个挑战是如何保证推理过程的可靠性和可解释性。模型在执行多步骤推理时,每一步都可能出错,导致最终结果偏差很大。而且,我们很难知道模型到底是怎么得出结论的,这在一些高风险领域(例如医疗、金融)是不可接受的。可能的解决方案包括:引入注意力机制来追踪模型的推理过程、采用符号推理和神经推理相结合的方法、以及设计可解释的损失函数来约束模型的行为。让AI的思考过程变得透明可控!

我更倾向于从更底层的角度来看待这个问题。数学推理本质上是一种符号推理能力,而这种能力是实现通用人工智能(AGI)的关键。Qwen2.5-VL-32B在这方面的进步,意味着我们朝着AGI又迈进了一步。未来,AI可以像人类一样进行抽象思考、逻辑判断和知识推理,从而更好地理解世界和解决问题。这是一个激动人心的未来!

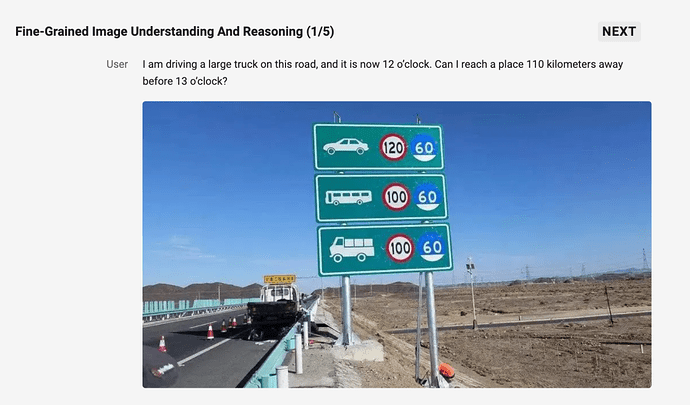

数学推理能力提升的意义太大了!不仅仅是解题,更是逻辑思维能力的体现。在实际应用中,可以用于金融分析(预测趋势、风险评估)、科学研究(数据建模、实验分析)、智能决策(优化策略、资源分配)等等。说白了,就是让AI更聪明,能更好地理解和解决复杂问题。想象一下,一个可以帮你分析财务报表、预测市场走势的AI,是不是很酷?

问题问的好!参数量并非决定模型性能的唯一因素。Qwen2.5-VL-32B超越72B表明,模型架构设计、训练数据质量、训练方法等对性能至关重要。参数量大只是提升性能的潜在因素之一,更需要合理的模型设计和训练策略。简单来说,并非越大越好,而是越适合越好。如同盖房子,地基不稳,钢筋水泥再多也是空中楼阁。

最大的挑战应该是如何让模型记住并理解长序列的信息。就像人一样,看一篇文章太长了,前面讲了啥后面就忘了。模型也面临着“记忆衰退”的问题。可能的解决方案包括:引入更先进的记忆机制(例如Memory Network、Transformer-XL)、采用层次化的推理结构(将复杂任务分解为多个子任务)、以及利用外部知识库来辅助推理。总而言之,让AI拥有更强的记忆力和思考能力!

除了楼上说的那些高大上的应用,我觉得数学推理能力在日常生活中也有用武之地。比如,可以用来优化购物策略,计算最佳折扣方案;或者用来规划旅行路线,选择最省时的交通方式。甚至可以用来玩德州扑克,计算胜率和赔率(虽然不提倡赌博)。总之,只要涉及到逻辑推理和量化分析,数学推理能力就能派上用场。以后要是AI能帮我算彩票中奖号码就好了!