CMU博士论文探讨了外部知识增强的语言模型在代码生成与智能体开发中的应用,重点关注利用大规模数据源和外部知识进行模型预训练和检索增强。

原文标题:【CMU博士论文】外部知识增强的语言模型:用于代码生成与智能体开发

原文作者:数据派THU

冷月清谈:

怜星夜思:

2、论文中提到了代码生成的人类研究,你认为在人机协作的代码生成过程中,人类应该扮演什么样的角色?应该如何设计工具才能更好地促进人机协作?

3、论文提到了将LLM作为智能体的交互式使用,你认为未来LLM智能体在日常生活和工作场所中可能发挥哪些作用?又会带来哪些潜在的挑战?

原文内容

来源:专知本文约1000字,建议阅读5分钟

在本论文中,我们提出将自然语言与编程语言以及日常生活在线环境中的可执行操作相连接。

我们每天都与计算机互动。尽管如今操作计算机的用户体验已经变得前所未有的简单,但仍存在一些障碍,阻碍用户充分发挥其潜力。其中一个例子是编程语言的学习曲线。程序员一直梦想着有更简单、更智能的工具来辅助他们的工作,从而使开发变得更加轻松。不懂编程的终端用户也将受益于一种更自然的方式来指导计算机完成某些定制任务,即将计算机转变为他们的个人智能体,以高度的自主性和指令执行能力完成各种任务。这与我们如何轻松地用自然语言(如英语)表达目标和愿望形成了鲜明对比。

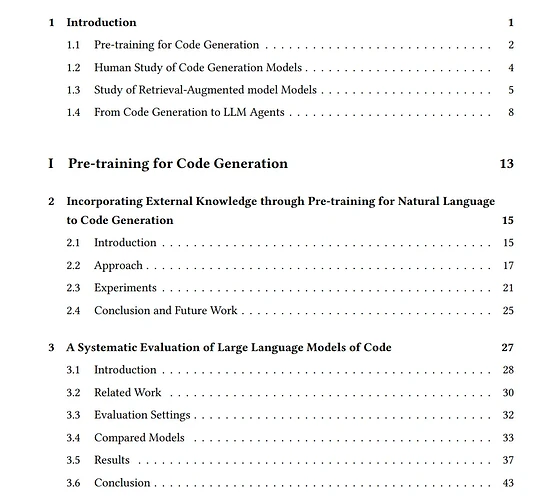

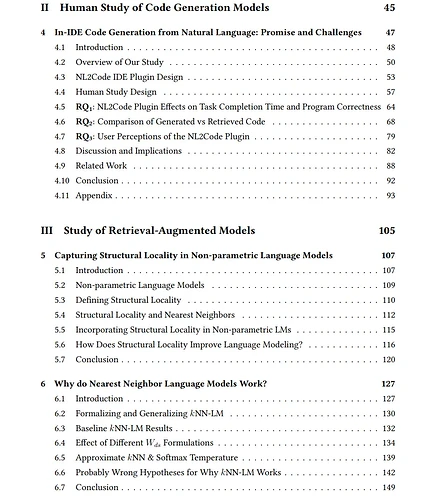

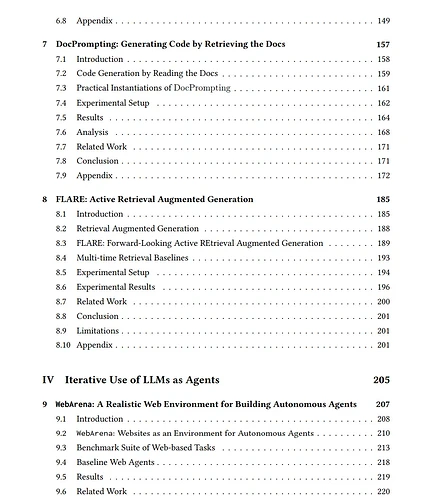

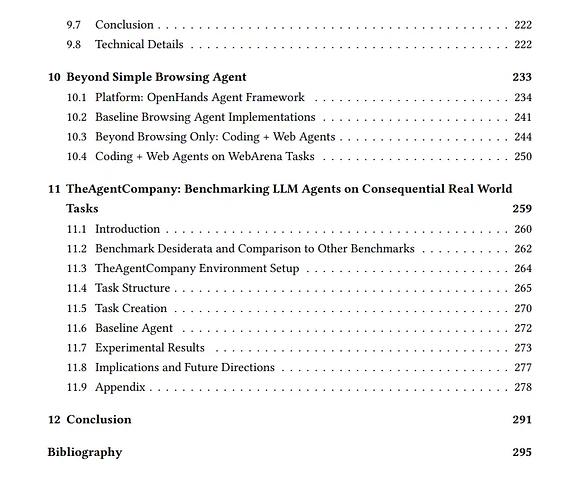

在本论文中,我们提出将自然语言与编程语言以及日常生活在线环境中的可执行操作相连接。这项工作的预期目标是构建模型、环境和评估方法,既用于编程任务中的代码生成,也用于日常生活和工作场所中的大型语言模型(LLM)智能体,特别关注利用大规模数据源和外部知识进行模型预训练和检索增强模型。我们从四个角度探讨这一问题,构成了论文的四个部分。在第一部分中,我们探索代码生成模型的预训练。接下来,在第二部分中,我们进行代码生成的人类研究。然后,在第三部分中,我们改进检索增强模型。最后,在第四部分中,我们探索将 LLM 作为智能体的交互式使用。