TimeDistill提出了一种跨架构知识蒸馏框架,旨在提升轻量级时序预测模型的效率和精度。通过将复杂模型的知识迁移到MLP,实现高效且准确的预测。

原文标题:跨架构知识蒸馏:TimeDistill新范式助力高效时序预测

原文作者:数据派THU

冷月清谈:

怜星夜思:

2、文章中提到TimeDistill适用于多种教师和学生模型。那么,是否存在某些特定类型的教师模型或学生模型,TimeDistill的效果会特别显著或不佳?背后的原因是什么?

3、TimeDistill在时序预测领域取得了不错的成果。你认为这种跨架构知识蒸馏的思想,是否可以应用到其他领域,例如自然语言处理或计算机视觉?如果可以,可能面临哪些挑战?

原文内容

来源:时序人本文约2000字,建议阅读6分钟本文介绍了TimeDistill新范式助力高效时序预测。

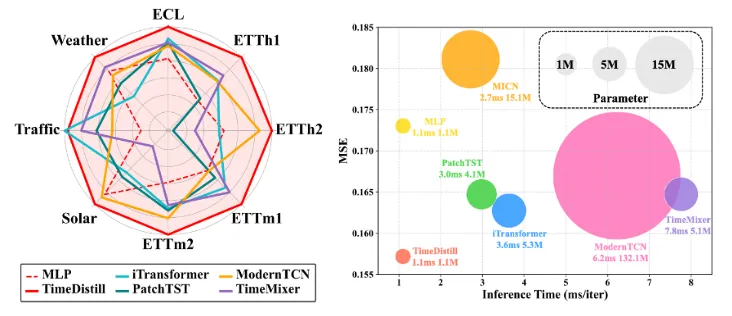

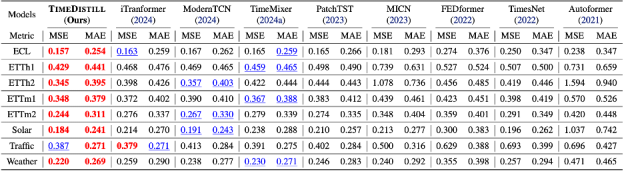

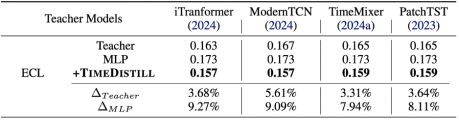

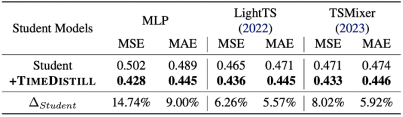

如何在保证预测精度的同时降低计算成本,是时序预测应用面临的核心挑战。近期,来自美国埃默里大学、澳大利亚格里菲斯大学等多地的华人科研团队联合提出了 TimeDistill,一种跨架构知识蒸馏(Cross-Architecture Knowledge Distillation) 框架。

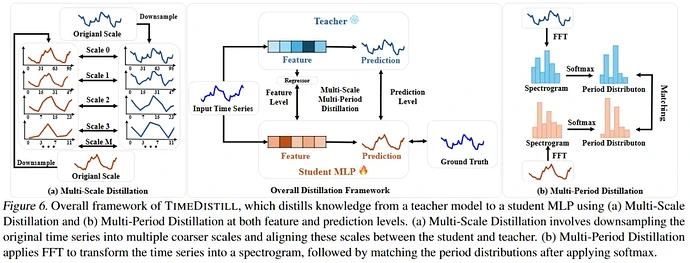

该方法通过蒸馏复杂模型的优势至轻量级模型,实现计算负担大幅降低的同时显著提升预测精度,为构建高效、高精度的时序预测模型提供了全新思路。

-

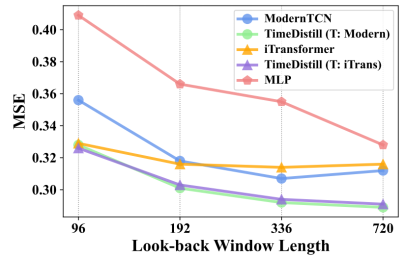

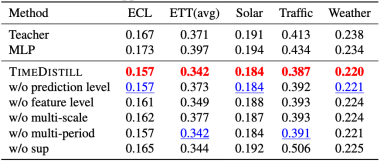

时间域的多尺度模式(Multi-Scale Pattern):真实世界的时序数据通常在多个时间尺度上呈现不同的变化。作者观察到,在最细粒度时间尺度上表现良好的模型通常在较粗粒度上也能保持较高的准确性,而 MLP 在大多数尺度上均表现不佳。

-

频率域的多周期模式(Multi-Period Pattern):时序数据往往存在多个周期性。作者发现,性能较好的模型能够捕捉到与真实数据接近的周期性特征,而 MLP 无法有效识别这些周期性结构。

编辑:王菁