AI算力瓶颈如何破?3月24日晚,专家直播探讨数据存储与分析的协同创新,提升大模型训练效率!

原文标题:破局 AI 算力瓶颈,探讨数据存储与分析的协同创新 | 直播预告

原文作者:AI前线

冷月清谈:

怜星夜思:

2、直播中提到数据预处理的重要性,你有什么数据预处理的经验或技巧可以分享?或者你认为有哪些创新的数据预处理方法值得探索?

3、如果让你设计一个针对AI大模型训练的分布式存储系统,你会考虑哪些关键因素?你认为什么样的存储架构更适合AI大模型的需求?

原文内容

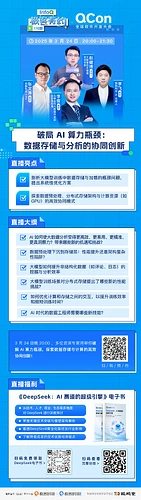

AI 大模型的崛起带来了前所未有的算力需求,但数据存储与加载的瓶颈问题却成为制约发展的关键。如何优化数据预处理?如何实现分布式存储与计算资源的高效协同?如何提升大模型训练的效率?3 月 24 日晚 20:00 ,4 位资深专家将在直播上深入剖析这些痛点!

3 月 24 日 20:00-21:30

破局 AI 算力瓶颈:数据存储与分析的协同创新

主持人:赵健博,大数据技术领域资深专家

嘉宾:

-

李俊,北银金科大数据开发部总经理助理

-

张文涛, 焱融科技 CTO

-

李飞,数势科技 AI 负责人

-

直击痛点:剖析大模型训练中数据存储与加载的瓶颈问题,提出系统性优化方案

-

技术融合:探索数据预处理、分布式存储架构与计算资源(如 GPU)的高效协同模式

扫描下图海报【二维码】,或戳直播预约按钮,预约 InfoQ 视频号直播。👇

文末留言写下问题,讲师会在直播中为你解答。