CMU博士论文提出在模型不准确的情况下,通过学习模型局限性,结合多种知识形式,实现可靠的机器人规划。

原文标题:【CMU博士论文】在模型不准确的情况下实现可靠的基于模型的规划

原文作者:数据派THU

冷月清谈:

怜星夜思:

2、文章中提到了多种知识形式的融合,例如物理模型、学习的动力学模型以及无模型技能。在实际应用中,如何有效地整合这些不同来源的知识,避免知识之间的冲突或冗余?

3、论文提到主动学习模型前提条件可以提高任务可靠性。那么,在机器人进行主动学习时,如何平衡探索(探索未知区域)和利用(利用已知模型)之间的关系,避免机器人因探索而进入危险状态或损坏自身?

原文内容

来源:专知本文约1000字,建议阅读5分钟

我们主要通过基于模型的规划视角来解决利用知识进行决策的问题,即机器人使用预测模型来选择能够实现预期结果的动作。

本论文的目标是提供一个框架,用于结合多种互补工具,使机器人能够利用不同形式的知识来操控物体。我们考虑了多种类型的知识,例如基于物理的模型、学习到的动力学模型,以及从人类示范中学习的无模型技能。每种知识形式都带有其对世界的假设以及所需的资源。我们主要通过基于模型的规划视角来解决利用知识进行决策的问题,即机器人使用预测模型来选择能够实现预期结果的动作。

尽管预测模型被广泛用于任务和运动规划,但在许多情况下,其预测结果可能与现实世界的行为存在偏差,从而导致任务失败甚至损坏。尽管所有模型都存在局限性,但本论文认为,如果能够正确考虑模型的局限性,即使模型非常不准确,它们仍然是有用的。我们考虑了多种形式的模型不准确性,包括模型在表示能力上的结构性限制。

在此框架内,我们试图通过学习模型与现实之间的差异来扩展机器人的能力。具体来说,我们学习并使用状态-动作空间中的区域,称为模型前提条件,在这些区域中,模型能够可靠地表示现实世界的动力学。量化模型前提条件可以在获取新任务知识时高效地扩展能力。由于通过新数据(例如人类示范或在现实世界中尝试可能不安全的动作)获取知识的成本可能很高,因此效率至关重要。

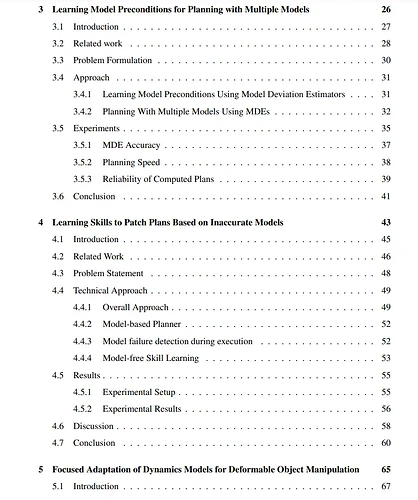

通过使用预测准确性定义模型前提条件,我们表明,即使使用极少的数据,任务可靠性也可以显著提高。通过学习模型偏差估计器(MDE),我们可以将规划限制在模型准确的区域内,从而提高规划的可靠性。尽管模型前提条件的MDE公式可以从现有数据中学习,但我们提出了一种主动学习模型前提条件的方法(第2章)。

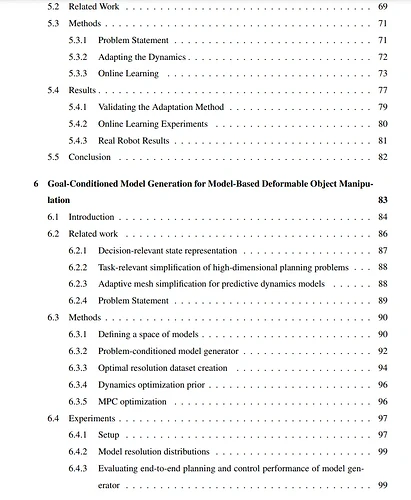

随后,论文介绍了利用模型前提条件扩展机器人能力的算法。其中一种方法支持使用多种形式不同且计算需求各异的模型进行规划,从而实现更高效的规划和可靠的执行,同时保留最优性的理论保证(第3章)。我们还解决了现有模型不足以解决问题的情况。首先,我们展示了一种将无模型技能整合到基于模型规划中的方法,且数据需求较低(第4章)。其次,我们提出了一种动力学适应算法,能够高效选择并更新学习到的动力学模型的数据,从而将能力扩展到更复杂的动力学场景(第5章)。

对量化和扩展机器人能力的探索引发了一个根本性问题:对于特定任务,可靠的规划和控制真正需要什么样的模型?针对这一问题,我们提出了一种算法,能够在给定规划问题的情况下生成高效且可靠的动力学模型(第6章)。本论文的目标是为结合多种形式的知识进行决策提供基础,指导设计能够利用不同工具解决任务的机器人系统。