偶然发现了一个很有趣的 AI 基准测试,点开链接,竟然是一个 MineCraft 作品投票页面?

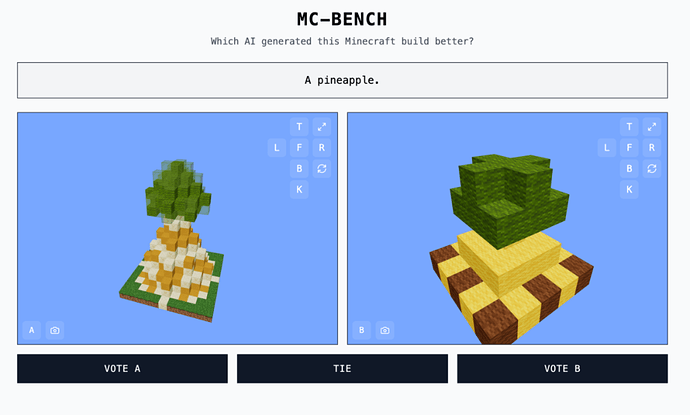

如图所示,这些作品都是 AI 完成的,灰色框中的文字对应的是提示词。黑框是可点击的选项 ——A、B 或者持平。

网站地址:https://mcbench.ai/

来都来了,先投个票吧。投票之前,作品都是「匿名」的。只有在投票后,我们才能看到每个 Minecraft 作品是由哪个模型完成的。

在这个基准里,主要看三个维度:指令遵循、代码完成度和创造力。

AI 技术飞速演进的时代,传统的人工智能基准测试显然不够用了。总有人能想出一些新颖的测试方法,比如的沙盒建造游戏 Minecraft。

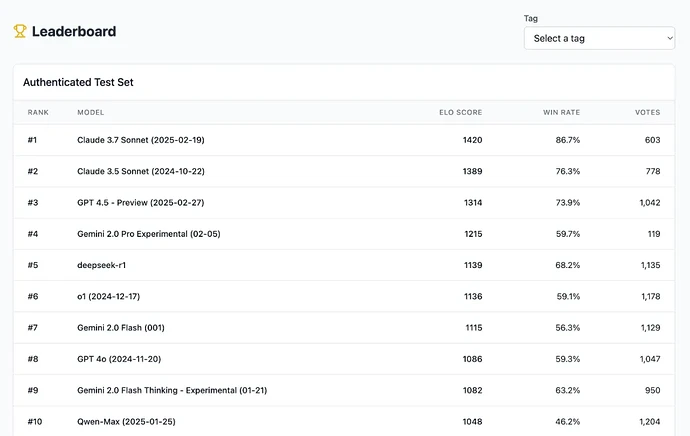

这就是我们刚刚看到的 Minecraft Benchmark(MC-Bench)。作为用户,我们能够参与的部分就是:投票。累计票数中的 ELO 分数决定了每个模型的排名。

有趣的是,无论采用哪种指标,排行榜的收敛程度都很高:Claude 3.7 & 3.5 和 GPT-4.5 都是断层领先。

从技术上讲,MC-Bench 是一个编程基准,因为模型需要编写代码来创建所提示的构建,如「冰霜雪人」(Frosty the Snowman)或「原始沙滩上迷人的热带海滨小屋」(a charming tropical beach hut on a pristine sandy shore)。

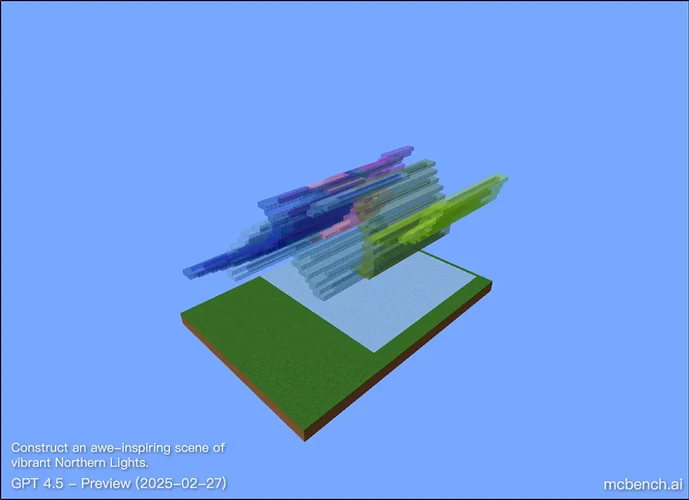

Prompt:"build a detailed steampunk-style airship flying among the clouds"(一艘在云层中飞行的详细蒸汽朋克风格飞艇)

创办 MC-Bench 的 Adi Singh 是个高中生,在他看来,用 Minecraft 做测试基准的价值并不在于游戏本身,而在于「人们对它的熟悉程度」,毕竟它是有史以来最畅销的视频游戏。

对于大多数 MC-Bench 用户来说,评价雪人是否更好看要比研究代码更容易,这使得该项目具有更广泛的吸引力,从而有可能收集更多数据,以了解哪些模型的得分始终更高。

退一万步说,即使是没有玩过这款游戏的人,也可以评估出哪个菠萝的块状表现形式更好,请参考下面这个例子:

「目前,我们只是在进行简单的构建,以思考我们自 GPT-3 时代以来已经走了多远,但(我们)可以看到自己正在扩展到这些较长形式的计划和目标导向型任务。游戏可能只是一种测试智能体推理的媒介,它比现实生活中更安全,测试目的也更可控,因此在我看来更理想。」

研究人员经常在标准化评估中对人工智能模型进行测试,其中很多测试都会给人工智能带来主场优势。由于人工智能模型的训练方式,它们天生就擅长解决某些具体的问题,尤其是需要死记硬背或基础推理的问题。

简单地说,OpenAI 的 GPT-4 可以在 LSAT 考试中取得第 88 百分位数的成绩,但却无法辨别「Strawberry」一词中有多少个 「R」。Anthropic 的 Claude 3.7 Sonnet 在一项标准化软件工程基准测试中取得了 62.3% 的准确率,但在玩《口袋妖怪》时却比大多数的五岁孩子还差。

所以一些开放式的游戏反而能「另辟蹊径」,提供检验 AI 性能的新颖视角。在此之前,已经有很多知名游戏被加入 AI 基准测试的名单,比如《口袋妖怪》(Pokémon Red)、《街头霸王》(Street Fighter)和《猜字游戏》(Pictionary)。

推荐阅读:

MC-Bench 的作者表示,他其实希望能够让用户自由提示、自由投票,但这个玩法「又慢又贵」,目前阶段还不现实。

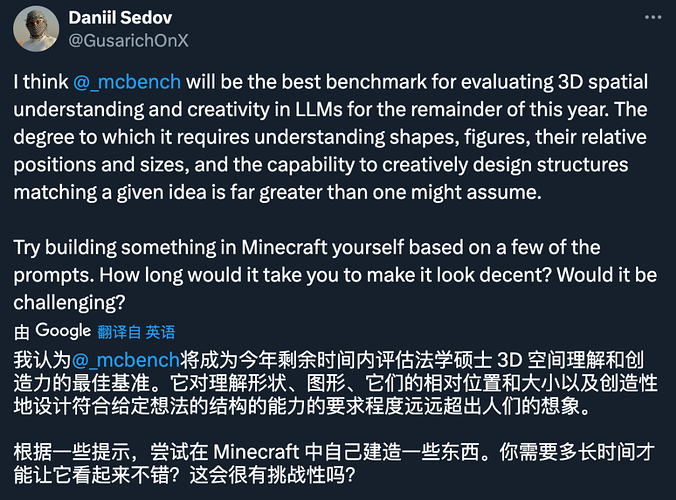

社区给 MC-Bench 的评价还是很高的,特别指出了它在「3D 空间理解和创造力」评估层面的价值。

MC-Bench 的网站目前列出了八位「特别鸣谢」的贡献者:Anthropic、谷歌、OpenAI 和阿里为该项目使用其产品运行基准提示提供了补贴,但这些公司在其他方面并无关联。

MC-Bench 团队还表示,面向研究人员,他们愿意开放后端查看权限,最终他们还将完全开放数据以供下载。

参考链接:

https://techcrunch.com/2025/03/20/a-high-schooler-built-a-website-that-lets-you-challenge-ai-models-to-a-minecraft-build-off/

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com