Token is the new frontier.

「因为 AI 技术爆发,GTC 大会的规模每年都在扩大,以前人们说 GTC 是 AI 的伍德斯托克音乐节,今年我们搬进了体育场,我觉得 GTC 已经成了 AI 的超级碗,」英伟达 CEO 黄仁勋说道。「唯一的不同在于每个人都是『超级碗』的赢家。」

北京时间 3 月 19 日凌晨,全世界的目光都汇聚在加州圣何塞 SAP 中心,期待英伟达给出的下一个 AI 大方向。

老黄的 Keynote 演讲行云流水,没有提词器。

在详细介绍 Keynote 内容之前,我们划下重点:

-

Blackwell 已经全面投产。「产量惊人,客户需求惊人,因为人工智能出现了一个拐点,由于推理人工智能以及推理人工智能系统和智能体系统的训练,我们在人工智能领域必须完成的计算量大大增加。」

-

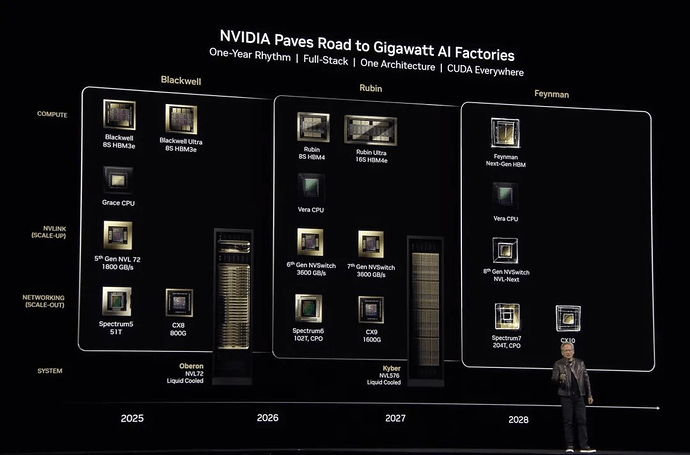

Blackwell Ultra 将于 2025 年下半年上市,下一代 AI 加速器架构 Vera Rubin 则会在 2026 年推出。

-

搭载分布式推理系统 Dynamo 的 Blackwell NVLink 72 的「AI 工厂」性能是英伟达 Hopper 的 40 倍。「随着人工智能规模的扩大,推理将成为未来十年最重要的工作负载之一」。

-

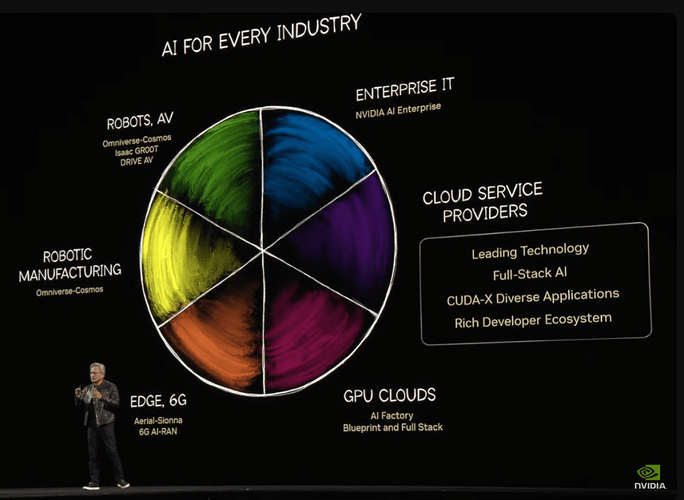

按照最新路线图,英伟达正在构建三种 AI 基础设施:一种用于云,第二种用于企业,第三种用于机器人。

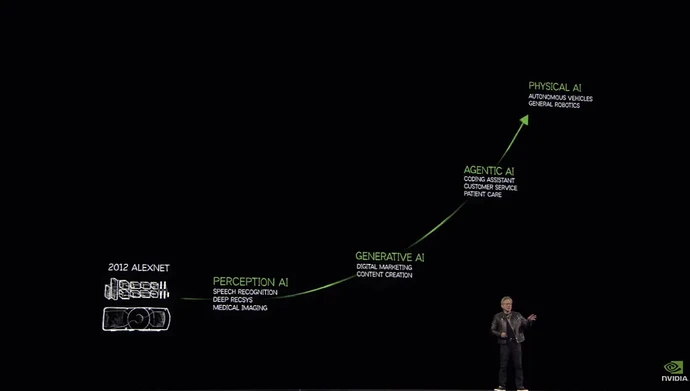

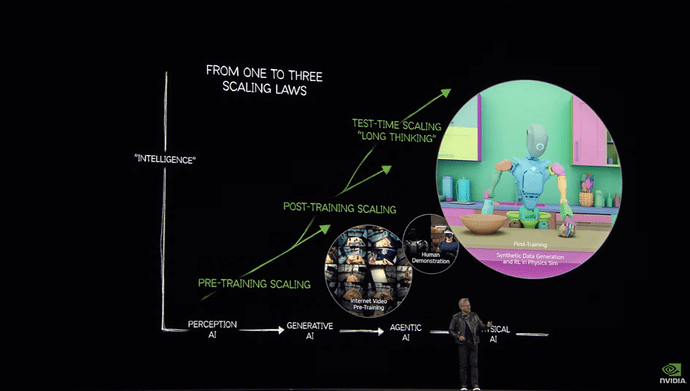

发布会上,老黄再次拿出 CES 上展示的 AI 发展曲线:

从 2012 年的 AlexNet 开始,现在我们处于生成式人工智能的阶段,即将进入智能体时代,随后是物理人工智能。物理 AI 也就是进入物理世界的人工智能,包括自动驾驶汽车与机器人。「每一次浪潮都为我们打开了新的市场机遇。」

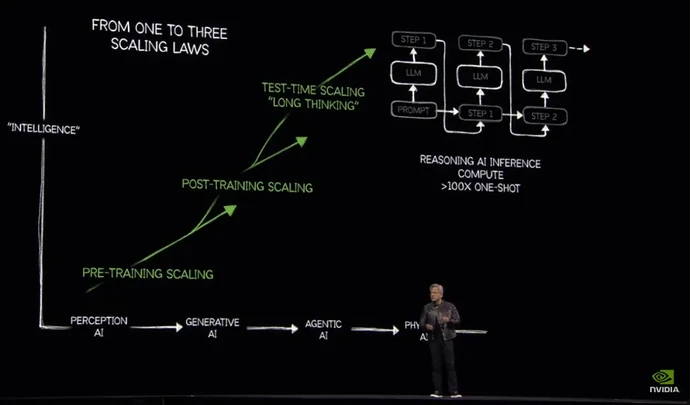

再增加一个维度,不容忽视的是 DeepSeek R1 推动测试时扩展(Test-Time Scaling)给机器智能带来的全新发展曲线:

智能背后是计算的力量。预训练时代解决数据问题,后训练解决的是 human-in-the-loop 问题,而测试时间扩展则是为了增强 AI 的推理能力。每一阶段都有自己的 Scaling Law,算力都是强需求。

所以,虽然 DeepSeek R1 的高效率给全世界以震撼,让人们正在重估大模型的算力需求,但英伟达对于未来的 AI 算力需求仍然非常乐观。

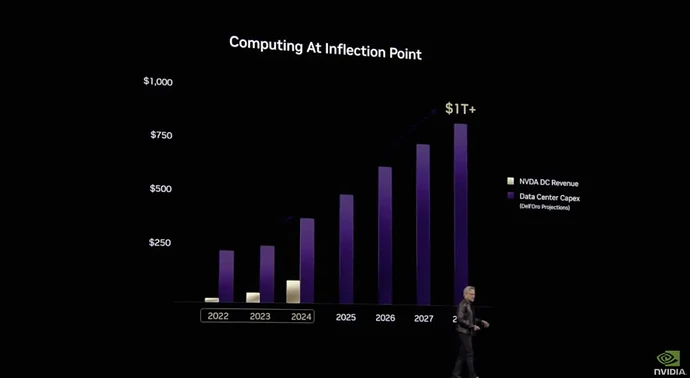

英伟达给出了一组数据:仅在 2024 年,全球前四的云服务运营商共采购了 130 万片 Hopper 架构芯片。预计数据中心的建设投资将很快达到 1 万亿美元。不知道其中有多少是 OpenAI 星际之门项目的贡献。

AI 计算不是在萎缩,而是在通货膨胀,老黄进一步给出了两个增长曲线:

在此之上,整个世界将会被重塑。

每个企业未来都会有两个工厂,一个是物理的工厂,一个是 AI 的虚拟工厂。英伟达为所有行业的变革准备了新的工具,包括 CUDA X 软件库,其中包括用于 NumPy 的 cuPYNUMERIC、用于量子计算的 cuQUANTUM 和 CUDA-Q、用于深度学习的 NCCL 和 cuBLAS 等等。

所有这些库都依赖 CUDA 核心来完成工作,为此英伟达也准备好了更先进的 AI 算力。

Blackwell 发布超大杯,性能猛增

Blackwell 架构的 AI 加速卡现在已经全面进入量产阶段,正在推动下一波 AI 基础设施浪潮。「这是我们改变计算架构基础的重要一步,」黄仁勋说道。

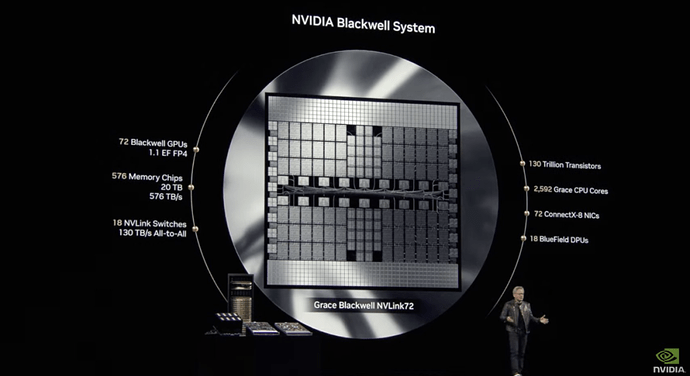

在芯片架构进步的同时,英伟达正在研究让用户同时访问多个 GPU 的 NVLINK 交换机。

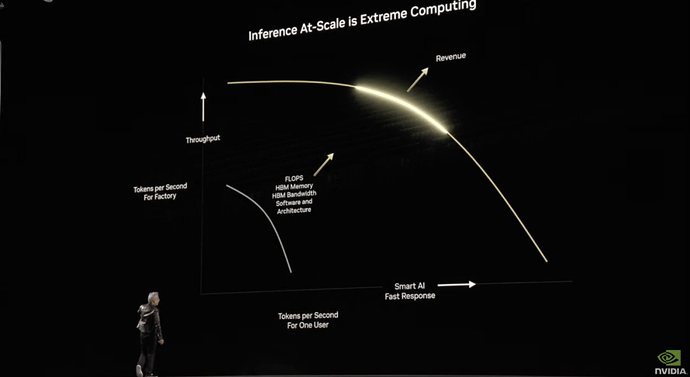

大规模的推理可能是英伟达迄今为止面临的最复杂的计算问题,但又是 AI 未来的方向。过去几个月里,很多人都在尝试使用 DeepSeek,肯定已经有了亲身体验:

黄仁勋展示了新旧两代大模型是如何解决「为七位客人优化婚宴餐桌位次」的问题。上代大语言模型 Llama 输出了 439 个 token,结果不尽如人意。强推理模型 DeepSeek R1 输出了 8559 个 token 进行了一番推理,花费的时间更长,计算量也更大,但结果真正能被人用得上。

老黄表示:「这是个只有丈母娘或者 AI 才能解决的问题。」

但是上面这个问题需要消耗 150 倍的算力。AI 服务商希望尽可能地向每位用户提供更高的速度,同时也希望尽可能地向更多用户提供服务。这就产生了对内存、带宽、计算速度等各个方面的巨大需求。Grace Blackwell NVLink72 正是为满足这样的需求诞生的。

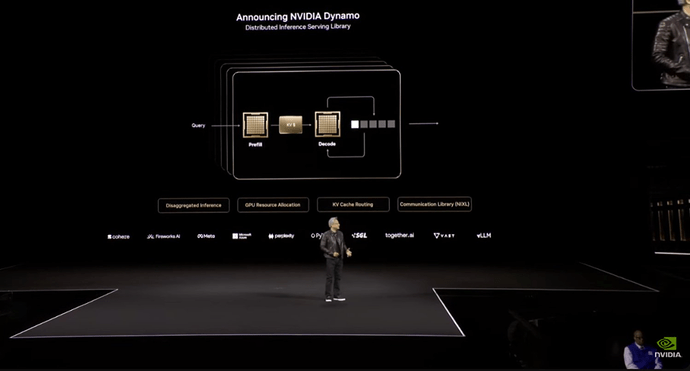

为了提升效率,英伟达在软件上也有创新,提出了「AI 工厂的操作系统」——NVIDIA Dynamo。它是一个「分布式推理服务库」,而且是一个开源解决方案,解决的是用户需要 token 但无法提供足够 token 的问题。据介绍,Dynamo 会被用于在大量 GPU 之间高效编排和协调 AI 推理请求。目前,微软、Perplexity 等公司已宣布开始接入这一系统。

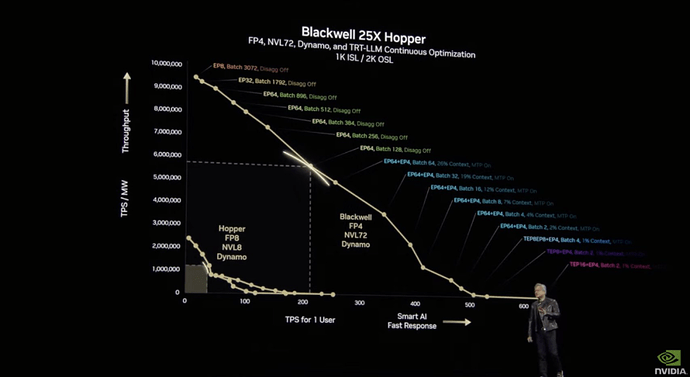

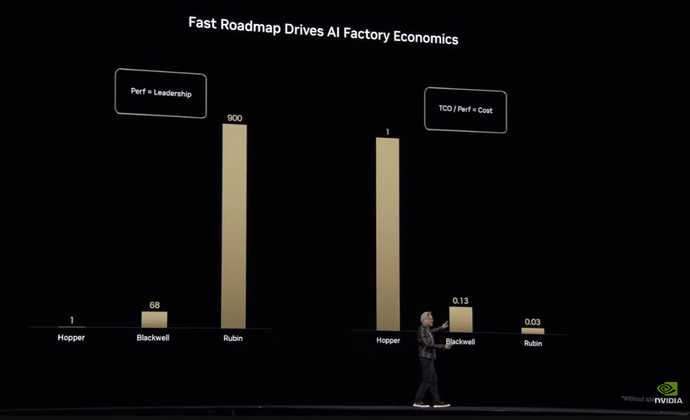

接下来,让我们看看软件 + 硬件能够带来的算力效率提升。如果强推理模型落地成产品,我们就需要 AI 能以极快的速度跑完思维链。「只有在英伟达,你才会这样被数学折磨,」老黄说道。在推理模型中,最新版 Blackwell 的性能是 Hopper 的 40 倍:

黄仁勋展示了一个非常直观的对比。同样是 100 MW 功率的 AI 工厂,使用 GB200 搭建的数据中心的生产力是使用 H100 的数据中心的 40 倍,同时机架数量还能从 1400 大幅减少到 600。

现在不是「the more you buy the more you save」了,而是「the more you buy the more you generate」。「全球 TOPS 的云服务提供商(CSP)订购的 Blackwell 芯片数量是 Hopper 的三倍,AI 算力的需求正在迅猛增长。」黄仁勋表示。

不得不说,他表示自己确实想提高 Blackwell 的销量,但这同时在一定程度上降低了 Hopper 的销量。他甚至打趣说自己是 chief revenue destroyer(首席收入破坏官)。

黄仁勋表示,人们的 AI 任务需求正在大幅提升,因为大模型推理任务、AI Agent 等任务,AI 推理的算力需求已经增长了 10-100 倍。这也就产生了对更强大性能的需求。

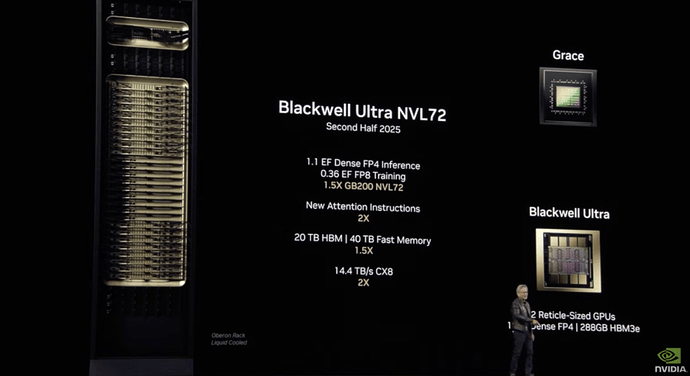

似乎是在顺应手机和新能源车出「超大杯」Ultra 版的风潮,英伟达在旗舰 AI 计算卡上也搞了个 Ultra 版:Blackwell Ultra NVL72。

这是迄今为止 AI 算力最强大的硬件,配备了 1.1 EF 的密集 FP4 推理能力和 0.36 EF 的 FP8 训练能力,达到了 GB200 NVL72 的 1.5 倍。此外,它的互联带宽是 GB200 NVL72 的 2 倍,内存速度也提升了 1.5 倍。至于 Blackwell Ultra NVL72 的上市时间,预计会是今年下半年。

将八个 NVL72 机架放在一起,就可以获得完整的 Blackwell Ultra DGX SuperPOD:288 个 Grace CPU、576 个 Blackwell Utlra GPU、300TB HBM3e 内存和 11.5 ExaFLOPS FP4 算力。这就形成了英伟达定义中「AI 工厂」的超级计算机解决方案。

需要注意的是,Blackwell Ultra GPU(GB300 和 B300)与 Blackwell GPU(GB200 和 B200)是不同的芯片。

下一代架构 Vera Rubin

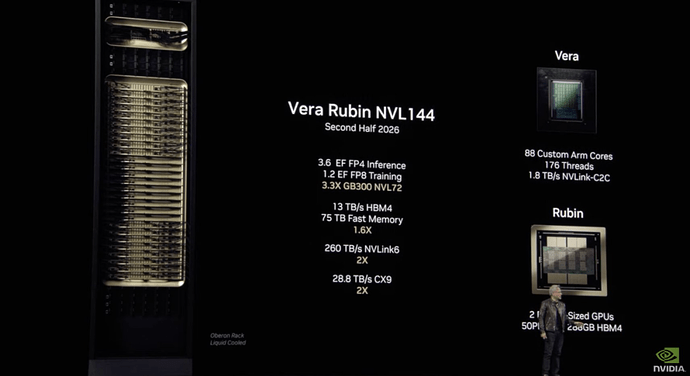

既然算力在通货膨胀,那这还远远不够。在今天的 Keynote 中,英伟达很快就介绍完了 Blackwell Ultra,转而展示了其下一代架构 Vera Rubin—— 其全机架性能应是同类 Blackwell Ultra 的 3.3 倍。

Vera Rubin 将是英伟达的下一个平台,将于 2026 年下半年推出。Vera Rubin 具有 NVLink144,更强大的 Rubin Ultra 则具有 NVLink576,将于 2027 年下半年推出。在具体性能上,其将具有 3.6 EF 的 FP4 推理性能和 1.2 EF 的 FP8 训练性能,整体可达到 GB300 NVL72 的 3.3 倍,同时在其它指标上也有 2 倍左右的提升。

其 Ultra 版则计划在 2027 年下半年推出,其性能更是有望达到 GB300 NVL72 的 14 倍!

除了 GPU 芯片的迭代,Rubin 还将标志着从 HBM3/HBM3e 向 HBM4 的转变。每 GPU 的内存容量仍为 288GB,与 B300 相同,但带宽将从 8 TB/s 提高到 13 TB/s。下代产品还将拥有更快的 NVLink,吞吐量翻倍至 260 TB/s,机架之间的新 CX9 链路速度为 28.8 TB/s(是 B300 和 CX8 的两倍)。

如果将 4 组 Vera Rubin NVLink144 组成的 Vera Rubin NVLink576 来构建 NVIDIA Rubin System,则这将是配备 576 个 Rubin GPU 的性能怪兽,能实现 15 EF 的 FP4 性能,同时内存也将达到惊人的 150 TB。对比前代 Blackwell System 的性能,可以看到优势非常明显。

黄仁勋特别强调:「你可以看到,Rubin 将大大降低成本。」

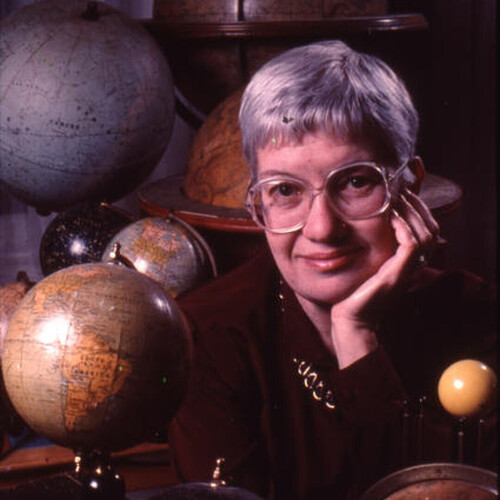

据了解,这一代 GPU 得名于科学家 Vera Rubin,她是一位美国天文学家,1928 年出生于费城。她的知名成就是发现了暗物质存在的证据。

值得一提的是,自去年的 Blackwell 开始,命名就不再单指芯片架构。黄仁勋就曾强调,Blackwell 并不是某块芯片,而是一个技术平台,英伟达也越来越多地开始使用「Blackwell」一词来指代该公司所有最新一代 AI 产品,例如 GB200 芯片和 DGX 服务器机架。

黄仁勋还在演讲中简单提到了再后一代的 Feynman 架构 —— 很显然这得名于著名物理学家理查德・费曼。不过这至少得等到 2028 年了。

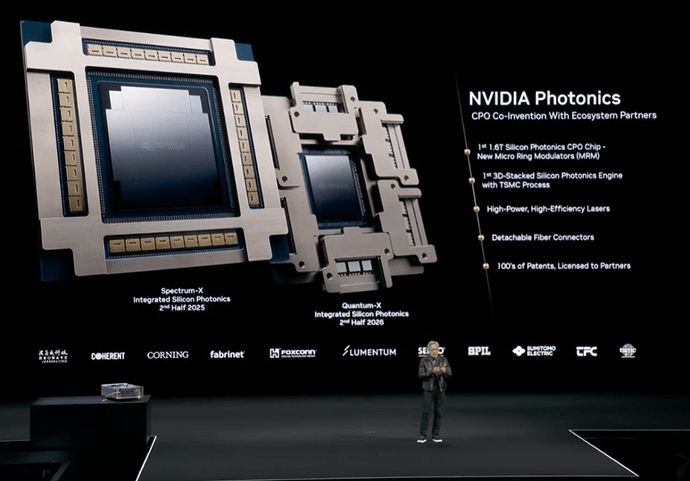

此外,黄仁勋还宣布了 NVIDIA Photonics,这似乎是迄今为止最强大的 Spectrum-X 以太网互联,以激光作为介质,可以大幅提升 GPU 之间的传输速度,支持拥有数百万块 GPU 的集群。预计这款产品将于今年下半年上市,而新一代的 Quantum-X 将在明年下半年上市。

今天的新产品中相对来说接地气的是 Blackwell RTX Pro 系列图形产品。其面向的是笔记本电脑和台式机,以及独立 PC 和数据中心产品。具体规格和配置的细节尚未公布,已知顶级解决方案将使用与 GeForce RTX 5090 相同的 GB202 芯片(但显存会更大)。

至此,英伟达看起来已经为强推理 AI 大规模落地所需巨量的计算做好了准备。

下一波浪潮:物理世界的 AI

最后是对未来的展望。英伟达表示,AI 的下一波浪潮必然会延伸到物理世界,主要形式会是三种机器人:工业机器人、自动驾驶车辆以及狭义的人形机器人。

三种机器人都需要的算力包括预训练、模拟环境和端侧算力,这些算力英伟达都提供。物理世界的 AI 将会带动数万亿美元的工业产值,数以十亿计的机器人将会使用英伟达的计算平台。

数据、架构、Scaling Law,这些问题在机器人领域也同样存在。

对此,英伟达的预训练模型平台 Cosmos、GROOT N1 以及 NVIDIA Omniverse 将会帮助物理 AI 生态的构建,推动技术的发展。

其中,GROOT N1 是通用的机器人基础模型,英伟达宣布已经把它开源了出来。模型采用双系统架构,灵感来自人类认知原理。在视觉语言模型的支持下,系统 2 可以推理其环境和收到的指令,从而规划行动。然后,系统 1 将这些计划转化为精确、连续的机器人动作。

基于可通过少量人类演示生成指数级的大量合成动作数据的生成蓝图,他们在短短 11 小时内生成了 78 万条合成轨迹,相当于 6500 小时或连续 9 个月的人类演示数据。然后,通过将合成数据与真实数据相结合,与仅使用真实数据相比,GR00T N1 的性能提高了 40%。

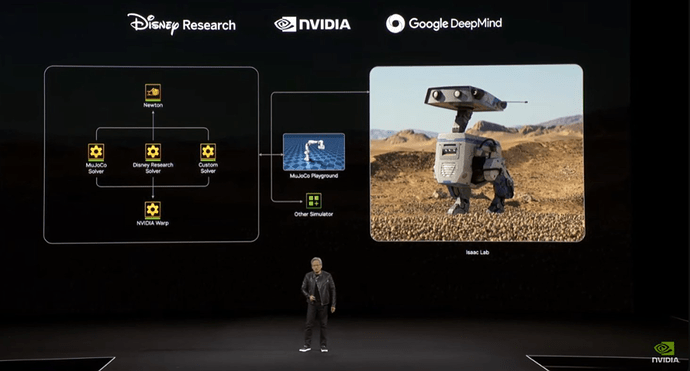

黄仁勋展示了与迪斯尼和 DeepMind 联合开发的机器人平台 Newton,以及基于该平台打造的《星球大战》风格的机器人 Blue。

他表示,对于机器人,可验证的奖励就是物理定律。

利用 Omniverse 和 Cosmos 通过数字孪生虚拟训练机器人的 AI,然后将其转化为现实世界的动作 Token 输出,这就是未来机器人大规模落地的方式吗?

如果人形机器人会有恐怖谷效应的话,科幻电影里早已为我们准备了解决方案。

「每个人都应该关注机器人领域,它很可能会成为最大的产业,」黄仁勋说。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com