Mistral AI开源24B多模态小模型Mistral Small 3.1,单4090可运行,性能超Gemma 3,适用于多种AI任务。

原文标题:单个4090就能跑,Mistral开源多模态小模型,开发者:用来构建推理模型足够香

原文作者:机器之心

冷月清谈:

怜星夜思:

2、文章里提到Mistral Small 3.1 可以针对特定领域进行微调,这个微调具体是怎么操作的?需要哪些技术储备或者工具?

3、Mistral Small 3.1 号称在单个 RTX 4090 上就能跑,但实际使用中,对硬件配置还有哪些要求?比如 CPU、内存、硬盘速度等等,有没有更详细的测试数据?

原文内容

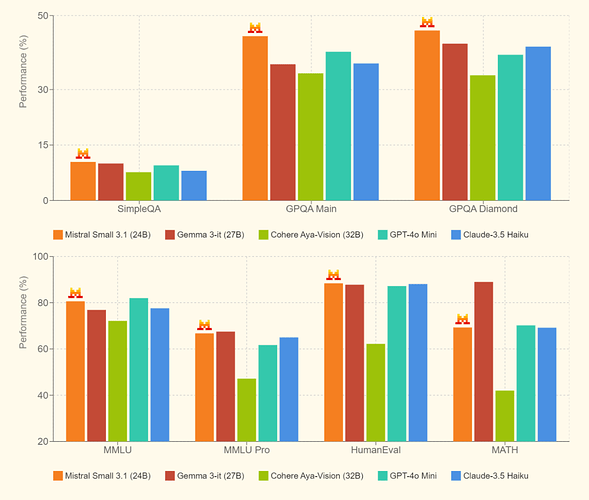

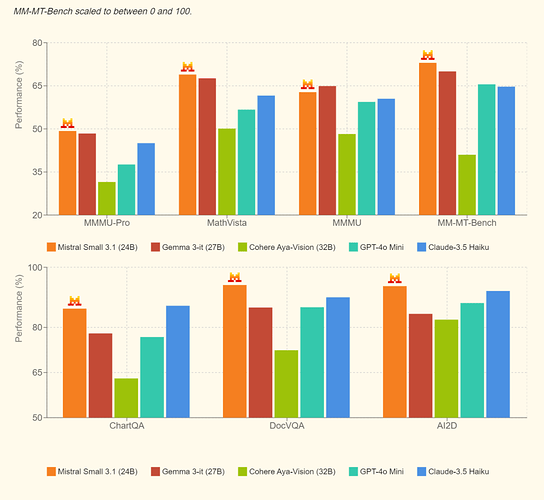

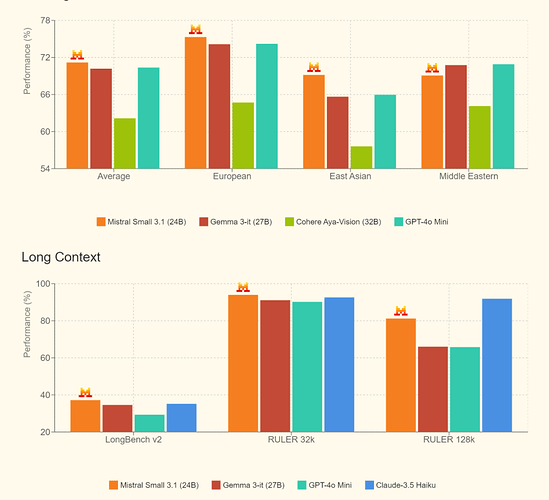

多模态,性能超 GPT-4o Mini、Gemma 3,还能在单个 RTX 4090 上运行,这个小模型值得一试。

-

Mistral Small 3.1 Base:https://huggingface.co/mistralai/Mistral-Small-3.1-24B-Base-2503

-

Mistral Small 3.1 Instruct:https://huggingface.co/mistralai/Mistral-Small-3.1-24B-Instruct-2503

-

轻量级:可以在单个 RTX 4090 或具有 32GB RAM 的 Mac 上运行。这使其非常适合端侧使用情况。

-

快速响应能力:非常适合虚拟助手和其他需要快速、准确响应的应用程序。

-

低延迟函数调用:能够在自动化或智能体工作流中快速执行函数。

-

针对专业领域进行微调:Mistral Small 3.1 可以针对特定领域进行微调,打造精准的主题专家。这在法律咨询、医疗诊断和技术支持等领域尤其有用。

-

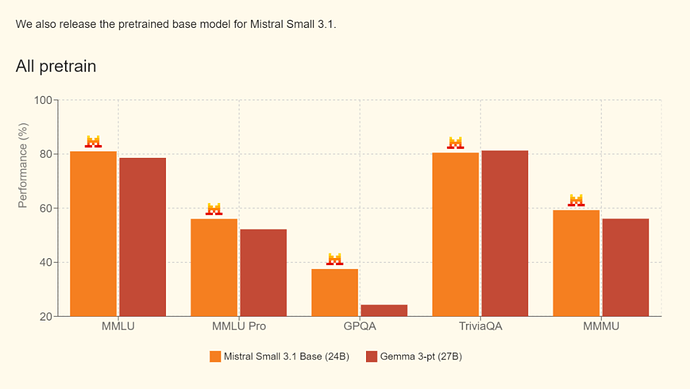

高级推理的基础:开放的 Mistral 模型已经被开发者用来构建出色的推理模型,比如 Nous Research 的 DeepHermes 24B 就是基于 Mistral Small 3 构建出来的。为了鼓励这种创新,Mistral AI 发布了 Mistral Small 3.1 的基础模型和指令检查点,以便社区进一步对模型进行下游定制。