阿里推出EMO2模型,可根据音频生成更逼真的人像视频,动作表情更自然,手势更流畅。

原文标题:真假难辨!阿里升级AI人像视频生成,表情动作直逼专业水准

原文作者:机器之心

冷月清谈:

怜星夜思:

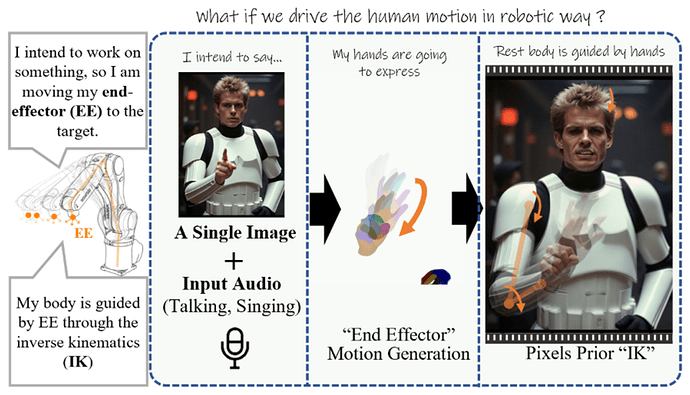

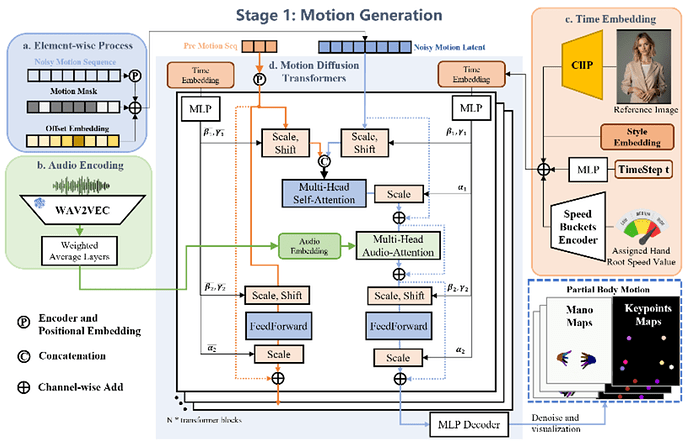

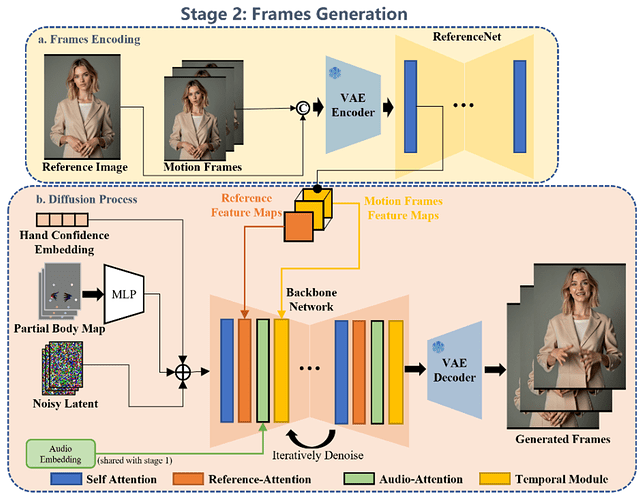

2、EMO2的技术方案中提到的“具有像素先验知识的IK”方法,具体是如何将人体结构知识融入像素生成的?

3、除了虚拟主播和数字人交互,EMO2这项技术还能应用于哪些领域?

原文内容

![]()

AIxiv专栏是机器之心发布学术、技术内容的栏目。过去数年,机器之心AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com

EMO 最初由阿里巴巴通义实验室提出,作为音频驱动高表现力人像 AI 视频生成的先驱。现在,该实验室的研究者带来了升级版本「EMO2」!

只需提供一张人物的肖像图片,你就可以输入任意长度的音频来驱动人物说话、唱歌或进行手势舞。并且,生成的人物表情和动作都具备高度的感染力和专业水准。

-

论文标题:EMO2: End-Effector Guided Audio-Driven Avatar Video Generation

-

论文地址:https://arxiv.org/abs/2501.10687

-

项目地址:https://humanaigc.github.io/emote-portrait-alive-2/

我们来看几个视频生成示例: